Incremental Human-Object Interaction Detection with Invariant Relation Representation Learning

作者: Yana Wei, Zeen Chi, Chongyu Wang, Yu Wu, Shipeng Yan, Yongfei Liu, Xuming He

分类: cs.CV

发布日期: 2025-10-30

🔗 代码/项目: GITHUB

💡 一句话要点

提出无例增量关系蒸馏框架以解决动态环境中的人机交互检测问题

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱五:交互与反应 (Interaction & Reaction)

关键词: 人机交互 增量学习 关系蒸馏 动态环境 零样本检测

📋 核心要点

- 现有的HOI检测模型在动态环境中面临灾难性遗忘、交互漂移和零样本组合检测等挑战。

- 本文提出的无例增量关系蒸馏框架通过解耦对象与关系的学习,解决了上述问题。

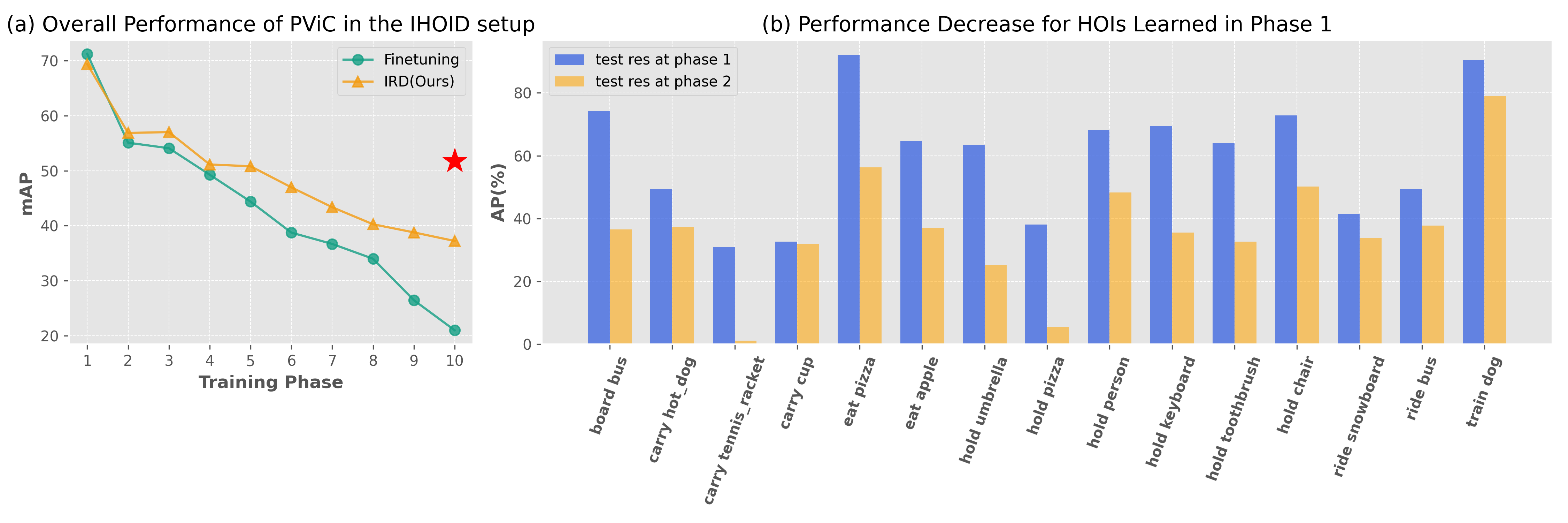

- 在HICO-DET和V-COCO数据集上的实验结果显示,所提方法在减轻遗忘和增强鲁棒性方面显著优于现有基线。

📝 摘要(中文)

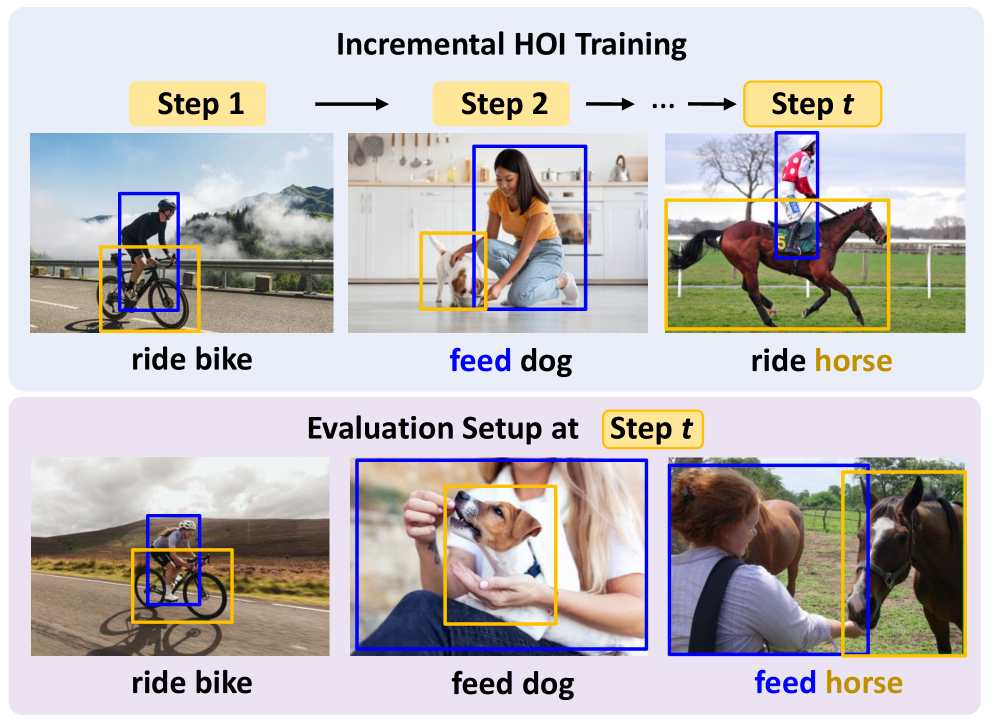

在开放世界环境中,人机交互(HOI)不断演变,给传统的封闭世界HOI检测模型带来了挑战。受人类逐步获取知识能力的启发,本文探索了增量HOI检测(IHOID),旨在开发能够在动态环境中识别人机关系的智能体。该方法不仅面临增量学习中的灾难性遗忘问题,还需应对交互漂移和检测零样本HOI组合的独特挑战。因此,本文提出了一种新颖的无例增量关系蒸馏(IRD)框架,解耦了对象和关系的学习,并引入了两种独特的蒸馏损失,以学习跨不同HOI组合的恒定关系特征。大量实验表明,该方法在减轻遗忘、增强对交互漂移的鲁棒性以及零样本HOI的泛化能力方面优于现有的最先进基线。

🔬 方法详解

问题定义:本文旨在解决开放世界环境中人机交互检测的增量学习问题,现有方法在面对动态变化时容易出现灾难性遗忘和交互漂移等问题。

核心思路:提出无例增量关系蒸馏框架,通过解耦对象和关系的学习,利用蒸馏损失来学习恒定的关系特征,从而提高模型的适应性和鲁棒性。

技术框架:IRD框架包括两个主要模块:对象学习模块和关系学习模块。对象模块负责识别和学习不同的对象特征,而关系模块则专注于学习对象间的关系特征。

关键创新:最重要的创新在于引入了无例增量学习机制和两种独特的蒸馏损失函数,使得模型能够在不同的HOI组合中保持关系特征的一致性,这与传统方法的依赖于示例的学习方式有本质区别。

关键设计:在损失函数设计上,本文引入了针对关系特征的蒸馏损失,确保在增量学习过程中保持关系特征的稳定性,同时采用了适应性学习率策略来优化模型训练过程。

🖼️ 关键图片

📊 实验亮点

实验结果表明,所提方法在HICO-DET和V-COCO数据集上显著优于最先进的基线,尤其是在减轻遗忘和增强对交互漂移的鲁棒性方面,零样本HOI的检测能力也得到了显著提升,验证了方法的有效性。

🎯 应用场景

该研究的潜在应用领域包括智能监控、机器人交互和人机协作等场景。通过提升人机交互的智能化水平,能够在动态环境中实现更高效的任务执行和决策支持,具有重要的实际价值和未来影响。

📄 摘要(原文)

In open-world environments, human-object interactions (HOIs) evolve continuously, challenging conventional closed-world HOI detection models. Inspired by humans' ability to progressively acquire knowledge, we explore incremental HOI detection (IHOID) to develop agents capable of discerning human-object relations in such dynamic environments. This setup confronts not only the common issue of catastrophic forgetting in incremental learning but also distinct challenges posed by interaction drift and detecting zero-shot HOI combinations with sequentially arriving data. Therefore, we propose a novel exemplar-free incremental relation distillation (IRD) framework. IRD decouples the learning of objects and relations, and introduces two unique distillation losses for learning invariant relation features across different HOI combinations that share the same relation. Extensive experiments on HICO-DET and V-COCO datasets demonstrate the superiority of our method over state-of-the-art baselines in mitigating forgetting, strengthening robustness against interaction drift, and generalization on zero-shot HOIs. Code is available at \href{https://github.com/weiyana/ContinualHOI}{this HTTP URL}