OmniX: From Unified Panoramic Generation and Perception to Graphics-Ready 3D Scenes

作者: Yukun Huang, Jiwen Yu, Yanning Zhou, Jianan Wang, Xintao Wang, Pengfei Wan, Xihui Liu

分类: cs.CV, cs.GR, cs.LG

发布日期: 2025-10-30

备注: Project page: https://yukun-huang.github.io/OmniX/

💡 一句话要点

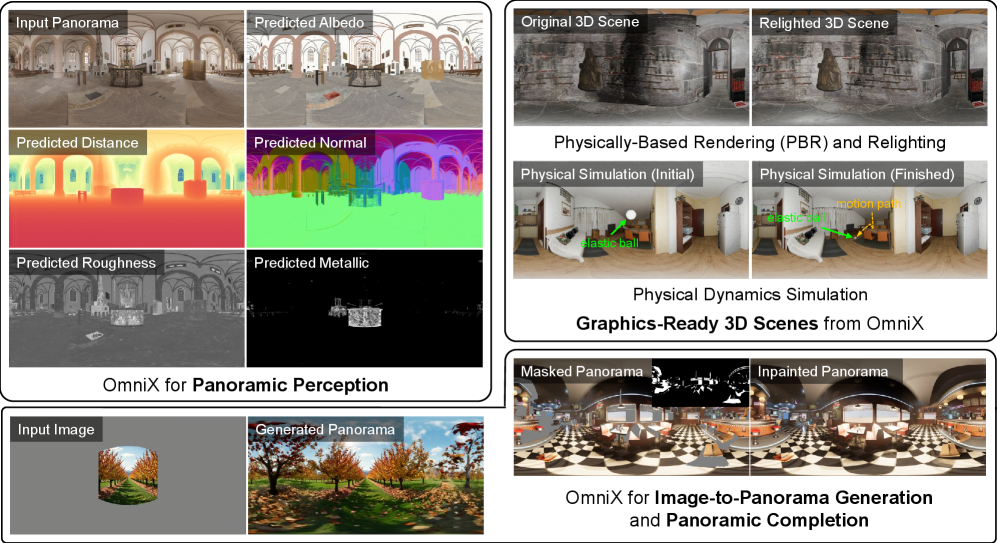

OmniX:利用全景生成与感知,生成可用于图形渲染的3D场景

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 全景感知 3D场景生成 2D提升 跨模态适配 物理渲染

📋 核心要点

- 现有2D提升方法侧重外观生成,忽略了对场景内在属性(如几何、材质)的感知,限制了3D场景的真实感和可交互性。

- OmniX通过复用2D生成模型进行全景几何、纹理和PBR材质的感知,从而生成可用于物理渲染的3D场景。

- OmniX在全景视觉感知和图形就绪3D场景生成方面表现出色,并构建了一个大规模多模态全景数据集。

📝 摘要(中文)

本文提出OmniX,一个多功能统一的框架,旨在生成可用于基于物理渲染(PBR)、重新光照和仿真的图形就绪3D场景。该方法复用2D生成模型进行几何、纹理和PBR材质的全景感知。与侧重外观生成而忽略内在属性感知的现有2D提升方法不同,OmniX基于轻量高效的跨模态适配器结构,将2D生成先验知识应用于全景视觉任务,包括全景感知、生成和补全。此外,本文构建了一个大规模合成全景数据集,包含来自各种室内和室外场景的高质量多模态全景图。大量实验表明,该模型在全景视觉感知和图形就绪3D场景生成方面有效,为沉浸式和物理逼真的虚拟世界生成开辟了新的可能性。

🔬 方法详解

问题定义:现有基于全景图的3D场景生成方法,主要关注生成逼真的外观,而忽略了场景的内在属性,如几何形状、材质和光照信息。这导致生成的3D场景难以进行基于物理的渲染、重新光照和交互式仿真,限制了其在虚拟现实和游戏等领域的应用。现有方法缺乏对全景图内在属性的有效感知能力。

核心思路:OmniX的核心思路是复用强大的2D生成模型,将其应用于全景图的感知任务,从而提取全景图中的几何、纹理和PBR材质信息。通过跨模态适配器结构,将2D生成先验知识迁移到全景视觉任务中,实现全景感知、生成和补全的统一框架。这种方法充分利用了2D生成模型的强大能力,同时避免了从头开始训练3D感知模型的复杂性。

技术框架:OmniX框架包含以下主要模块:1) 全景图像输入;2) 跨模态适配器:将2D生成模型的特征与全景图像特征对齐;3) 全景感知模块:预测全景图的几何、纹理和PBR材质信息;4) 3D场景重建模块:根据预测的几何和材质信息,重建可用于图形渲染的3D场景。整个流程实现了从全景图像到图形就绪3D场景的转换。

关键创新:OmniX的关键创新在于:1) 提出了一个统一的全景感知、生成和补全框架,能够同时处理多种全景视觉任务;2) 通过跨模态适配器结构,有效地复用了2D生成模型的先验知识,避免了从头开始训练3D感知模型的需要;3) 构建了一个大规模多模态全景数据集,为全景视觉研究提供了数据支持。与现有方法相比,OmniX更注重对全景图内在属性的感知,从而生成更逼真、更可交互的3D场景。

关键设计:OmniX的关键设计包括:1) 轻量级的跨模态适配器结构,保证了模型的效率和可扩展性;2) 针对不同全景视觉任务设计的损失函数,例如,几何感知采用深度损失和法线损失,材质感知采用PBR材质损失;3) 大规模合成全景数据集,包含多种室内和室外场景,以及对应的几何、纹理和PBR材质标注。

🖼️ 关键图片

📊 实验亮点

OmniX在全景视觉感知和图形就绪3D场景生成方面取得了显著成果。实验结果表明,OmniX能够有效地预测全景图的几何、纹理和PBR材质信息,并生成高质量的3D场景。与现有方法相比,OmniX在场景真实感和可交互性方面有明显提升。此外,OmniX构建的大规模多模态全景数据集,为相关研究提供了宝贵资源。

🎯 应用场景

OmniX在虚拟现实、增强现实、游戏开发、室内设计和城市规划等领域具有广泛的应用前景。它可以用于快速生成逼真的3D虚拟环境,为用户提供沉浸式的体验。此外,OmniX还可以用于自动化3D场景重建,提高3D内容生产的效率。未来,OmniX有望成为构建数字孪生和元宇宙的关键技术。

📄 摘要(原文)

There are two prevalent ways to constructing 3D scenes: procedural generation and 2D lifting. Among them, panorama-based 2D lifting has emerged as a promising technique, leveraging powerful 2D generative priors to produce immersive, realistic, and diverse 3D environments. In this work, we advance this technique to generate graphics-ready 3D scenes suitable for physically based rendering (PBR), relighting, and simulation. Our key insight is to repurpose 2D generative models for panoramic perception of geometry, textures, and PBR materials. Unlike existing 2D lifting approaches that emphasize appearance generation and ignore the perception of intrinsic properties, we present OmniX, a versatile and unified framework. Based on a lightweight and efficient cross-modal adapter structure, OmniX reuses 2D generative priors for a broad range of panoramic vision tasks, including panoramic perception, generation, and completion. Furthermore, we construct a large-scale synthetic panorama dataset containing high-quality multimodal panoramas from diverse indoor and outdoor scenes. Extensive experiments demonstrate the effectiveness of our model in panoramic visual perception and graphics-ready 3D scene generation, opening new possibilities for immersive and physically realistic virtual world generation.