ConceptScope: Characterizing Dataset Bias via Disentangled Visual Concepts

作者: Jinho Choi, Hyesu Lim, Steffen Schneider, Jaegul Choo

分类: cs.CV, cs.AI

发布日期: 2025-10-30

备注: Published in the Thirty-Ninth Conference on Neural Information Processing Systems (NeurIPS 2025)

💡 一句话要点

ConceptScope:通过解耦视觉概念表征来量化和识别数据集偏差。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 数据集偏差 视觉概念 稀疏自编码器 可解释性 模型诊断

📋 核心要点

- 现有方法缺乏在没有细粒度标注的情况下系统识别数据集偏差的能力,这阻碍了模型鲁棒性和公平性的提升。

- ConceptScope利用视觉基础模型的表征,通过稀疏自编码器自动发现和量化人类可解释的视觉概念,从而识别数据集偏差。

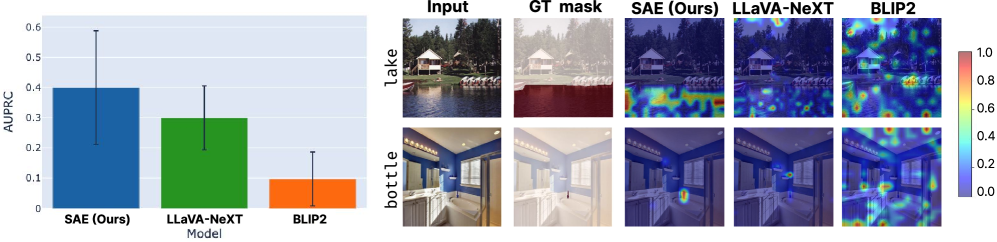

- 实验表明,ConceptScope能够有效检测已知和未知的偏差,并生成与语义相关的空间归因,为数据集审计提供有力支持。

📝 摘要(中文)

数据集偏差在机器学习数据集中普遍存在,表现为数据点偏向某些概念。然而,在没有昂贵且细粒度的属性标注的情况下,系统地识别这些偏差具有挑战性。本文提出了ConceptScope,一个可扩展的自动化框架,通过使用在视觉基础模型表征上训练的稀疏自编码器来发现和量化人类可解释的概念,从而分析视觉数据集。ConceptScope根据概念的语义相关性和与类别标签的统计相关性将概念分为目标、上下文和偏差类型,从而实现类级别的数据集特征描述、偏差识别以及通过基于概念的子分组进行鲁棒性评估。通过与带标注数据集的比较,验证了ConceptScope能够捕获广泛的视觉概念,包括对象、纹理、背景、面部属性、情感和动作。此外,概念激活产生与语义上有意义的图像区域对齐的空间归因。ConceptScope可靠地检测已知的偏差(例如,Waterbirds中的背景偏差)并发现以前未标注的偏差(例如,ImageNet中共同出现的对象),为数据集审计和模型诊断提供了一个实用的工具。

🔬 方法详解

问题定义:论文旨在解决机器学习数据集中普遍存在的数据集偏差问题。现有方法依赖于昂贵且细粒度的属性标注才能识别这些偏差,限制了其可扩展性和自动化程度。因此,如何高效、自动地识别数据集中的偏差,成为了一个重要的挑战。

核心思路:ConceptScope的核心思路是利用视觉基础模型学习到的通用表征,并通过稀疏自编码器从中提取人类可解释的视觉概念。通过分析这些概念与类别标签之间的关系,可以识别出与目标类别相关的概念(目标概念)、与类别无关的背景概念(上下文概念)以及与类别标签存在统计相关性的偏差概念。

技术框架:ConceptScope框架主要包含以下几个阶段:1) 使用视觉基础模型(如CLIP)提取图像的视觉表征;2) 在这些表征上训练稀疏自编码器,以学习一组稀疏的、人类可解释的视觉概念;3) 根据概念与类别标签的语义相关性和统计相关性,将概念分为目标、上下文和偏差类型;4) 利用识别出的概念进行数据集特征描述、偏差识别和基于概念的子分组,以评估模型的鲁棒性。

关键创新:ConceptScope的关键创新在于其能够自动地从视觉数据中发现和量化人类可解释的概念,而无需人工标注。通过稀疏自编码器,ConceptScope能够学习到具有稀疏激活的特征,这些特征对应于图像中不同的视觉概念。此外,ConceptScope还提出了一种基于语义和统计相关性的概念分类方法,能够有效地识别出数据集中的偏差概念。

关键设计:在稀疏自编码器的训练中,使用了L1正则化来鼓励稀疏性,从而使得学习到的特征更具有可解释性。此外,论文还设计了一种基于互信息和显著性分析的概念分类方法,用于区分目标、上下文和偏差概念。具体的参数设置和损失函数细节在论文中有详细描述,例如L1正则化的系数,自编码器的隐藏层大小等。

🖼️ 关键图片

📊 实验亮点

ConceptScope在多个数据集上进行了验证,包括Waterbirds和ImageNet。实验结果表明,ConceptScope能够可靠地检测已知的偏差(例如,Waterbirds中的背景偏差),并发现以前未标注的偏差(例如,ImageNet中共同出现的对象)。此外,概念激活产生的空间归因与语义上有意义的图像区域对齐,进一步验证了ConceptScope的有效性。

🎯 应用场景

ConceptScope可应用于多种场景,例如数据集审计、模型诊断和鲁棒性评估。它可以帮助研究人员和工程师识别数据集中的偏差,从而改进数据收集和模型训练策略,提高模型的泛化能力和公平性。此外,ConceptScope还可以用于构建更加可靠和可信赖的AI系统,尤其是在安全关键型应用中。

📄 摘要(原文)

Dataset bias, where data points are skewed to certain concepts, is ubiquitous in machine learning datasets. Yet, systematically identifying these biases is challenging without costly, fine-grained attribute annotations. We present ConceptScope, a scalable and automated framework for analyzing visual datasets by discovering and quantifying human-interpretable concepts using Sparse Autoencoders trained on representations from vision foundation models. ConceptScope categorizes concepts into target, context, and bias types based on their semantic relevance and statistical correlation to class labels, enabling class-level dataset characterization, bias identification, and robustness evaluation through concept-based subgrouping. We validate that ConceptScope captures a wide range of visual concepts, including objects, textures, backgrounds, facial attributes, emotions, and actions, through comparisons with annotated datasets. Furthermore, we show that concept activations produce spatial attributions that align with semantically meaningful image regions. ConceptScope reliably detects known biases (e.g., background bias in Waterbirds) and uncovers previously unannotated ones (e.g, co-occurring objects in ImageNet), offering a practical tool for dataset auditing and model diagnostics.