EgoExo-Con: Exploring View-Invariant Video Temporal Understanding

作者: Minjoon Jung, Junbin Xiao, Junghyun Kim, Byoung-Tak Zhang, Angela Yao

分类: cs.CV, cs.AI

发布日期: 2025-10-30

备注: project page: \url{https://minjoong507.github.io/projects/EgoExo-Con/}

💡 一句话要点

提出EgoExo-Con基准与View-GRPO框架,提升视频LLM在不同视角下的一致性时序理解能力

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱六:视频提取与匹配 (Video Extraction)

关键词: 视频LLM 跨视角一致性 时序理解 强化学习 EgoExo-Con基准

📋 核心要点

- 现有视频LLM在处理不同视角下同一事件的时序理解时,缺乏一致性,导致性能下降。

- 提出View-GRPO框架,利用强化学习增强视角特定的时序推理,并鼓励跨视角的一致性理解。

- 实验表明,View-GRPO在跨视角一致性方面优于监督微调和GRPO,提升了视频LLM的性能。

📝 摘要(中文)

本文提出了EgoExo-Con基准,用于研究视频LLM在不同视角(第一人称和第三人称)下对同一事件进行时序理解时的一致性。EgoExo-Con包含全面同步的以人为中心和以外人为中心的视频对,并附带人工精炼的自然语言查询,侧重于时序验证和时序定位两个任务。分析表明,现有视频LLM存在两个主要局限性:(1)模型常常无法保持跨视角的一致性,性能远低于单视角;(2)简单地使用同步视频进行微调虽然能提高一致性,但性能通常不如单视角训练的模型。为了解决这些问题,本文提出了一种新的强化学习框架View-GRPO,它能有效增强特定视角的时序推理能力,同时鼓励跨视角的一致性理解。实验结果表明,View-GRPO优于简单的监督微调(SFT)和GRPO,尤其是在提高跨视角一致性方面。所有资源都将公开。

🔬 方法详解

问题定义:现有视频LLM在处理来自不同视角的视频时,对同一事件的时序理解往往不一致。例如,模型可能在第一人称视角下正确识别事件发生的时间顺序,但在第三人称视角下却给出错误的答案。这种不一致性限制了视频LLM在实际应用中的可靠性。现有方法,如直接使用同步视频进行微调,虽然可以提高一致性,但往往会损害单视角下的性能。

核心思路:本文的核心思路是通过强化学习来分别增强不同视角的时序推理能力,同时显式地鼓励模型在不同视角下保持一致的理解。View-GRPO框架旨在学习一个策略,该策略能够根据视频内容和视角选择合适的动作,从而最大化奖励,奖励函数的设计同时考虑了单视角下的准确性和跨视角的一致性。

技术框架:View-GRPO框架包含以下主要模块:1) 视频编码器:用于提取视频特征;2) 查询编码器:用于编码自然语言查询;3) 策略网络:根据视频特征、查询和视角选择动作;4) 奖励函数:评估模型在单视角下的准确性和跨视角的一致性。整个流程如下:首先,将同步的以人为中心和以外人为中心的视频输入到视频编码器中,并使用查询编码器编码相应的自然语言查询。然后,策略网络根据编码后的特征和视角选择动作。最后,根据奖励函数评估模型的性能,并使用强化学习算法更新策略网络。

关键创新:View-GRPO的关键创新在于其强化学习框架,它能够显式地学习如何平衡单视角下的准确性和跨视角的一致性。与传统的监督学习方法不同,View-GRPO不需要大量的标注数据,而是通过与环境的交互来学习最优策略。此外,奖励函数的设计也至关重要,它需要能够准确地评估模型的性能,并引导模型学习到一致的理解。

关键设计:View-GRPO的关键设计包括:1) 策略网络的设计:可以使用各种神经网络结构,如Transformer或LSTM;2) 奖励函数的设计:可以结合单视角下的准确性和跨视角的一致性,例如,可以使用交叉熵损失来衡量单视角下的准确性,并使用KL散度来衡量跨视角的一致性;3) 强化学习算法的选择:可以使用各种强化学习算法,如Policy Gradient或Actor-Critic。

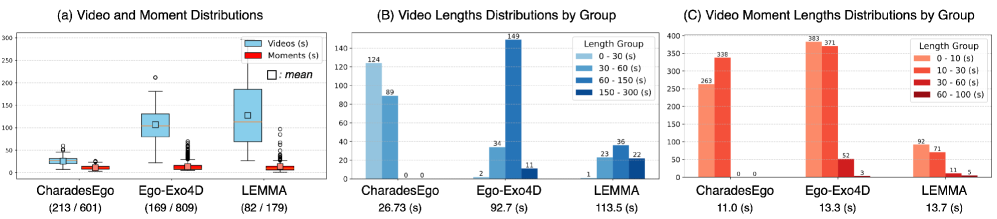

🖼️ 关键图片

📊 实验亮点

实验结果表明,View-GRPO在EgoExo-Con基准上显著优于基线方法,尤其是在跨视角一致性方面。与简单的监督微调相比,View-GRPO能够更好地平衡单视角下的准确性和跨视角的一致性。具体而言,View-GRPO在时序验证和时序定位任务上均取得了显著的提升,证明了其有效性。

🎯 应用场景

该研究成果可应用于机器人导航、自动驾驶、视频监控等领域。例如,在机器人导航中,机器人可以通过结合第一人称视角和第三人称视角的信息,更准确地理解周围环境,从而做出更合理的决策。在自动驾驶中,车辆可以通过分析车载摄像头和路边摄像头拍摄的视频,提高对交通状况的感知能力。在视频监控中,可以利用多视角视频分析技术,提高事件检测的准确性和可靠性。

📄 摘要(原文)

Can Video-LLMs achieve consistent temporal understanding when videos capture the same event from different viewpoints? To study this, we introduce EgoExo-Con (Consistency), a benchmark of comprehensively synchronized egocentric and exocentric video pairs with human-refined queries in natural language. EgoExo-Con emphasizes two temporal understanding tasks: Temporal Verification and Temporal Grounding. It evaluates not only correctness but consistency across viewpoints. Our analysis reveals two critical limitations of existing Video-LLMs: (1) models often fail to maintain consistency, with results far worse than their single-view performances. (2) When naively finetuned with synchronized videos of both viewpoints, the models show improved consistency but often underperform those trained on a single view. For improvements, we propose View-GRPO, a novel reinforcement learning framework that effectively strengthens view-specific temporal reasoning while encouraging consistent comprehension across viewpoints. Our method demonstrates its superiority over naive SFT and GRPO, especially for improving cross-view consistency. All resources will be made publicly available.