Enhancing Temporal Understanding in Video-LLMs through Stacked Temporal Attention in Vision Encoders

作者: Ali Rasekh, Erfan Bagheri Soula, Omid Daliran, Simon Gottschalk, Mohsen Fayyaz

分类: cs.CV

发布日期: 2025-10-29

备注: Accepted to NeurIPS 2025

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出堆叠时间注意力模块,增强Video-LLM在视频时序理解能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: Video-LLM 视频理解 时间注意力 视觉编码器 时序建模 视频问答 动作识别

📋 核心要点

- 现有Video-LLM在理解视频时序动态方面存在不足,难以处理需要理解动作序列和时间进展的任务。

- 论文提出在视觉编码器中引入堆叠的时间注意力模块,以更好地捕捉动作进展和帧间关系。

- 实验结果表明,该方法显著提高了时间推理能力,并在视频问答任务中取得了显著的性能提升,最高达5.5%。

📝 摘要(中文)

多模态大语言模型(MLLM)取得了显著进展,但理解视频中复杂的时序动态仍然是一个主要挑战。我们的实验表明,当前的Video-LLM架构在时间理解方面存在严重局限性,难以处理需要详细理解动作序列和时间进展的任务。本文提出了一种Video-LLM架构,在视觉编码器中直接引入堆叠的时间注意力模块。这种设计在视觉编码器中加入了时间注意力,使模型能够更好地捕捉动作的进展和帧之间的关系,然后再将视觉tokens传递给LLM。结果表明,该方法显著提高了时间推理能力,并在视频问答任务中优于现有模型,特别是在动作识别方面。我们在VITATECS、MVBench和Video-MME等基准测试中提高了高达+5.5%。通过用时间结构增强视觉编码器,我们解决了Video-LLM视频理解中的一个关键缺口。项目页面和代码可在https://alirasekh.github.io/STAVEQ2/ 找到。

🔬 方法详解

问题定义:现有的Video-LLM在处理需要精细时序理解的任务时表现不佳,例如需要理解动作发生的先后顺序、动作之间的因果关系等。它们无法充分利用视频帧之间的时间信息,导致在视频问答、动作识别等任务中性能受限。

核心思路:论文的核心思路是在视觉编码器中引入时间注意力机制,使模型能够显式地学习视频帧之间的时间依赖关系。通过让模型关注不同时间步上的关键帧,从而更好地理解视频中的动作序列和时间进展。

技术框架:该Video-LLM架构主要包含视觉编码器和语言模型两个部分。视觉编码器负责将视频帧编码成视觉tokens,然后将这些tokens传递给语言模型进行处理。关键在于,视觉编码器中加入了堆叠的时间注意力模块,用于捕捉帧之间的时间关系。整体流程是:视频输入 -> 视觉编码器(包含时间注意力模块)-> 视觉tokens -> 语言模型 -> 输出。

关键创新:最重要的创新点是在视觉编码器中引入了堆叠的时间注意力模块。与传统的空间注意力不同,时间注意力关注的是不同时间步上的帧之间的关系。通过堆叠多个时间注意力模块,模型可以学习到更复杂的时序依赖关系。

关键设计:时间注意力模块的具体实现方式未知,但可以推测其可能采用了类似于Transformer中的自注意力机制。关键参数可能包括注意力头的数量、时间窗口的大小等。损失函数的设计也至关重要,可能需要结合视频问答任务的特点进行定制。

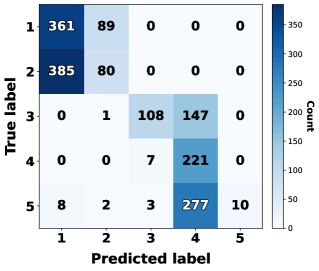

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在VITATECS、MVBench和Video-MME等视频问答基准测试中取得了显著的性能提升,最高提升幅度达到5.5%。这表明,通过在视觉编码器中引入时间注意力模块,可以有效提高Video-LLM的时序理解能力,从而在视频问答等任务中取得更好的性能。

🎯 应用场景

该研究成果可应用于各种需要理解视频时序信息的场景,例如智能监控、自动驾驶、视频内容分析、人机交互等。通过提升Video-LLM的时序理解能力,可以实现更智能的视频分析和理解,为相关应用提供更强大的技术支持,并有望推动视频内容理解和生成领域的发展。

📄 摘要(原文)

Despite significant advances in Multimodal Large Language Models (MLLMs), understanding complex temporal dynamics in videos remains a major challenge. Our experiments show that current Video Large Language Model (Video-LLM) architectures have critical limitations in temporal understanding, struggling with tasks that require detailed comprehension of action sequences and temporal progression. In this work, we propose a Video-LLM architecture that introduces stacked temporal attention modules directly within the vision encoder. This design incorporates a temporal attention in vision encoder, enabling the model to better capture the progression of actions and the relationships between frames before passing visual tokens to the LLM. Our results show that this approach significantly improves temporal reasoning and outperforms existing models in video question answering tasks, specifically in action recognition. We improve on benchmarks including VITATECS, MVBench, and Video-MME by up to +5.5%. By enhancing the vision encoder with temporal structure, we address a critical gap in video understanding for Video-LLMs. Project page and code are available at: https://alirasekh.github.io/STAVEQ2/.