Rethinking Visual Intelligence: Insights from Video Pretraining

作者: Pablo Acuaviva, Aram Davtyan, Mariam Hassan, Sebastian Stapf, Ahmad Rahimi, Alexandre Alahi, Paolo Favaro

分类: cs.CV, cs.AI

发布日期: 2025-10-28 (更新: 2025-11-03)

备注: Updated version from preprint arXiv:2506.07280 (Gen2Gen) focused on visual intelligence. This work can be considered as v2

💡 一句话要点

视频预训练赋能视觉智能:基于视频扩散模型的深度分析与应用

🎯 匹配领域: 支柱八:物理动画 (Physics-based Animation) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视频预训练 视频扩散模型 视觉智能 归纳偏置 时空建模

📋 核心要点

- 现有视觉模型在组合理解、样本效率和通用问题解决方面存在不足,无法有效利用大规模预训练。

- 论文提出利用视频扩散模型(VDMs)进行预训练,赋予模型更强的时空结构和动态归纳偏置,提升任务适应性。

- 实验表明,在多个视觉任务上,预训练的VDM相比预训练的LLM展现出更高的数据效率,验证了视频预训练的有效性。

📝 摘要(中文)

大型语言模型(LLMs)已证明,大规模预训练能够使系统在语言领域以少量监督快速适应新问题。然而,这种成功并未有效地转化为视觉领域,包括LLMs在内的模型仍然难以进行组合理解、样本高效学习和通用问题解决。我们研究了视频扩散模型(VDMs),认为其是弥合这一差距的有希望的方向。在时空数据上进行预训练赋予这些模型强大的结构和动态归纳偏置,我们假设这可以支持广泛的任务适应性。为了验证这一点,我们设计了一个受控评估,其中预训练的LLM和预训练的VDM都配备了轻量级适配器,并呈现了其自然模态的任务。在包括ARC-AGI、ConceptARC、视觉游戏、路线规划和细胞自动机等基准测试中,VDMs表现出比语言模型更高的数据效率。综上所述,我们的结果表明,视频预训练提供的归纳偏置有助于视觉基础模型的进展。

🔬 方法详解

问题定义:现有视觉模型,包括大型语言模型,在视觉领域的组合理解、样本效率和通用问题解决能力上表现不佳。它们难以像在语言领域那样,通过大规模预训练快速适应新的视觉任务。现有方法缺乏对视觉数据内在时空结构和动态信息的有效建模能力。

核心思路:论文的核心思路是利用视频扩散模型(VDMs)进行预训练,从而赋予模型更强的归纳偏置,使其能够更好地理解和处理视觉数据中的时空关系和动态变化。通过在大量视频数据上进行预训练,VDMs能够学习到视觉世界的内在规律,从而提高模型在各种视觉任务上的泛化能力和数据效率。

技术框架:整体框架包括两个主要部分:首先,使用大规模视频数据集对视频扩散模型(VDM)进行预训练。然后,将预训练的VDM与轻量级适配器结合,应用于各种下游视觉任务,例如ARC-AGI、ConceptARC、视觉游戏、路线规划和细胞自动机。同时,为了进行对比,论文还使用了预训练的大型语言模型(LLM)作为基线,并同样配备轻量级适配器。

关键创新:论文的关键创新在于将视频扩散模型(VDMs)应用于视觉领域的预训练,并证明了其在提高数据效率和任务适应性方面的有效性。与传统的图像预训练方法相比,视频预训练能够更好地捕捉视觉数据的时空结构和动态信息,从而赋予模型更强的归纳偏置。

关键设计:论文中VDM的具体架构和训练细节未详细描述,但强调了使用轻量级适配器将预训练模型应用于下游任务。适配器的具体结构和训练方式未知。损失函数方面,VDM通常采用扩散模型的标准损失函数,例如变分下界(Variational Lower Bound, VLB)或其简化版本。具体的网络结构可能基于U-Net或其他常用的视频处理网络。

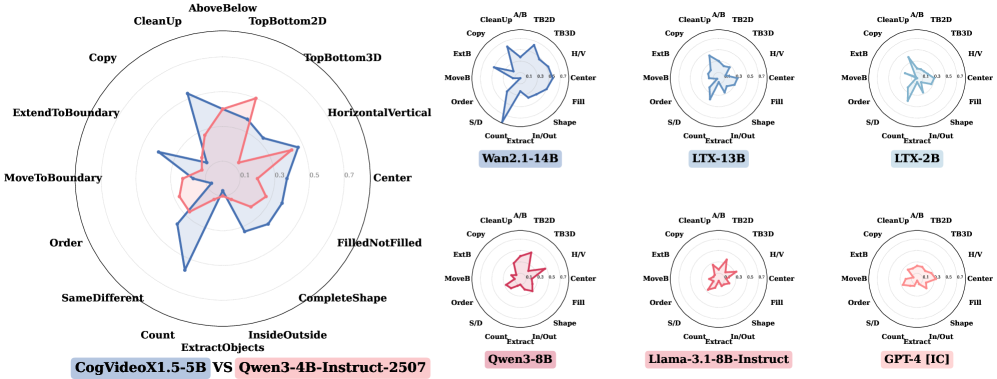

🖼️ 关键图片

📊 实验亮点

实验结果表明,在ARC-AGI、ConceptARC、视觉游戏、路线规划和细胞自动机等多个基准测试中,经过视频预训练的VDM相比经过语言预训练的LLM,展现出更高的数据效率。这意味着VDM在相同数据量下能够取得更好的性能,或者在更少的数据量下达到相同的性能水平。具体的性能提升幅度未知,但整体趋势表明视频预训练对于视觉任务具有显著优势。

🎯 应用场景

该研究成果可应用于各种需要理解和处理视频数据的领域,例如自动驾驶、机器人导航、视频监控、智能交通等。通过利用视频预训练模型,可以提高这些应用在复杂环境下的感知和决策能力,并降低对大量标注数据的依赖。未来,该方法有望推动视觉基础模型的发展,实现更通用、更智能的视觉系统。

📄 摘要(原文)

Large language models (LLMs) have demonstrated that large-scale pretraining enables systems to adapt rapidly to new problems with little supervision in the language domain. This success, however, has not translated as effectively to the visual domain, where models, including LLMs, continue to struggle with compositional understanding, sample efficiency, and general-purpose problem-solving. We investigate Video Diffusion Models (VDMs) as a promising direction for bridging this gap. Pretraining on spatiotemporal data endows these models with strong inductive biases for structure and dynamics, which we hypothesize can support broad task adaptability. To test this, we design a controlled evaluation in which both a pretrained LLM and a pretrained VDM are equipped with lightweight adapters and presented with tasks in their natural modalities. Across benchmarks including ARC-AGI, ConceptARC, visual games, route planning, and cellular automata, VDMs demonstrate higher data efficiency than their language counterparts. Taken together, our results indicate that video pretraining offers inductive biases that support progress toward visual foundation models.