MMSD3.0: A Multi-Image Benchmark for Real-World Multimodal Sarcasm Detection

作者: Haochen Zhao, Yuyao Kong, Yongxiu Xu, Gaopeng Gou, Hongbo Xu, Yubin Wang, Haoliang Zhang

分类: cs.CV, cs.MM

发布日期: 2025-10-27

💡 一句话要点

提出MMSD3.0多图讽刺检测基准和CIRM模型,解决真实场景多图线索讽刺识别问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态讽刺检测 多图推理 跨模态融合 图像序列建模 自然语言处理

📋 核心要点

- 现有讽刺检测数据集主要关注单张图像,忽略了真实场景中多图之间的语义和情感关联。

- 论文提出跨图像推理模型(CIRM),通过跨图像序列建模捕捉图像间的潜在联系。

- 实验表明,MMSD3.0是一个有效可靠的基准,CIRM在多个数据集上取得了SOTA性能。

📝 摘要(中文)

尽管多模态讽刺检测取得了进展,但现有数据集和方法主要集中在单图像场景,忽略了多图像之间潜在的语义和情感关系。这导致在真实场景中,由多图像线索触发的讽刺情况缺乏建模。为了弥补这一差距,我们推出了MMSD3.0,这是一个完全由来自推特和亚马逊评论的多图像样本组成的新基准。我们进一步提出了跨图像推理模型(CIRM),该模型执行有针对性的跨图像序列建模,以捕获潜在的图像间连接。此外,我们引入了一种基于文本-图像对应关系的相关性引导的细粒度跨模态融合机制,以减少集成过程中的信息损失。我们建立了一套全面的强大且具有代表性的基线,并进行了广泛的实验,表明MMSD3.0是一个有效且可靠的基准,能够更好地反映真实世界的条件。此外,CIRM在MMSD、MMSD2.0和MMSD3.0上都表现出了最先进的性能,验证了其在单图像和多图像场景中的有效性。

🔬 方法详解

问题定义:现有讽刺检测方法和数据集主要集中于单张图像,无法有效处理真实世界中由多张图像共同表达讽刺含义的情况。这些方法忽略了图像之间的语义关联和情感互动,导致在多图场景下的讽刺检测性能不佳。

核心思路:论文的核心思路是通过建模多张图像之间的关系来提升讽刺检测的准确性。具体而言,通过跨图像序列建模,捕捉图像之间的潜在联系,从而更好地理解多图所表达的整体含义。同时,利用文本信息引导跨模态融合,减少信息损失。

技术框架:CIRM模型主要包含以下几个模块:1) 图像特征提取模块,用于提取每张图像的视觉特征;2) 跨图像序列建模模块,用于捕捉图像之间的关系,例如使用Transformer或LSTM等序列模型;3) 文本特征提取模块,用于提取文本的语义特征;4) 相关性引导的跨模态融合模块,利用文本信息指导图像特征和文本特征的融合;5) 分类器,用于最终的讽刺判断。

关键创新:论文的关键创新在于提出了跨图像推理模型(CIRM),该模型能够有效地建模多张图像之间的关系,从而更好地理解多图所表达的讽刺含义。此外,论文还提出了相关性引导的跨模态融合机制,利用文本信息指导图像特征和文本特征的融合,减少了信息损失。与现有方法相比,CIRM能够更好地捕捉多图场景下的讽刺线索。

关键设计:在跨图像序列建模模块中,可以使用Transformer或LSTM等序列模型。相关性引导的跨模态融合机制可以通过注意力机制实现,利用文本特征作为query,计算图像特征的权重,从而实现有选择性的融合。损失函数可以使用交叉熵损失函数,用于训练分类器。具体的网络结构和参数设置需要根据具体的数据集和实验结果进行调整。

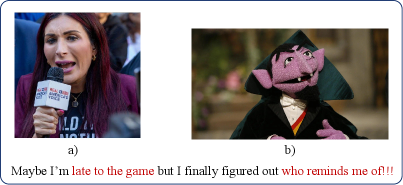

🖼️ 关键图片

📊 实验亮点

实验结果表明,MMSD3.0是一个有效且可靠的基准,能够更好地反映真实世界的条件。CIRM模型在MMSD、MMSD2.0和MMSD3.0数据集上都取得了state-of-the-art的性能,验证了其在单图像和多图像场景中的有效性。相较于其他基线模型,CIRM在多图讽刺检测任务上取得了显著的性能提升。

🎯 应用场景

该研究成果可应用于社交媒体内容审核、舆情分析、智能客服等领域。通过准确识别讽刺言论,可以有效过滤不良信息,提升用户体验,并为企业提供更精准的市场分析。未来,该技术有望进一步拓展到广告欺诈检测、虚假新闻识别等领域,具有重要的社会价值和商业前景。

📄 摘要(原文)

Despite progress in multimodal sarcasm detection, existing datasets and methods predominantly focus on single-image scenarios, overlooking potential semantic and affective relations across multiple images. This leaves a gap in modeling cases where sarcasm is triggered by multi-image cues in real-world settings. To bridge this gap, we introduce MMSD3.0, a new benchmark composed entirely of multi-image samples curated from tweets and Amazon reviews. We further propose the Cross-Image Reasoning Model (CIRM), which performs targeted cross-image sequence modeling to capture latent inter-image connections. In addition, we introduce a relevance-guided, fine-grained cross-modal fusion mechanism based on text-image correspondence to reduce information loss during integration. We establish a comprehensive suite of strong and representative baselines and conduct extensive experiments, showing that MMSD3.0 is an effective and reliable benchmark that better reflects real-world conditions. Moreover, CIRM demonstrates state-of-the-art performance across MMSD, MMSD2.0 and MMSD3.0, validating its effectiveness in both single-image and multi-image scenarios.