Bi-Encoder Contrastive Learning for Fingerprint and Iris Biometrics

作者: Matthew So, Judah Goldfeder, Mark Lis, Hod Lipson

分类: cs.CV, cs.LG

发布日期: 2025-10-27

🔗 代码/项目: GITHUB

💡 一句话要点

利用Bi-Encoder对比学习探索指纹和虹膜生物特征的相关性

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 生物特征识别 对比学习 Bi-Encoder 指纹识别 虹膜识别 Vision Transformer 多模态融合

📋 核心要点

- 传统生物识别假设个体生物特征彼此独立,但缺乏充分验证,可能影响身份验证系统的准确性。

- 论文提出使用Bi-Encoder架构和对比学习,训练ResNet-50和Vision Transformer,学习个体生物特征的嵌入表示。

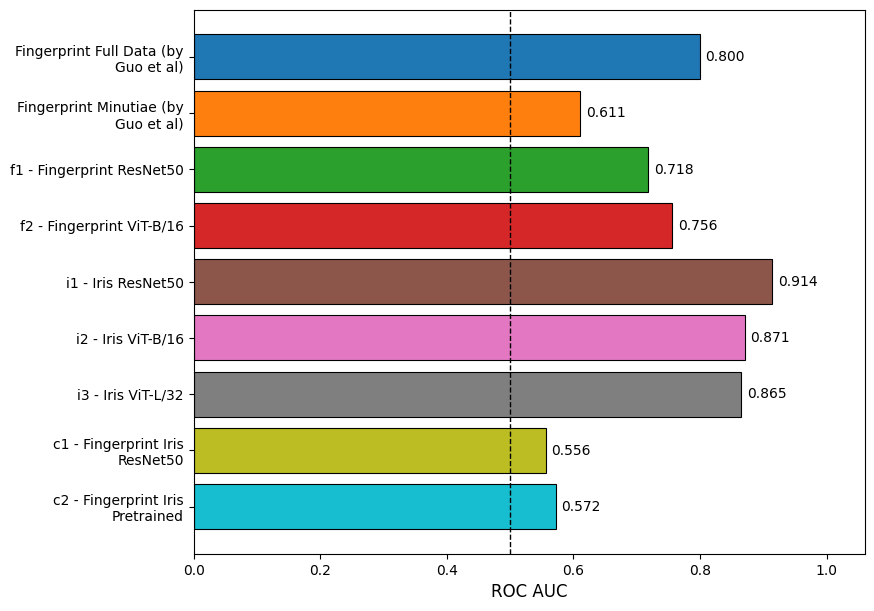

- 实验表明,同一个人左右虹膜具有高度相关性(AUC 0.91),指纹也存在一定相关性,但跨模态匹配效果不佳。

📝 摘要(中文)

本文研究了个人生物特征在统计上是否不相关的假设。作者在指纹-指纹匹配、虹膜-虹膜匹配和跨模态指纹-虹膜匹配三个验证任务上,使用包含约10万张指纹和7千张虹膜图像的274名受试者数据,训练了Bi-Encoder网络。该网络采用ResNet-50和Vision Transformer作为骨干网络,通过最小化来自同一个人的图像之间的对比损失进行训练。虹膜ResNet架构在虹膜-虹膜匹配中达到了91%的ROC AUC分数,证明了个体左右虹膜之间存在相关性。指纹模型重现了先前研究中提出的积极的受试者内相关性。这是首次尝试使用Vision Transformer进行此类匹配。跨模态匹配仅略高于随机水平,表明需要更多数据和更复杂的流程才能获得令人信服的结果。这些发现继续挑战生物特征的独立性假设,未来计划将这项工作扩展到其他生物特征。

🔬 方法详解

问题定义:论文旨在检验生物特征识别领域中长期存在的“个体生物特征在统计上不相关”的假设。现有方法通常独立处理各种生物特征,忽略了它们之间可能存在的潜在关联,这可能导致身份验证系统的性能瓶颈。

核心思路:论文的核心思路是利用Bi-Encoder架构和对比学习,学习不同生物特征的嵌入表示。通过最小化来自同一个人的不同生物特征样本之间的距离,来挖掘和利用它们之间的相关性。这种方法能够有效地捕捉个体生物特征之间的潜在联系,从而提高生物特征识别的准确性和鲁棒性。

技术框架:整体框架包含两个并行的编码器(Bi-Encoder),分别用于提取不同生物特征的特征向量。具体流程如下:1) 输入一对生物特征图像(例如,左虹膜和右虹膜,或指纹和虹膜);2) 使用各自的编码器提取特征向量;3) 计算两个特征向量之间的相似度;4) 使用对比损失函数训练网络,使得来自同一个人的生物特征对的相似度最大化,来自不同人的生物特征对的相似度最小化。

关键创新:论文的关键创新在于:1) 首次使用Bi-Encoder架构和对比学习来探索不同生物特征之间的相关性;2) 首次尝试将Vision Transformer应用于指纹和虹膜的匹配任务;3) 通过实验验证了同一个人左右虹膜之间存在高度相关性,挑战了生物特征独立性的传统假设。

关键设计:论文的关键设计包括:1) 使用ResNet-50和Vision Transformer作为Bi-Encoder的骨干网络,以提取高质量的特征表示;2) 采用对比损失函数,鼓励来自同一个人的生物特征对的嵌入向量更加接近;3) 针对不同的生物特征匹配任务,调整了网络结构和训练策略,以获得最佳性能。

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用ResNet架构的虹膜匹配模型达到了91%的ROC AUC,显著高于随机水平,证明了个体左右虹膜之间存在高度相关性。指纹匹配实验也重现了先前研究中发现的受试者内相关性。虽然跨模态匹配效果不佳,但为未来的研究提供了方向,表明需要更多数据和更复杂的模型。

🎯 应用场景

该研究成果可应用于多模态生物特征识别系统,通过融合不同生物特征的信息,提高身份验证的准确性和安全性。例如,在安全访问控制、金融支付、刑侦等领域,可以利用生物特征之间的相关性,构建更可靠的身份验证系统。未来的研究可以探索更多生物特征之间的关联,并开发更先进的融合算法。

📄 摘要(原文)

There has been a historic assumption that the biometrics of an individual are statistically uncorrelated. We test this assumption by training Bi-Encoder networks on three verification tasks, including fingerprint-to-fingerprint matching, iris-to-iris matching, and cross-modal fingerprint-to-iris matching using 274 subjects with $\sim$100k fingerprints and 7k iris images. We trained ResNet-50 and Vision Transformer backbones in Bi-Encoder architectures such that the contrastive loss between images sampled from the same individual is minimized. The iris ResNet architecture reaches 91 ROC AUC score for iris-to-iris matching, providing clear evidence that the left and right irises of an individual are correlated. Fingerprint models reproduce the positive intra-subject suggested by prior work in this space. This is the first work attempting to use Vision Transformers for this matching. Cross-modal matching rises only slightly above chance, which suggests that more data and a more sophisticated pipeline is needed to obtain compelling results. These findings continue challenge independence assumptions of biometrics and we plan to extend this work to other biometrics in the future. Code available: https://github.com/MatthewSo/bio_fingerprints_iris.