Windsock is Dancing: Adaptive Multimodal Retrieval-Augmented Generation

作者: Shu Zhao, Tianyi Shen, Nilesh Ahuja, Omesh Tickoo, Vijaykrishnan Narayanan

分类: cs.CV, cs.CL, cs.IR

发布日期: 2025-10-26

备注: Accepted at NeurIPS 2025 UniReps Workshop

💡 一句话要点

Windsock:自适应多模态检索增强生成,提升MLLM响应质量与效率

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态检索增强生成 大型语言模型 自适应检索 模态选择 指令调优 知识库 动态抗噪

📋 核心要点

- 现有MRAG方法在检索时机、模态选择和信息利用方面存在不足,导致计算开销大且响应质量不高。

- Windsock通过查询依赖模块自适应地决定检索必要性和模态选择,DANCE指令调优增强模型对检索信息的利用和抗噪能力。

- 实验结果表明,该方法在提升生成质量的同时,显著降低了检索时间,验证了其有效性。

📝 摘要(中文)

多模态检索增强生成(MRAG)通过整合外部知识库的非参数知识,为多模态大型语言模型(MLLM)生成事实性和最新响应提供了一种有前景的方法。然而,现有的MRAG方法存在静态检索策略、不灵活的模态选择以及检索信息利用不佳等问题,导致三个关键挑战:何时检索、整合何种模态以及如何有效利用检索信息。为了解决这些挑战,我们引入了Windsock,一个查询相关的模块,可以决定检索的必要性和模态选择,从而有效地减少计算开销并提高响应质量。此外,我们提出了动态抗噪(DANCE)指令调优,这是一种自适应训练策略,可以增强MLLM利用检索信息的能力,同时保持对噪声的鲁棒性。此外,我们采用了一种自我评估方法,利用MLLM内部的知识将问答数据集转换为MRAG训练数据集。大量的实验表明,我们提出的方法显著提高了生成质量,提高了17.07%,同时减少了8.95%的检索时间。

🔬 方法详解

问题定义:现有的多模态检索增强生成(MRAG)方法面临三个主要问题:一是静态的检索策略无法根据查询自适应地决定何时进行检索;二是模态选择不灵活,无法根据查询选择最合适的模态信息;三是对检索到的信息利用率不高,且容易受到噪声信息的影响。这些问题导致计算资源浪费,并且影响了生成响应的质量。

核心思路:论文的核心思路是设计一个自适应的MRAG框架,使其能够根据查询动态地决定是否需要检索以及检索哪种模态的信息。同时,通过一种动态抗噪的训练策略,提高模型对检索信息的利用率,并增强其对噪声的鲁棒性。这样可以减少不必要的检索,提高检索效率,并提升生成响应的质量。

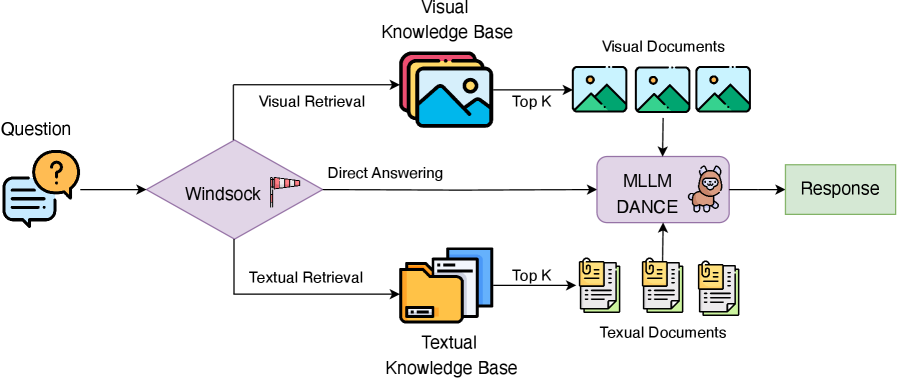

技术框架:整体框架包含三个主要模块:1) 查询依赖的检索与模态选择模块(Windsock),该模块根据输入查询决定是否进行检索以及选择哪种模态的信息;2) 检索模块,根据Windsock的决策,从外部知识库中检索相关信息;3) 多模态大型语言模型(MLLM),将查询和检索到的信息作为输入,生成最终的响应。此外,还包含一个动态抗噪(DANCE)指令调优模块,用于训练MLLM。

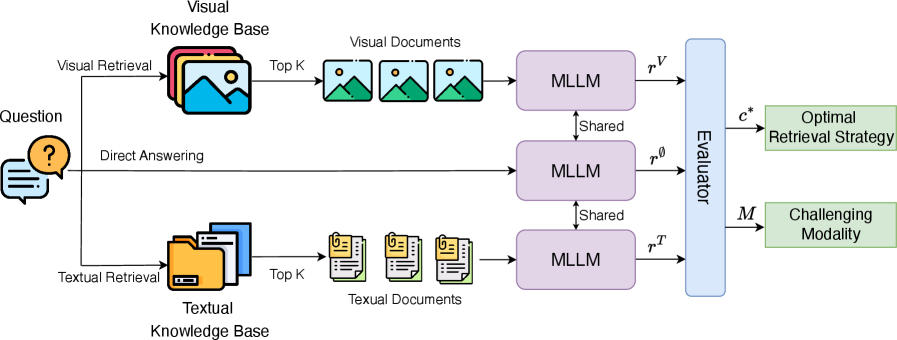

关键创新:论文的关键创新在于Windsock模块和DANCE指令调优策略。Windsock模块实现了查询依赖的自适应检索和模态选择,避免了不必要的检索和模态信息的引入。DANCE指令调优策略通过自适应地调整训练样本中的噪声比例,提高了模型对检索信息的利用率和抗噪能力。与现有方法相比,该方法能够更有效地利用外部知识,并生成更高质量的响应。

关键设计:Windsock模块的具体实现细节未知,但可以推测其可能使用了分类器或回归器来预测检索的必要性和模态选择。DANCE指令调优策略的关键在于如何动态地调整训练样本中的噪声比例,这可能涉及到对模型预测结果的评估以及根据评估结果调整噪声比例的机制。此外,论文还采用了一种自我评估方法,利用MLLM内部的知识将问答数据集转换为MRAG训练数据集,具体实现细节未知。

🖼️ 关键图片

📊 实验亮点

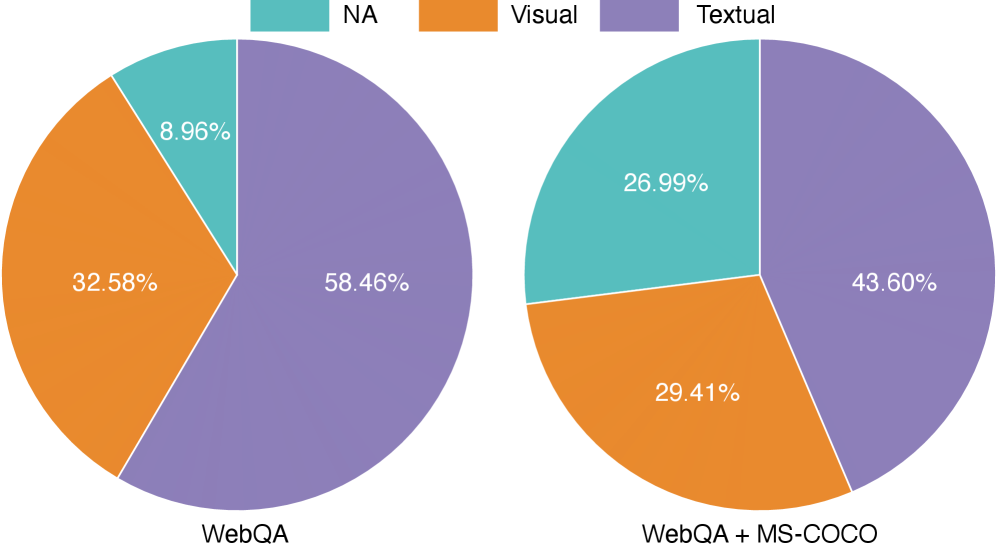

实验结果表明,该方法在生成质量方面取得了显著提升,提高了17.07%,同时减少了8.95%的检索时间。这些数据表明,该方法能够有效地利用外部知识,并提高生成效率。具体的实验设置、数据集和对比基线未知。

🎯 应用场景

该研究成果可应用于各种需要利用外部知识的多模态问答、对话系统和内容生成任务中。例如,可以用于构建更智能的客服机器人、更准确的图像描述生成系统,以及更具信息量的多媒体内容创作工具。该方法能够提升这些应用的信息准确性和时效性,并降低计算成本。

📄 摘要(原文)

Multimodal Retrieval-Augmented Generation (MRAG) has emerged as a promising method to generate factual and up-to-date responses of Multimodal Large Language Models (MLLMs) by incorporating non-parametric knowledge from external knowledge bases. However, existing MRAG approaches suffer from static retrieval strategies, inflexible modality selection, and suboptimal utilization of retrieved information, leading to three critical challenges: determining when to retrieve, what modality to incorporate, and how to utilize retrieved information effectively. To address these challenges, we introduce Windsock, a query-dependent module making decisions on retrieval necessity and modality selection, effectively reducing computational overhead and improving response quality. Additionally, we propose Dynamic Noise-Resistance (DANCE) Instruction Tuning, an adaptive training strategy that enhances MLLMs' ability to utilize retrieved information while maintaining robustness against noise. Moreover, we adopt a self-assessment approach leveraging knowledge within MLLMs to convert question-answering datasets to MRAG training datasets. Extensive experiments demonstrate that our proposed method significantly improves the generation quality by 17.07% while reducing 8.95% retrieval times.