LongCat-Video Technical Report

作者: Meituan LongCat Team, Xunliang Cai, Qilong Huang, Zhuoliang Kang, Hongyu Li, Shijun Liang, Liya Ma, Siyu Ren, Xiaoming Wei, Rixu Xie, Tong Zhang

分类: cs.CV

发布日期: 2025-10-25 (更新: 2025-10-28)

💡 一句话要点

LongCat-Video:基于扩散Transformer的高效长视频生成模型

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 长视频生成 扩散Transformer DiT 视频延续 时空超分 块稀疏注意力 多奖励RLHF 视频生成模型

📋 核心要点

- 现有视频生成模型在生成长视频时,面临质量下降和时间连贯性不足的挑战。

- LongCat-Video通过在视频延续任务上预训练,并采用时空粗到精的生成策略,提升长视频生成质量。

- 该模型通过多奖励RLHF训练,在多个视频生成任务上取得了与领先模型相当的性能。

📝 摘要(中文)

LongCat-Video是一个拥有136亿参数的基础视频生成模型,在多个视频生成任务中表现出色,尤其擅长高效、高质量的长视频生成,代表了美团在世界模型方向上迈出的第一步。该模型具有以下关键特性:统一的多任务架构,基于扩散Transformer(DiT)框架,支持文本到视频、图像到视频和视频延续任务;长视频生成能力,通过在视频延续任务上的预训练,能够生成数分钟的高质量、时间连贯的视频;高效推理,采用时空粗到精的生成策略,能够在几分钟内生成720p、30fps的视频,并通过块稀疏注意力进一步提高效率,尤其是在高分辨率下;以及通过多奖励RLHF训练,性能与最新的闭源和领先的开源模型相当。代码和模型权重已公开。

🔬 方法详解

问题定义:现有视频生成模型在生成长视频时,往往面临计算资源消耗大、时间连贯性难以保持以及生成质量下降等问题。特别是在高分辨率下,这些问题会更加突出。现有方法难以兼顾长视频生成的高效性和高质量。

核心思路:LongCat-Video的核心思路是利用扩散Transformer(DiT)的强大生成能力,结合视频延续任务的预训练,以及时空粗到精的生成策略,从而实现高效、高质量的长视频生成。通过预训练,模型能够学习到视频的时间动态特性,而粗到精的策略则能够降低计算复杂度,并逐步提升生成质量。

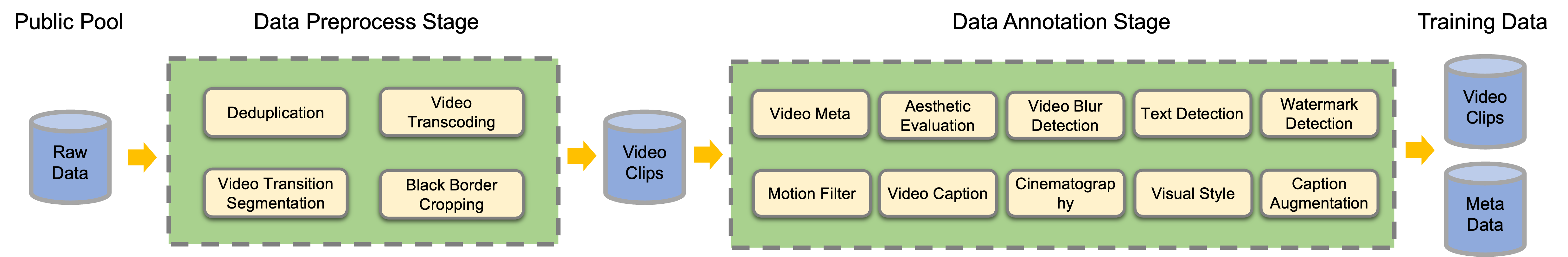

技术框架:LongCat-Video基于扩散Transformer(DiT)框架构建,采用统一的架构支持文本到视频、图像到视频和视频延续等多种任务。其整体流程包括:首先,对输入文本或图像进行编码;然后,利用DiT进行视频帧的生成;最后,通过时空超分模块,将生成的低分辨率视频帧提升到目标分辨率。模型还采用了块稀疏注意力机制,以进一步提高计算效率。

关键创新:LongCat-Video的关键创新在于其高效的长视频生成能力。这主要得益于以下几点:1) 在视频延续任务上的预训练,使得模型能够更好地理解视频的时间动态特性;2) 时空粗到精的生成策略,降低了计算复杂度,并逐步提升生成质量;3) 块稀疏注意力机制,进一步提高了计算效率,尤其是在高分辨率下。

关键设计:LongCat-Video的关键设计包括:1) 采用扩散Transformer(DiT)作为生成器,利用其强大的生成能力;2) 在视频延续任务上进行预训练,以学习视频的时间动态特性;3) 采用时空粗到精的生成策略,包括时间上的粗采样和空间上的超分;4) 使用块稀疏注意力机制,以降低计算复杂度;5) 通过多奖励RLHF进行微调,以提升生成视频的质量和用户满意度。

🖼️ 关键图片

📊 实验亮点

LongCat-Video通过在视频延续任务上的预训练,显著提升了长视频生成的时间连贯性。采用时空粗到精的生成策略,能够在几分钟内生成720p、30fps的视频。通过多奖励RLHF训练,LongCat-Video在视频生成质量上与最新的闭源和领先的开源模型达到了相当的水平。模型和代码已开源。

🎯 应用场景

LongCat-Video在内容创作、游戏开发、虚拟现实、教育娱乐等领域具有广泛的应用前景。它可以用于生成电影片段、游戏场景、虚拟人物对话等内容,降低视频制作的成本和门槛。此外,该模型还可以用于视频修复、视频编辑等任务,提升视频质量和用户体验。未来,LongCat-Video有望成为构建通用世界模型的重要组成部分。

📄 摘要(原文)

Video generation is a critical pathway toward world models, with efficient long video inference as a key capability. Toward this end, we introduce LongCat-Video, a foundational video generation model with 13.6B parameters, delivering strong performance across multiple video generation tasks. It particularly excels in efficient and high-quality long video generation, representing our first step toward world models. Key features include: Unified architecture for multiple tasks: Built on the Diffusion Transformer (DiT) framework, LongCat-Video supports Text-to-Video, Image-to-Video, and Video-Continuation tasks with a single model; Long video generation: Pretraining on Video-Continuation tasks enables LongCat-Video to maintain high quality and temporal coherence in the generation of minutes-long videos; Efficient inference: LongCat-Video generates 720p, 30fps videos within minutes by employing a coarse-to-fine generation strategy along both the temporal and spatial axes. Block Sparse Attention further enhances efficiency, particularly at high resolutions; Strong performance with multi-reward RLHF: Multi-reward RLHF training enables LongCat-Video to achieve performance on par with the latest closed-source and leading open-source models. Code and model weights are publicly available to accelerate progress in the field.