MOGRAS: Human Motion with Grasping in 3D Scenes

作者: Kunal Bhosikar, Siddharth Katageri, Vivek Madhavaram, Kai Han, Charu Sharma

分类: cs.CV, cs.GR, cs.RO

发布日期: 2025-10-25

备注: British Machine Vision Conference Workshop - From Scene Understanding to Human Modeling

💡 一句话要点

MOGRAS:提出大规模3D场景中人体抓取交互运动数据集与基准方法

🎯 匹配领域: 支柱四:生成式动作 (Generative Motion) 支柱五:交互与反应 (Interaction & Reaction) 支柱七:动作重定向 (Motion Retargeting) 支柱八:物理动画 (Physics-based Animation)

关键词: 人体运动生成 物体抓取 3D场景 人机交互 数据集 场景感知 运动捕捉

📋 核心要点

- 现有全身运动生成方法难以兼顾3D场景感知和精细的物体抓取任务,导致交互真实感不足。

- MOGRAS数据集提供大规模的3D场景中人体抓取交互数据,并提出简单有效的场景感知抓取运动生成方法。

- 实验表明,MOGRAS数据集能有效评估现有方法,且提出的方法能显著提升场景感知抓取运动的真实性。

📝 摘要(中文)

生成与物体交互的逼真全身运动对于机器人、虚拟现实和人机交互至关重要。现有方法虽然能在3D场景中生成全身运动,但缺乏物体抓取等精细任务所需的保真度。另一方面,生成精确抓取运动的方法通常忽略周围的3D场景。为了解决在3D场景中生成物理上合理的全身抓取运动这一挑战,我们引入了MOGRAS(3D场景中人体运动与抓取)数据集。MOGRAS提供了在丰富标注的3D室内场景中进行抓取前的全身行走运动和最终抓取姿势。我们利用MOGRAS来评估现有全身抓取方法,并展示了它们在场景感知生成方面的局限性。此外,我们提出了一种简单而有效的方法来调整现有方法,使其能够在3D场景中无缝工作。通过广泛的定量和定性实验,我们验证了数据集的有效性,并强调了我们提出的方法所取得的显著改进,为更逼真的人机交互铺平了道路。

🔬 方法详解

问题定义:现有方法在生成人体与3D场景交互的全身运动时,要么无法保证抓取动作的精细度和真实性,要么忽略了周围场景的约束,导致生成的运动不自然,缺乏物理合理性。痛点在于缺乏一个既包含全身运动又包含精细抓取动作,同时又与3D场景紧密结合的大规模数据集,以及相应的场景感知的运动生成方法。

核心思路:论文的核心思路是构建一个大规模的、包含3D场景信息的抓取动作数据集MOGRAS,并基于此数据集,通过对现有抓取运动生成方法进行改进,使其能够更好地感知场景信息,从而生成更加自然和真实的抓取交互运动。这样设计的目的是为了弥补现有方法在场景感知方面的不足,并为未来的研究提供一个可靠的基准。

技术框架:MOGRAS数据集包含预抓取阶段的全身行走运动和最终的抓取姿势,这些数据都与详细标注的3D室内场景相关联。论文利用该数据集对现有全身抓取方法进行基准测试,并提出了一种简单的自适应方法,使现有方法能够更好地在3D场景中工作。具体流程包括:数据收集与标注、基准方法评估、自适应方法设计与实现、以及定量和定性实验验证。

关键创新:该论文的关键创新在于构建了MOGRAS数据集,这是一个大规模的、包含3D场景信息的抓取动作数据集。与现有数据集相比,MOGRAS更加注重场景感知,能够为研究人员提供更丰富的场景信息,从而促进相关研究的发展。此外,提出的自适应方法能够有效地提升现有方法在场景感知方面的性能,使其能够生成更加自然和真实的抓取交互运动。

关键设计:论文中提出的自适应方法的具体技术细节未知,摘要中只提到是一种“简单而有效”的方法,用于调整现有方法使其能够在3D场景中无缝工作。具体参数设置、损失函数和网络结构等细节需要在论文正文中查找。数据集的构建细节,包括场景选择、运动捕捉方式、标注方法等也需要在论文中进一步了解。

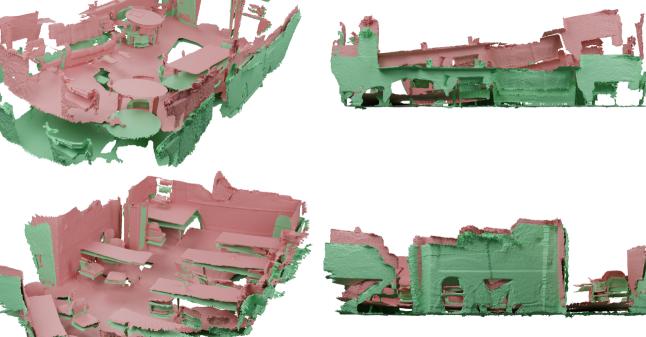

🖼️ 关键图片

📊 实验亮点

论文通过实验验证了MOGRAS数据集的有效性,并证明了提出的自适应方法能够显著提升现有方法在场景感知方面的性能。具体的性能数据和提升幅度需要在论文正文中查找。实验结果表明,该研究为生成更加自然和真实的抓取交互运动提供了新的思路和方法。

🎯 应用场景

该研究成果可广泛应用于机器人技术、虚拟现实、人机交互等领域。例如,可以用于训练机器人完成复杂的抓取任务,提升虚拟现实中人机交互的真实感,以及开发更加智能的人机协作系统。未来,该研究有望推动这些领域的发展,并为人们的生活带来更多便利。

📄 摘要(原文)

Generating realistic full-body motion interacting with objects is critical for applications in robotics, virtual reality, and human-computer interaction. While existing methods can generate full-body motion within 3D scenes, they often lack the fidelity for fine-grained tasks like object grasping. Conversely, methods that generate precise grasping motions typically ignore the surrounding 3D scene. This gap, generating full-body grasping motions that are physically plausible within a 3D scene, remains a significant challenge. To address this, we introduce MOGRAS (Human MOtion with GRAsping in 3D Scenes), a large-scale dataset that bridges this gap. MOGRAS provides pre-grasping full-body walking motions and final grasping poses within richly annotated 3D indoor scenes. We leverage MOGRAS to benchmark existing full-body grasping methods and demonstrate their limitations in scene-aware generation. Furthermore, we propose a simple yet effective method to adapt existing approaches to work seamlessly within 3D scenes. Through extensive quantitative and qualitative experiments, we validate the effectiveness of our dataset and highlight the significant improvements our proposed method achieves, paving the way for more realistic human-scene interactions.