egoEMOTION: Egocentric Vision and Physiological Signals for Emotion and Personality Recognition in Real-World Tasks

作者: Matthias Jammot, Björn Braun, Paul Streli, Rafael Wampfler, Christian Holz

分类: cs.CV, cs.HC

发布日期: 2025-10-25 (更新: 2026-01-14)

备注: Accepted for publication at NeurIPS 2025

💡 一句话要点

egoEMOTION:结合第一视角视觉与生理信号的情感和人格识别数据集

🎯 匹配领域: 支柱六:视频提取与匹配 (Video Extraction)

关键词: 第一视角视觉 情感识别 人格识别 生理信号 多模态数据

📋 核心要点

- 现有第一视角视觉研究忽略了情感和人格对行为的影响,限制了对人类行为的全面理解。

- egoEMOTION数据集结合了第一视角视觉、生理信号和情感/人格自我报告,为情感驱动的行为建模提供数据基础。

- 实验表明,基于第一视角视觉信号的情感预测优于仅使用生理信号,突显了视觉信息在情感识别中的重要性。

📝 摘要(中文)

理解情感是预测人类行为的关键,但目前的第一视角视觉基准测试在很大程度上忽略了影响决策和行动的情绪状态。现有的第一视角感知任务侧重于身体活动、手部-物体交互和注意力建模,假设情感中性和人格一致。这限制了视觉系统捕捉行为关键内部驱动因素的能力。本文提出了egoEMOTION,这是第一个将第一视角视觉和生理信号与受控和真实场景中密集的情感和人格自我报告相结合的数据集。该数据集包含来自43名参与者的超过50小时的记录,使用Meta的Project Aria眼镜捕获。每个会话提供同步的眼动追踪视频、头戴式光电容积脉搏波描记法、惯性运动数据和生理基线作为参考。参与者完成了情绪诱发任务和自然活动,同时使用环形模型和Mikels' Wheel自我报告他们的情感状态,并通过大五模型报告他们的人格。定义了三个基准任务:(1)连续情感分类(效价、唤醒、支配);(2)离散情感分类;(3)特质水平人格推断。结果表明,一种经典的基于学习的方法,作为真实世界情感预测中的一个简单基线,从第一视角视觉系统捕获的信号中产生的估计优于处理生理信号。该数据集将情感和人格确立为第一视角感知的核心维度,并开辟了情感驱动的行为、意图和交互建模的新方向。

🔬 方法详解

问题定义:现有第一视角视觉研究主要关注物理活动、人机交互等,忽略了情感和人格等内在因素对行为的影响。这导致模型无法准确预测和理解人类行为的动机和意图。现有方法无法有效利用第一视角视觉信息进行情感和人格识别。

核心思路:论文的核心思路是将第一视角视觉数据与生理信号、情感和人格的自我报告相结合,构建一个综合性的数据集。通过分析这些多模态数据,可以更好地理解情感和人格如何影响人类在真实世界中的行为。这种方法旨在弥合第一视角视觉感知和情感计算之间的差距。

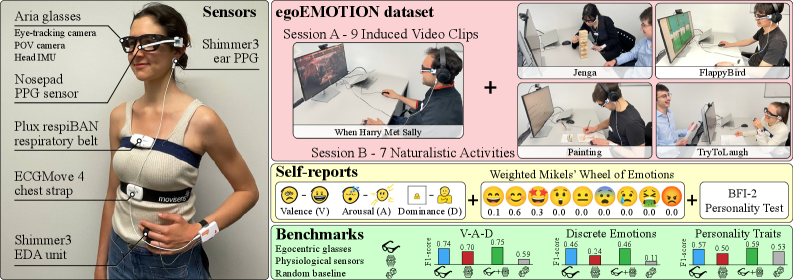

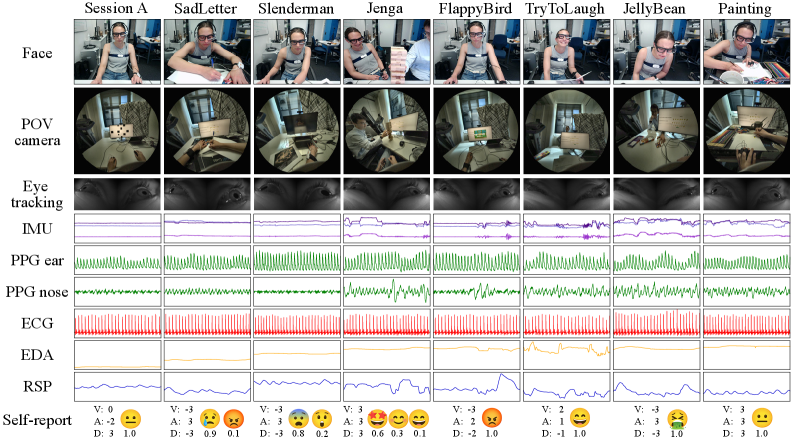

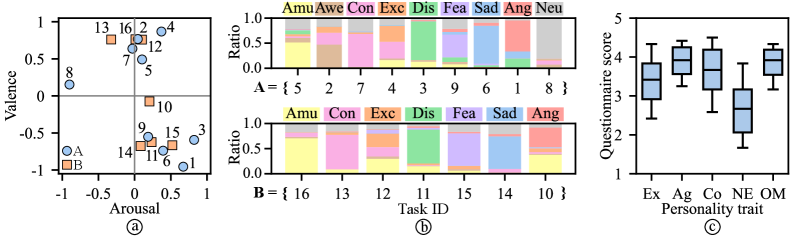

技术框架:egoEMOTION数据集的构建流程包括:1) 使用Meta Project Aria眼镜收集参与者的第一视角视频、眼动追踪数据、惯性运动数据和生理信号(PPG)。2) 参与者在完成特定任务和自然活动的同时,使用环形模型、Mikels' Wheel和大五模型进行情感和人格的自我报告。3) 将收集到的多模态数据进行同步和对齐。4) 定义三个基准任务:连续情感分类、离散情感分类和特质水平人格推断。

关键创新:该论文的关键创新在于构建了一个包含第一视角视觉、生理信号和情感/人格自我报告的综合数据集。这是首个将情感和人格作为第一视角感知核心维度的数据集。此外,论文还定义了三个基准任务,为未来的研究提供了评估标准。

关键设计:数据采集使用了Meta Project Aria眼镜,该设备能够同步记录多种模态的数据。情感自我报告使用了环形模型和Mikels' Wheel,人格自我报告使用了大五模型。基线方法使用了经典的机器学习算法,例如支持向量机(SVM)和随机森林(Random Forest),用于情感和人格的预测。论文没有详细描述损失函数和网络结构,因为主要贡献在于数据集的构建和基准任务的定义。

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用第一视角视觉信号进行情感预测的性能优于仅使用生理信号。这表明视觉信息在情感识别中起着重要作用。论文使用经典的机器学习方法作为基线,为未来的研究提供了一个参考点。虽然没有给出具体的性能数据,但强调了视觉信息的重要性。

🎯 应用场景

该研究成果可应用于情感计算、人机交互、机器人等领域。例如,可以开发能够理解用户情感的智能助手,或者设计能够根据用户人格特征进行个性化交互的机器人。此外,该数据集还可以用于研究情感和人格对驾驶行为、购物决策等真实世界任务的影响。

📄 摘要(原文)

Understanding affect is central to anticipating human behavior, yet current egocentric vision benchmarks largely ignore the person's emotional states that shape their decisions and actions. Existing tasks in egocentric perception focus on physical activities, hand-object interactions, and attention modeling - assuming neutral affect and uniform personality. This limits the ability of vision systems to capture key internal drivers of behavior. In this paper, we present egoEMOTION, the first dataset that couples egocentric visual and physiological signals with dense self-reports of emotion and personality across controlled and real-world scenarios. Our dataset includes over 50 hours of recordings from 43 participants, captured using Meta's Project Aria glasses. Each session provides synchronized eye-tracking video, headmounted photoplethysmography, inertial motion data, and physiological baselines for reference. Participants completed emotion-elicitation tasks and naturalistic activities while self-reporting their affective state using the Circumplex Model and Mikels' Wheel as well as their personality via the Big Five model. We define three benchmark tasks: (1) continuous affect classification (valence, arousal, dominance); (2) discrete emotion classification; and (3) trait-level personality inference. We show that a classical learning-based method, as a simple baseline in real-world affect prediction, produces better estimates from signals captured on egocentric vision systems than processing physiological signals. Our dataset establishes emotion and personality as core dimensions in egocentric perception and opens new directions in affect-driven modeling of behavior, intent, and interaction.