A Flow Model with Low-Rank Transformers for Incomplete Multimodal Survival Analysis

作者: Yi Yin, Yuntao Shou, Zao Dai, Yun Peng, Tao Meng, Wei Ai, Keqin Li

分类: cs.CV

发布日期: 2025-10-22

备注: 12 pages, 4 figures

💡 一句话要点

提出一种基于低秩Transformer的Flow模型,用于不完全多模态生存分析。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态生存分析 不完全数据 Flow模型 低秩Transformer 跨模态分布对齐 医学图像分析 基因组数据

📋 核心要点

- 现有方法在不完全多模态生存分析中,忽略了模态间的分布差异,导致模态重建不一致。

- 提出结合低秩Transformer和Flow模型的框架,通过类特定的Flow模型进行跨模态分布对齐。

- 实验表明,该方法在完整和不完整模态设置下均表现出色,提升了生存预测的准确性。

📝 摘要(中文)

近年来,基于多模态医学数据的生存分析备受关注。然而,现实世界的数据集经常面临模态不完整的问题,由于采集限制或系统故障,一些患者的模态信息缺失。现有方法通常使用深度神经网络直接从观察到的模态推断缺失的模态,但它们常常忽略模态之间的分布差异,导致不一致和不可靠的模态重建。为了应对这些挑战,我们提出了一个新颖的框架,该框架结合了低秩Transformer和基于Flow的生成模型,用于稳健而灵活的多模态生存预测。具体来说,我们首先使用全切片图像(WSI)和基因组图谱的多实例表示,将所关注的问题表述为不完全多模态生存分析。为了实现不完全多模态生存分析,我们提出了一种特定于类别的Flow模型,用于跨模态分布对齐。在类标签的条件下,我们对跨模态分布进行建模和转换。凭借归一化Flow模型的可逆结构和精确的密度建模能力,该模型可以有效地构建缺失模态的分布一致的潜在空间,从而提高重建数据与真实分布之间的一致性。最后,我们设计了一个轻量级的Transformer架构来建模模态内依赖关系,同时通过低秩Transformer缓解高维模态融合中的过拟合问题。大量的实验表明,我们的方法不仅在完整模态设置下实现了最先进的性能,而且在不完整模态场景下也保持了稳健和卓越的准确性。

🔬 方法详解

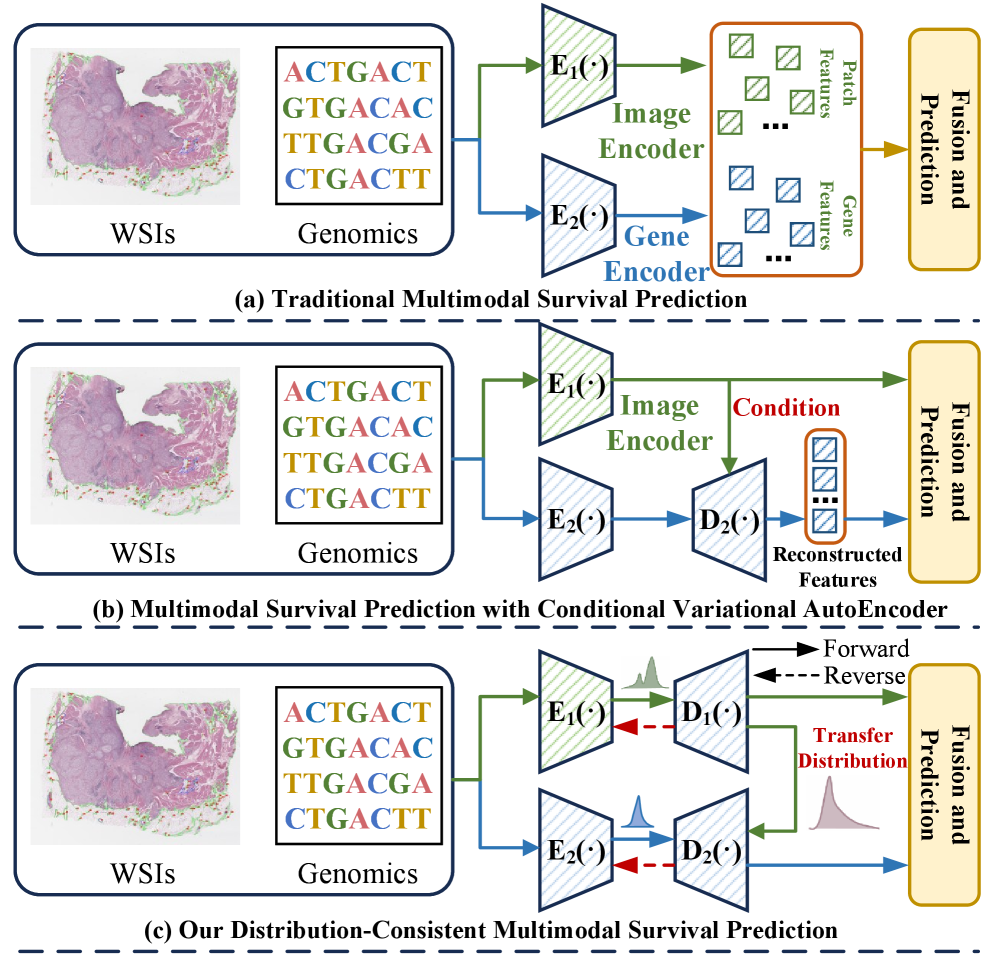

问题定义:论文旨在解决不完全多模态生存分析问题,即在多模态医学数据(如WSI和基因组数据)中,由于数据采集限制等原因,部分模态数据缺失的情况下,如何准确进行生存预测。现有方法主要通过深度神经网络直接推断缺失模态,但忽略了不同模态间的分布差异,导致重建模态与真实分布不一致,影响生存预测的准确性。

核心思路:论文的核心思路是利用Flow模型强大的密度建模能力和可逆性,构建一个分布一致的潜在空间,从而实现更准确的缺失模态重建。同时,利用低秩Transformer建模模态内依赖关系,并缓解高维模态融合中的过拟合问题。通过跨模态分布对齐,确保重建模态与真实分布的一致性,从而提高生存预测的准确性和鲁棒性。

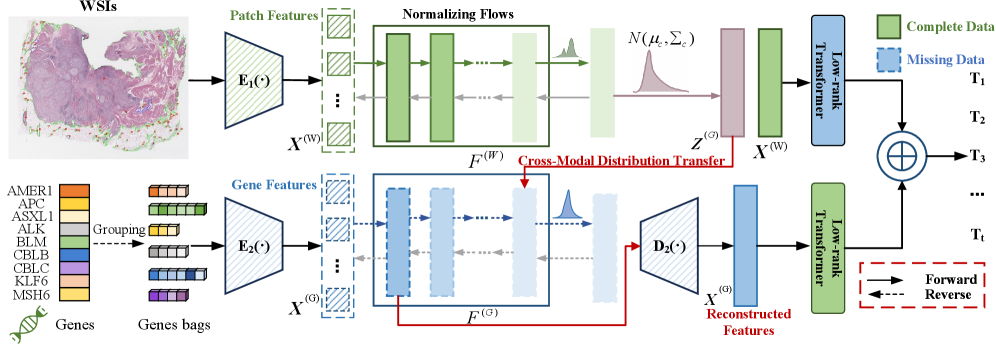

技术框架:整体框架包含三个主要模块:1) 多模态数据输入,包括WSI和基因组数据;2) 基于类别的Flow模型,用于跨模态分布对齐和缺失模态重建;3) 低秩Transformer,用于建模模态内依赖关系和进行模态融合。首先,将多模态数据输入到Flow模型中,在类标签的条件下,对跨模态分布进行建模和转换,生成缺失模态的潜在表示。然后,利用低秩Transformer对各模态的特征进行融合,得到最终的生存预测结果。

关键创新:论文的关键创新在于:1) 提出了一种基于类别的Flow模型,用于跨模态分布对齐,确保重建模态与真实分布的一致性;2) 采用低秩Transformer建模模态内依赖关系,缓解了高维模态融合中的过拟合问题。与现有方法相比,该方法更关注模态间的分布差异,能够更准确地重建缺失模态,从而提高生存预测的准确性和鲁棒性。

关键设计:在Flow模型中,使用了特定于类别的条件变量,以更好地建模不同类别下的模态分布。低秩Transformer通过限制Transformer的参数矩阵的秩,减少了参数数量,从而缓解了过拟合问题。损失函数包括生存预测损失和分布对齐损失,其中分布对齐损失用于约束重建模态与真实分布的一致性。具体的网络结构和参数设置在论文中有详细描述,但此处未提供具体数值。

🖼️ 关键图片

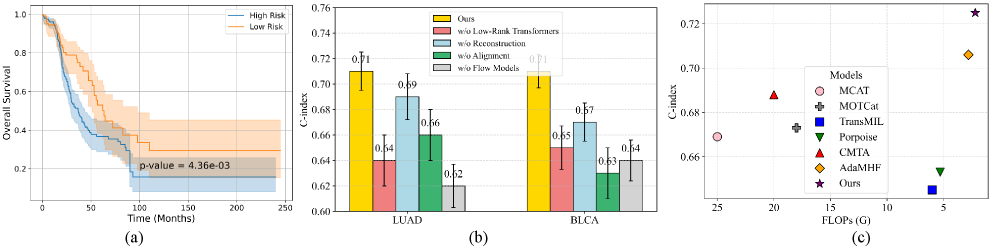

📊 实验亮点

实验结果表明,该方法在完整模态设置下达到了state-of-the-art的性能,并且在不完整模态场景下也保持了稳健和卓越的准确性。具体性能数据和对比基线在论文中有详细描述,但此处未提供具体数值。该方法在不完整模态下的性能提升,证明了其在实际应用中的价值。

🎯 应用场景

该研究成果可应用于多种医学场景,例如癌症生存预测、疾病风险评估等。通过整合基因组数据、影像数据等多模态信息,即使在数据不完整的情况下,也能提供更准确的预测结果,辅助医生进行临床决策,制定个性化的治疗方案,提高患者的生存率和生活质量。未来,该方法有望推广到其他领域,如金融风险评估、智能制造等。

📄 摘要(原文)

In recent years, multimodal medical data-based survival analysis has attracted much attention. However, real-world datasets often suffer from the problem of incomplete modality, where some patient modality information is missing due to acquisition limitations or system failures. Existing methods typically infer missing modalities directly from observed ones using deep neural networks, but they often ignore the distributional discrepancy across modalities, resulting in inconsistent and unreliable modality reconstruction. To address these challenges, we propose a novel framework that combines a low-rank Transformer with a flow-based generative model for robust and flexible multimodal survival prediction. Specifically, we first formulate the concerned problem as incomplete multimodal survival analysis using the multi-instance representation of whole slide images (WSIs) and genomic profiles. To realize incomplete multimodal survival analysis, we propose a class-specific flow for cross-modal distribution alignment. Under the condition of class labels, we model and transform the cross-modal distribution. By virtue of the reversible structure and accurate density modeling capabilities of the normalizing flow model, the model can effectively construct a distribution-consistent latent space of the missing modality, thereby improving the consistency between the reconstructed data and the true distribution. Finally, we design a lightweight Transformer architecture to model intra-modal dependencies while alleviating the overfitting problem in high-dimensional modality fusion by virtue of the low-rank Transformer. Extensive experiments have demonstrated that our method not only achieves state-of-the-art performance under complete modality settings, but also maintains robust and superior accuracy under the incomplete modalities scenario.