Extreme Views: 3DGS Filter for Novel View Synthesis from Out-of-Distribution Camera Poses

作者: Damian Bowness, Charalambos Poullis

分类: cs.CV, cs.GR

发布日期: 2025-10-22

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出基于梯度的3DGS滤波方法,解决极端视角下的新视角合成伪影问题

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 新视角合成 3D高斯溅射 极端视角 梯度滤波 实时渲染

📋 核心要点

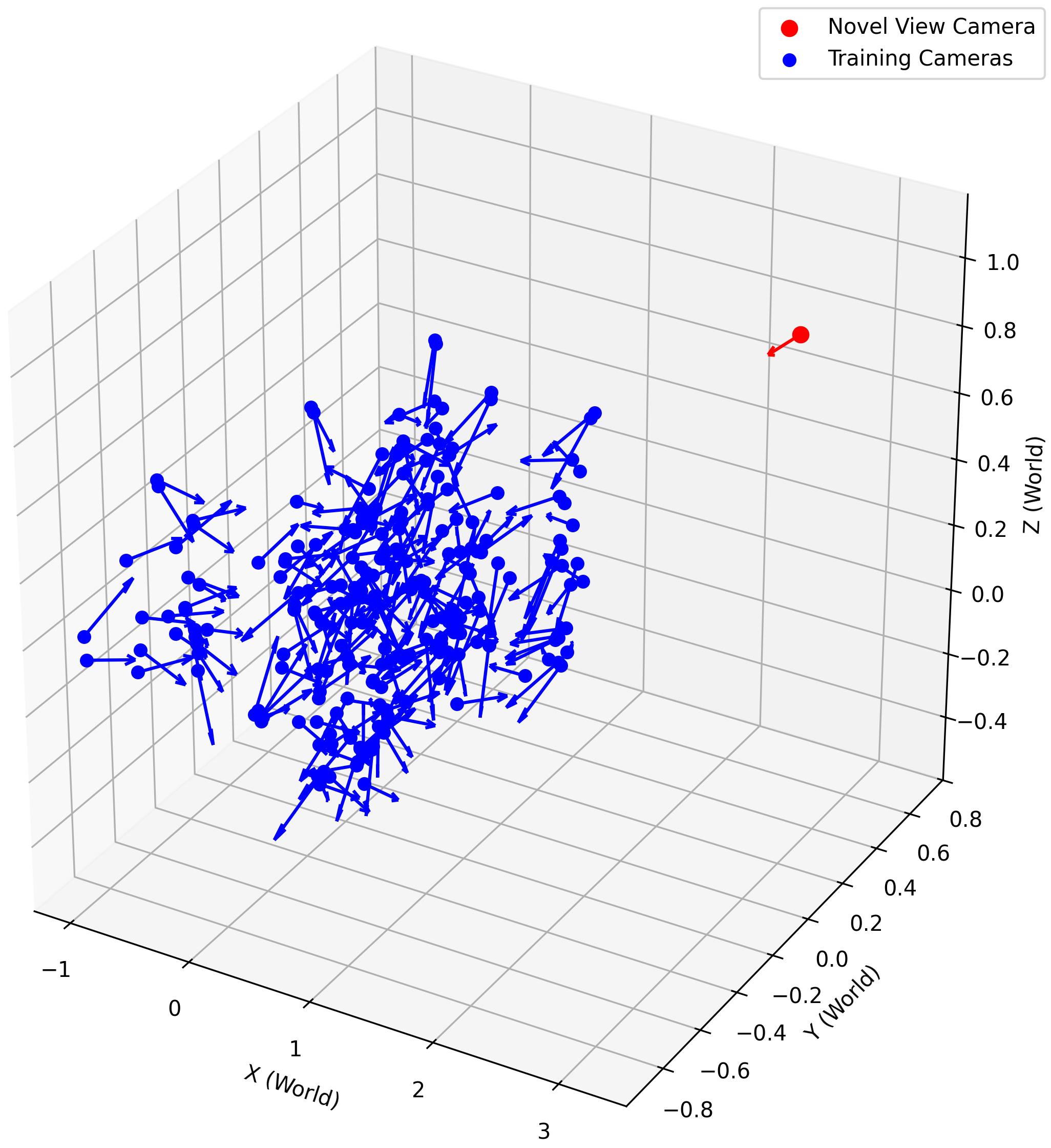

- 现有3DGS在新视角合成中,当相机位姿超出训练分布时,会产生显著视觉噪声,源于外推区域训练数据不足。

- 提出一种实时渲染感知滤波方法,利用中间梯度导出的敏感度分数,针对各向异性方向引起的不稳定性进行滤波。

- 实验表明,该方法显著提高了视觉质量、真实感和一致性,且能无缝集成到现有3DGS渲染管道中,实现实时渲染。

📝 摘要(中文)

当从训练数据分布之外的相机位置观察3D高斯溅射(3DGS)模型时,通常会出现大量的视觉噪声。这些伪影是由于在这些外推区域缺乏训练数据,导致模型对密度、颜色和几何形状的预测不确定。为了解决这个问题,我们提出了一种新的实时渲染感知滤波方法。我们的方法利用从中间梯度导出的敏感度分数,显式地针对由各向异性方向引起的不稳定性,而不是各向同性方差。这种滤波方法直接解决了生成不确定性的核心问题,使得3D重建系统即使在用户自由地在原始训练视点之外导航时,也能保持高视觉保真度。实验评估表明,与基于神经辐射场(NeRF)的方法(如BayesRays)相比,我们的方法显著提高了视觉质量、真实感和一致性。至关重要的是,我们的滤波器可以无缝地集成到现有的3DGS渲染管道中,实现实时渲染,而不需要像其他方法那样进行大量的后验再训练或微调。

🔬 方法详解

问题定义:论文旨在解决3D高斯溅射(3DGS)在新视角合成任务中,当相机位姿超出训练数据分布范围时,产生的视觉伪影问题。现有方法在处理外推视角时,由于缺乏足够的训练数据,导致模型对密度、颜色和几何形状的预测不确定,从而产生噪声和不真实的渲染结果。

核心思路:论文的核心思路是利用渲染过程中的梯度信息来识别和过滤掉不稳定的3D高斯基元。具体来说,通过计算中间梯度导出的敏感度分数,来衡量每个高斯基元对最终渲染结果的影响程度。高敏感度的基元被认为是造成视觉伪影的主要原因,因此需要进行过滤。这种方法直接针对生成不确定性的根源,而不是简单地对渲染结果进行后处理。

技术框架:该方法主要包含以下几个步骤:1)使用3DGS模型进行初步渲染;2)计算渲染过程中的中间梯度,并基于此计算每个高斯基元的敏感度分数;3)根据敏感度分数对高斯基元进行过滤,移除不稳定的基元;4)使用过滤后的高斯基元重新进行渲染,得到最终的新视角图像。该框架可以无缝集成到现有的3DGS渲染管道中,实现实时渲染。

关键创新:该方法最重要的创新点在于利用梯度信息来指导高斯基元的过滤。与传统的基于方差的过滤方法不同,该方法关注的是各向异性方向引起的不稳定性,能够更准确地识别出造成视觉伪影的基元。此外,该方法是渲染感知的,能够直接优化渲染结果,而不是简单地对模型进行后处理。

关键设计:论文的关键设计包括:1)敏感度分数的计算方法,具体如何利用中间梯度来衡量高斯基元的重要性;2)过滤阈值的选择,如何确定哪些高斯基元应该被移除;3)如何将该方法集成到现有的3DGS渲染管道中,以实现实时渲染。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在极端视角下显著提高了新视角合成的视觉质量、真实感和一致性。与基于NeRF的方法(如BayesRays)相比,该方法在视觉质量上取得了显著提升。更重要的是,该方法能够无缝集成到现有的3DGS渲染管道中,实现实时渲染,而不需要额外的训练或微调。

🎯 应用场景

该研究成果可广泛应用于虚拟现实、增强现实、机器人导航、自动驾驶等领域。通过提升新视角合成的质量和鲁棒性,可以为用户提供更逼真、更沉浸式的体验。此外,该方法还可以用于三维重建和场景理解,为机器人和自动驾驶系统提供更准确的环境感知能力。

📄 摘要(原文)

When viewing a 3D Gaussian Splatting (3DGS) model from camera positions significantly outside the training data distribution, substantial visual noise commonly occurs. These artifacts result from the lack of training data in these extrapolated regions, leading to uncertain density, color, and geometry predictions from the model. To address this issue, we propose a novel real-time render-aware filtering method. Our approach leverages sensitivity scores derived from intermediate gradients, explicitly targeting instabilities caused by anisotropic orientations rather than isotropic variance. This filtering method directly addresses the core issue of generative uncertainty, allowing 3D reconstruction systems to maintain high visual fidelity even when users freely navigate outside the original training viewpoints. Experimental evaluation demonstrates that our method substantially improves visual quality, realism, and consistency compared to existing Neural Radiance Field (NeRF)-based approaches such as BayesRays. Critically, our filter seamlessly integrates into existing 3DGS rendering pipelines in real-time, unlike methods that require extensive post-hoc retraining or fine-tuning. Code and results at https://damian-bowness.github.io/EV3DGS