X-Ego: Acquiring Team-Level Tactical Situational Awareness via Cross-Egocentric Contrastive Video Representation Learning

作者: Yunzhe Wang, Soham Hans, Volkan Ustun

分类: cs.CV, cs.AI, cs.LG

发布日期: 2025-10-22

备注: 8 pages, 5 figures

🔗 代码/项目: GITHUB

💡 一句话要点

提出基于跨视角对比学习的X-Ego方法,用于获取团队级战术态势感知

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱六:视频提取与匹配 (Video Extraction) 支柱八:物理动画 (Physics-based Animation)

关键词: 跨视角学习 对比学习 多智能体系统 战术态势感知 电子竞技 视频理解 自我中心视觉

📋 核心要点

- 现有方法主要依赖第三人称视角,忽略了多智能体学习的同步性和自我中心特性,限制了对团队战术的理解。

- 提出跨视角对比学习(CECL),通过对齐队友的自我中心视觉流,使智能体能够从个体视角感知团队级战术态势。

- 在队友-对手位置预测任务上,CECL显著提升了智能体从第一人称视角推断队友和对手位置的能力。

📝 摘要(中文)

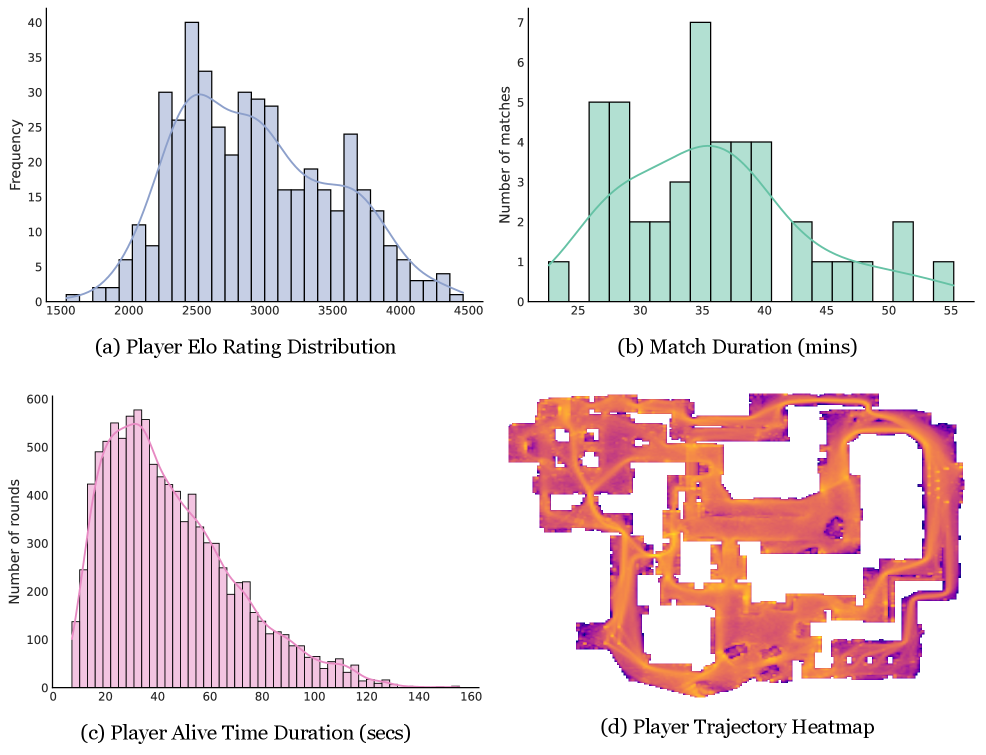

本文提出了一种名为X-Ego-CS的基准数据集,该数据集包含来自45场职业级《反恐精英2》比赛的124小时游戏录像,旨在促进复杂3D环境中多智能体决策的研究。X-Ego-CS提供同步捕获所有玩家第一人称视角的跨视角视频流以及状态-动作轨迹。在此基础上,本文提出跨视角对比学习(CECL),通过对齐队友的自我中心视觉流,从个体视角培养团队级战术态势感知。在队友-对手位置预测任务上的评估表明,CECL能够增强智能体从单个第一人称视角推断队友和对手位置的能力。X-Ego-CS和CECL共同为电子竞技中的跨视角多智能体基准测试奠定了基础。更广泛地说,本文将游戏理解定位为多智能体建模和战术学习的试验台,对虚拟和现实领域中的时空推理和人机协作具有重要意义。

🔬 方法详解

问题定义:现有方法在理解团队战术时,主要依赖于第三人称广播视角,忽略了每个玩家的自我中心视角以及队友之间的同步互动。这导致模型难以捕捉到团队战术的本质,限制了其在复杂多智能体环境中的应用。

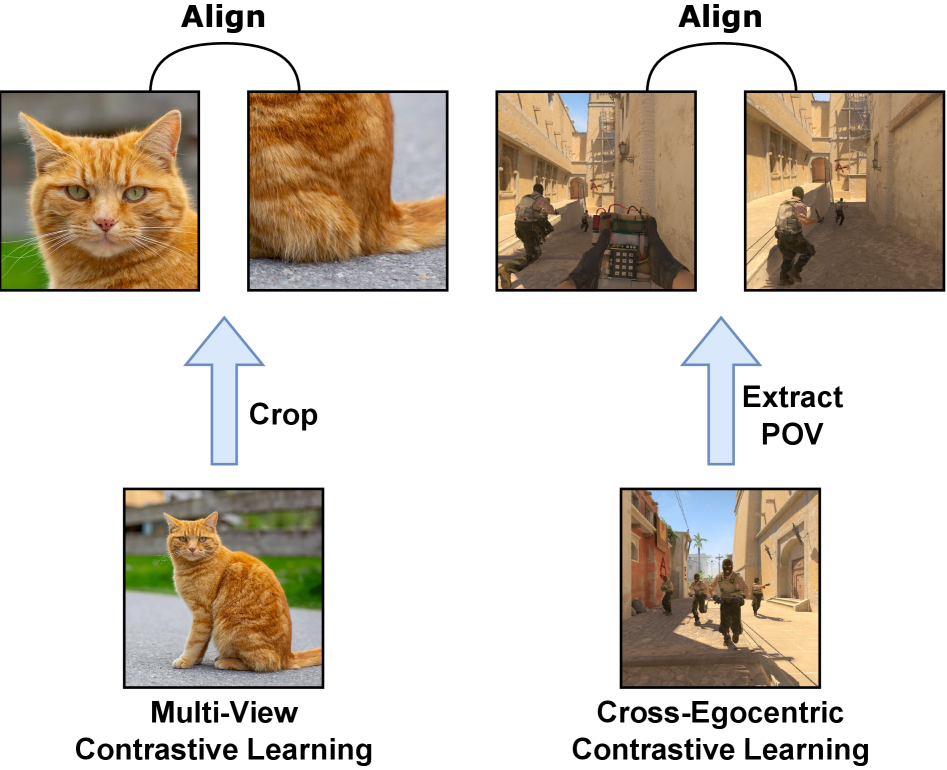

核心思路:本文的核心思路是通过对比学习,将同一团队内不同玩家的自我中心视角视频流对齐,从而使每个智能体能够从自身视角理解整个团队的战术态势。这种方法模拟了人类玩家通过观察队友行为来推断其意图和位置的方式。

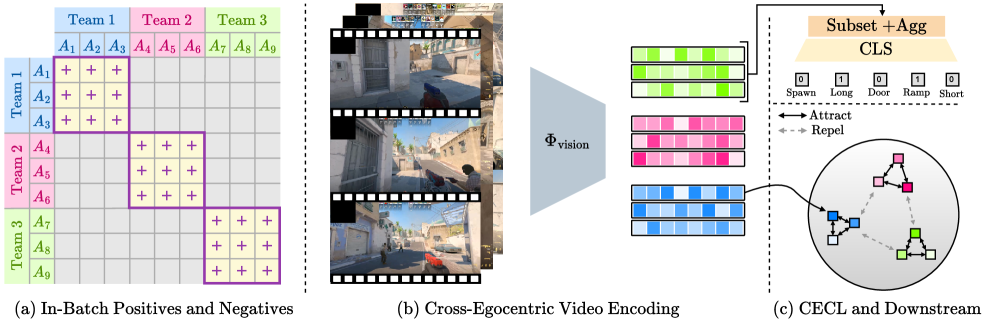

技术框架:整体框架包含两个主要部分:首先是X-Ego-CS数据集,提供同步的多玩家第一人称视角视频流和状态-动作轨迹。其次是Cross-Ego Contrastive Learning (CECL) 模块,该模块利用对比学习损失,促使模型学习到队友视角之间的关联性。具体流程是,输入多个玩家的自我中心视频流,通过视频编码器提取特征,然后利用对比学习损失函数对齐队友的特征表示。

关键创新:最重要的创新点在于将对比学习应用于跨视角的自我中心视频流,从而实现了团队级战术态势感知的学习。与传统的基于第三人称视角的方法相比,CECL能够更好地捕捉到玩家之间的互动和战术意图。

关键设计:CECL的关键设计在于对比学习损失函数的选择和视频编码器的结构。论文使用了InfoNCE损失函数,鼓励模型将同一团队内不同玩家的特征表示拉近,同时推远不同团队玩家的特征表示。视频编码器可以使用各种现有的视频理解模型,例如TimeSformer或SlowFast。

🖼️ 关键图片

📊 实验亮点

实验结果表明,CECL在队友-对手位置预测任务上取得了显著的性能提升。通过对比使用CECL训练的模型和未使用CECL训练的模型,发现CECL能够显著提高智能体预测队友和对手位置的准确率,证明了其在获取团队级战术态势感知方面的有效性。具体性能数据和提升幅度在论文中有详细展示。

🎯 应用场景

该研究成果可应用于电子竞技AI、自动驾驶、机器人协作等领域。通过让AI智能体理解团队成员的意图和行动,可以提升团队协作效率和决策能力。此外,该方法还可以用于训练更智能的对手,提高游戏难度和玩家体验。未来,该研究有望促进人机协作在更广泛领域的应用。

📄 摘要(原文)

Human team tactics emerge from each player's individual perspective and their ability to anticipate, interpret, and adapt to teammates' intentions. While advances in video understanding have improved the modeling of team interactions in sports, most existing work relies on third-person broadcast views and overlooks the synchronous, egocentric nature of multi-agent learning. We introduce X-Ego-CS, a benchmark dataset consisting of 124 hours of gameplay footage from 45 professional-level matches of the popular e-sports game Counter-Strike 2, designed to facilitate research on multi-agent decision-making in complex 3D environments. X-Ego-CS provides cross-egocentric video streams that synchronously capture all players' first-person perspectives along with state-action trajectories. Building on this resource, we propose Cross-Ego Contrastive Learning (CECL), which aligns teammates' egocentric visual streams to foster team-level tactical situational awareness from an individual's perspective. We evaluate CECL on a teammate-opponent location prediction task, demonstrating its effectiveness in enhancing an agent's ability to infer both teammate and opponent positions from a single first-person view using state-of-the-art video encoders. Together, X-Ego-CS and CECL establish a foundation for cross-egocentric multi-agent benchmarking in esports. More broadly, our work positions gameplay understanding as a testbed for multi-agent modeling and tactical learning, with implications for spatiotemporal reasoning and human-AI teaming in both virtual and real-world domains. Code and dataset are available at https://github.com/HATS-ICT/x-ego.