Exploring a Unified Vision-Centric Contrastive Alternatives on Multi-Modal Web Documents

作者: Yiqi Lin, Alex Jinpeng Wang, Linjie Li, Zhengyuan Yang, Mike Zheng Shou

分类: cs.CV

发布日期: 2025-10-21

备注: Project page: this https://linyq17.github.io/VC2L/

🔗 代码/项目: GITHUB

💡 一句话要点

提出视觉中心对比学习VC2L,统一处理多模态网页文档的表示学习。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态学习 对比学习 视觉Transformer 网页文档理解 跨模态检索

📋 核心要点

- 现有CLIP等模型难以处理文本图像松散对齐或嵌入视觉形式的复杂网页文档。

- VC2L将所有模态输入渲染为图像,在像素空间进行统一建模,无需OCR和模态融合。

- VC2L通过片段级对比学习,对齐连续多模态片段,并在多个基准测试上取得优异表现。

📝 摘要(中文)

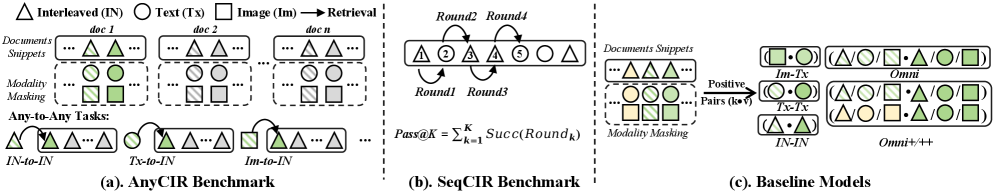

本文提出了一种视觉中心对比学习框架(VC2L),旨在解决复杂真实网页文档的多模态表示问题。现有对比视觉-语言模型如CLIP在处理文本和图像松散对齐或嵌入在视觉形式中的网页文档时存在局限性。VC2L通过将所有输入(文本、图像或组合)渲染为图像,完全在像素空间中操作,从而消除了OCR、文本token化或模态融合的需要。为了捕捉多模态网页文档中复杂的跨模态关系,VC2L采用片段级别的对比学习目标,对齐连续的多模态片段,利用文档的内在连贯性,无需显式配对的图像-文本数据。为了评估该方法的有效性,本文引入了三个检索基准:AnyCIR、SeqCIR和CSR,分别用于评估跨模态检索、细粒度的序列理解和对未见数据的泛化能力。实验结果表明,VC2L在提出的基准和M-BEIR、MTEB等数据集上均取得了有竞争力的或更优越的性能。这些发现强调了多模态网页数据作为对比学习宝贵训练资源的潜力,并展示了统一的、视觉中心方法在多模态表示学习中的可扩展性。

🔬 方法详解

问题定义:现有对比视觉-语言模型,如CLIP,在处理真实世界中复杂的网页文档时存在局限性。这些文档通常包含交错的文本和图像,它们之间的对齐关系可能很弱,或者文本本身就嵌入在图像中。传统方法需要OCR识别文本,并进行文本token化和模态融合,过程复杂且容易出错。

核心思路:VC2L的核心思路是将所有输入,包括文本、图像以及它们的组合,都渲染成图像,从而将多模态表示学习问题转化为一个纯视觉问题。这样,就可以利用视觉Transformer来统一处理不同模态的信息,避免了复杂的模态融合策略。

技术框架:VC2L的整体框架包括以下几个主要步骤:1) 将输入的网页文档分割成多个片段,每个片段可能包含文本、图像或两者的组合。2) 将每个片段渲染成图像。文本片段通过渲染引擎转换成图像,图像片段则直接使用原始像素数据。3) 使用一个视觉Transformer(ViT)作为 backbone 网络,提取每个片段图像的视觉特征。4) 使用片段级别的对比学习目标,对齐连续的多模态片段的视觉特征。

关键创新:VC2L最重要的创新点在于它完全消除了对文本token化和模态融合的需求,而是通过将所有输入都表示为图像,实现了一个统一的视觉中心表示学习框架。这种方法简化了多模态学习的流程,并使其更易于扩展到新的模态和任务。

关键设计:VC2L的关键设计包括:1) 使用视觉Transformer作为特征提取器,充分利用其强大的视觉表示能力。2) 采用片段级别的对比学习目标,鼓励模型学习相邻片段之间的语义关系。具体来说,对于一个片段,模型的目标是将其视觉特征与同一文档中相邻片段的视觉特征对齐,同时与其他文档中的片段的视觉特征区分开来。3) 为了评估模型的性能,作者设计了三个新的检索基准:AnyCIR、SeqCIR和CSR,分别用于评估跨模态检索、细粒度的序列理解和对未见数据的泛化能力。

🖼️ 关键图片

📊 实验亮点

VC2L在三个新提出的检索基准(AnyCIR、SeqCIR和CSR)以及M-BEIR和MTEB等现有数据集上都取得了有竞争力的或更优越的性能。具体来说,VC2L在AnyCIR数据集上取得了显著的提升,表明其在跨模态检索方面具有优势。此外,VC2L在SeqCIR数据集上的表现也表明其能够有效地捕捉文档中的序列信息。

🎯 应用场景

VC2L在信息检索、内容理解和智能文档处理等领域具有广泛的应用前景。例如,它可以用于提升搜索引擎对多模态网页的理解能力,从而提供更准确的搜索结果。此外,它还可以应用于智能文档分析,自动提取文档中的关键信息,并进行分类和摘要。该研究为多模态信息处理提供了一种新的思路,有望推动相关技术的发展。

📄 摘要(原文)

Contrastive vision-language models such as CLIP have demonstrated strong performance across a wide range of multimodal tasks by learning from aligned image-text pairs. However, their ability to handle complex, real-world web documents remains limited, particularly in scenarios where text and images are interleaved, loosely aligned, or embedded in visual form. To address these challenges, we propose Vision-Centric Contrastive Learning (VC2L), a unified framework that models text, images, and their combinations using a single vision transformer. VC2L operates entirely in pixel space by rendering all inputs, whether textual, visual, or combined, as images, thus eliminating the need for OCR, text tokenization, or modality fusion strategy. To capture complex cross-modal relationships in multimodal web documents, VC2L employs a snippet-level contrastive learning objective that aligns consecutive multimodal segments, leveraging the inherent coherence of documents without requiring explicitly paired image-text data. To assess the effectiveness of this approach, we introduce three retrieval benchmarks, AnyCIR, SeqCIR, and CSR, designed to evaluate cross-modal retrieval, fine-grained sequential understanding, and generalization to unseen data, respectively. Empirical results show that VC2L achieves competitive or superior performance compared to CLIP-style models on both the proposed benchmarks and established datasets such as M-BEIR and MTEB. These findings underscore the potential of multimodal web data as a valuable training resource for contrastive learning and illustrate the scalability of a unified, vision-centric approach for multimodal representation learning. Code and models are available at: https://github.com/showlab/VC2L.