Ranking-based Preference Optimization for Diffusion Models from Implicit User Feedback

作者: Yi-Lun Wu, Bo-Kai Ruan, Chiang Tseng, Hong-Han Shuai

分类: cs.CV

发布日期: 2025-10-21

🔗 代码/项目: GITHUB

💡 一句话要点

提出Diffusion-DRO,通过排序优化和在线负样本提升扩散模型的用户偏好对齐。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 扩散模型 偏好学习 排序优化 逆强化学习 文本到图像生成

📋 核心要点

- 现有DPO方法在对齐扩散模型与人类偏好时,存在图像概率估计不准确和离线数据多样性不足的问题。

- Diffusion-DRO将偏好学习转化为排序问题,避免了对奖励模型的依赖,并结合离线专家数据和在线负样本。

- 实验结果表明,Diffusion-DRO在生成质量上优于现有方法,尤其是在处理具有挑战性的prompt时。

📝 摘要(中文)

直接偏好优化(DPO)方法在通过配对比较训练文本到图像扩散模型以对齐人类偏好方面显示出强大的潜力。这些方法通过避免REINFORCE算法来提高训练稳定性,但仍然面临一些挑战,例如由于sigmoid函数的非线性性质和离线数据集的有限多样性而难以准确估计图像概率。在本文中,我们介绍了一种新的偏好学习框架Diffusion Denoising Ranking Optimization (Diffusion-DRO),它基于逆强化学习。Diffusion-DRO通过将偏好学习转化为排序问题来消除对奖励模型的依赖,从而将训练目标简化为去噪公式,并克服了先前方法中发现的非线性估计问题。此外,Diffusion-DRO独特地将离线专家演示与在线策略生成的负样本相结合,使其能够有效地捕捉人类偏好,同时解决离线数据的局限性。全面的实验表明,Diffusion-DRO在一系列具有挑战性和未见过的提示中提供了改进的生成质量,在定量指标和用户研究中均优于最先进的基线。我们的源代码和预训练模型可在https://github.com/basiclab/DiffusionDRO获得。

🔬 方法详解

问题定义:现有直接偏好优化(DPO)方法在对齐文本到图像扩散模型与人类偏好时,面临两个主要问题。一是由于sigmoid函数的非线性特性,难以准确估计图像概率。二是离线数据集的多样性有限,导致模型泛化能力不足。这些问题限制了DPO方法在实际应用中的效果。

核心思路:Diffusion-DRO的核心思路是将偏好学习问题转化为排序问题,从而避免了对奖励模型的依赖。通过直接优化生成图像的排序,模型可以更好地学习人类偏好。此外,Diffusion-DRO结合了离线专家演示和在线策略生成的负样本,以提高数据的多样性和模型的鲁棒性。

技术框架:Diffusion-DRO的整体框架包括以下几个主要阶段:1) 数据收集:收集离线专家演示数据和在线策略生成的负样本数据。2) 排序建模:使用扩散模型生成图像,并根据人类偏好对图像进行排序。3) 损失优化:使用排序损失函数优化扩散模型,使其生成的图像更符合人类偏好。4) 模型评估:使用定量指标和用户研究评估模型的性能。

关键创新:Diffusion-DRO最重要的技术创新点在于将偏好学习转化为排序问题,并结合离线专家数据和在线负样本。这种方法避免了对奖励模型的依赖,提高了训练的稳定性和效率。此外,Diffusion-DRO还提出了一种新的排序损失函数,可以更好地捕捉人类偏好的细微差别。

关键设计:Diffusion-DRO的关键设计包括:1) 使用扩散模型作为图像生成器。2) 设计了一种新的排序损失函数,用于优化模型。3) 结合离线专家数据和在线策略生成的负样本,以提高数据的多样性。4) 使用合适的超参数和训练策略,以确保模型的收敛性和泛化能力。

🖼️ 关键图片

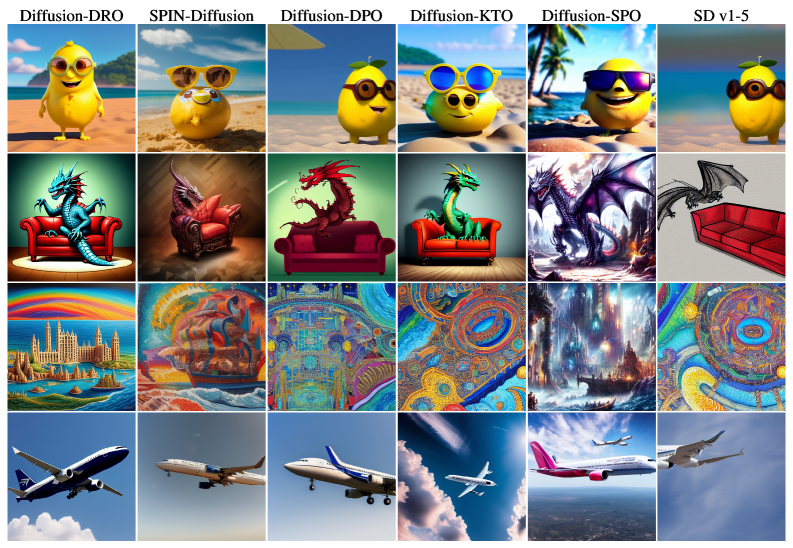

📊 实验亮点

Diffusion-DRO在多个具有挑战性的prompt上进行了实验,结果表明,Diffusion-DRO在生成质量上优于现有方法。具体而言,Diffusion-DRO在定量指标和用户研究中均取得了显著提升,证明了其在对齐扩散模型与人类偏好方面的有效性。代码和预训练模型已开源。

🎯 应用场景

Diffusion-DRO可应用于各种文本到图像生成任务,例如艺术创作、产品设计和虚拟现实。通过对齐模型与人类偏好,可以生成更符合用户需求的图像,提高用户满意度和创造力。该研究的未来影响包括改善人机交互和促进创意产业的发展。

📄 摘要(原文)

Direct preference optimization (DPO) methods have shown strong potential in aligning text-to-image diffusion models with human preferences by training on paired comparisons. These methods improve training stability by avoiding the REINFORCE algorithm but still struggle with challenges such as accurately estimating image probabilities due to the non-linear nature of the sigmoid function and the limited diversity of offline datasets. In this paper, we introduce Diffusion Denoising Ranking Optimization (Diffusion-DRO), a new preference learning framework grounded in inverse reinforcement learning. Diffusion-DRO removes the dependency on a reward model by casting preference learning as a ranking problem, thereby simplifying the training objective into a denoising formulation and overcoming the non-linear estimation issues found in prior methods. Moreover, Diffusion-DRO uniquely integrates offline expert demonstrations with online policy-generated negative samples, enabling it to effectively capture human preferences while addressing the limitations of offline data. Comprehensive experiments show that Diffusion-DRO delivers improved generation quality across a range of challenging and unseen prompts, outperforming state-of-the-art baselines in both both quantitative metrics and user studies. Our source code and pre-trained models are available at https://github.com/basiclab/DiffusionDRO.