From Volume Rendering to 3D Gaussian Splatting: Theory and Applications

作者: Vitor Pereira Matias, Daniel Perazzo, Vinicius Silva, Alberto Raposo, Luiz Velho, Afonso Paiva, Tiago Novello

分类: cs.CV

发布日期: 2025-10-20

备注: Accepted at the Conference on Graphics, Patterns and Images (SIBGRAPI), math focused, 5 equations, 5 Figure, 5 pages of text and 1 of bibligraphy

💡 一句话要点

综述3D高斯溅射:从体渲染到应用,解决实时渲染与高质量重建难题

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D高斯溅射 新视角合成 体渲染 三维重建 实时渲染 神经渲染 计算机视觉

📋 核心要点

- 现有3D重建方法在新视角合成中面临实时渲染与高质量重建的挑战,尤其是在复杂场景下。

- 3D高斯溅射(3DGS)通过显式建模3D高斯分布,实现高效的体素溅射渲染,提升渲染速度。

- 该综述全面介绍了3DGS的原理、优化方法及应用,为相关研究人员提供参考。

📝 摘要(中文)

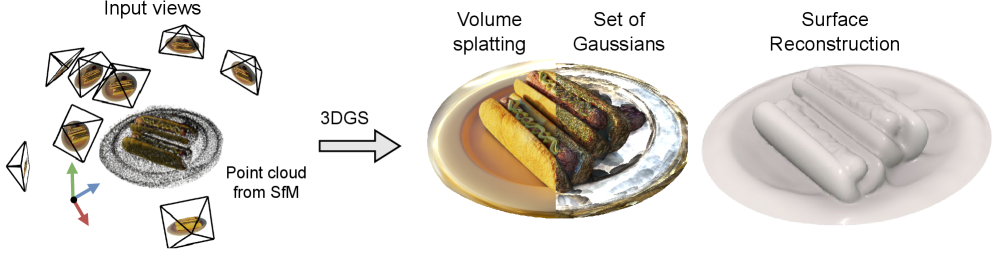

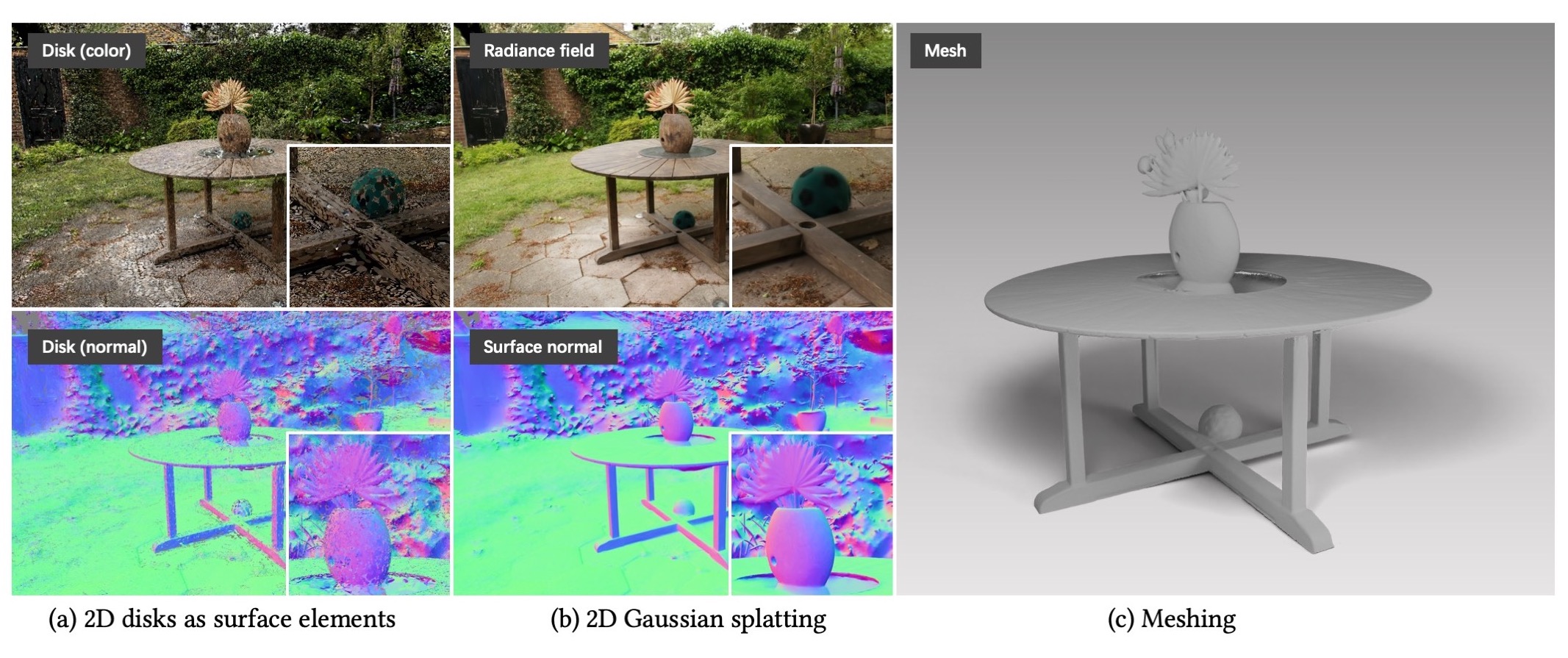

本文对基于图像的三维重建领域中,由3D高斯溅射(3DGS)驱动的根本性变革进行了综述。3DGS通过将场景显式地建模为3D高斯的集合,实现了通过体素溅射进行高效栅格化,从而与常见的图形渲染管线无缝集成。尽管3DGS具有实时新视角合成能力,但它也存在内存占用大、光照效果直接烘焙到表示中的倾向,以及对二次光线效果支持有限等问题。本教程提供了一个简洁而全面的3DGS流程概述,从其溅射公式开始,然后探讨解决其局限性的主要工作。最后,我们调查了一系列利用3DGS进行表面重建、头像建模、动画和内容生成的应用,突出了其高效的渲染和对前馈管线的适用性。

🔬 方法详解

问题定义:论文旨在综述3D高斯溅射(3DGS)技术,该技术旨在解决从多视角图像中进行高效且高质量三维重建的问题。现有方法,如神经辐射场(NeRF),虽然能生成高质量的渲染结果,但渲染速度慢,难以满足实时应用的需求。而传统的基于网格的方法在处理复杂拓扑结构和纹理时存在困难。3DGS试图在渲染质量和速度之间找到平衡,但同时也面临着内存占用大、光照效果烘焙以及对复杂光照效果支持不足等问题。

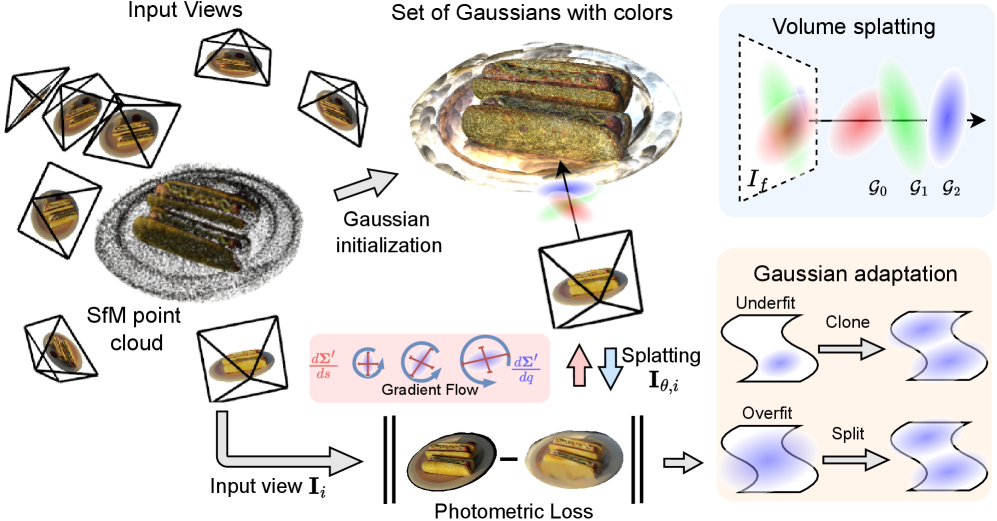

核心思路:3DGS的核心思路是将场景表示为一组3D高斯分布的集合,每个高斯分布具有位置、协方差矩阵(表示形状和方向)、颜色和透明度等参数。通过将这些高斯分布投影到图像平面上,并使用alpha混合进行渲染,可以实现快速且高质量的新视角合成。这种方法避免了NeRF中昂贵的体渲染过程,从而大大提高了渲染速度。

技术框架:3DGS的整体框架包括以下几个主要阶段:1) 初始化:使用SfM等方法初始化场景的稀疏点云。2) 高斯分布参数估计:根据初始点云,为每个点估计一个3D高斯分布的参数。3) 渲染:将3D高斯分布投影到图像平面上,并使用alpha混合进行渲染。4) 优化:使用可微分渲染技术,通过比较渲染图像与真实图像之间的差异,优化高斯分布的参数。这个过程通常使用梯度下降法进行。

关键创新:3DGS最重要的技术创新点在于使用3D高斯分布作为场景的显式表示,并结合高效的体素溅射渲染技术。与NeRF等隐式表示方法相比,3DGS具有更快的渲染速度和更低的内存占用。此外,3DGS还引入了一系列优化策略,例如自适应密度控制和高斯分布的拆分与合并,以提高重建质量和效率。

关键设计:3DGS的关键设计包括:1) 使用各向异性高斯分布来更好地表示场景的几何结构。2) 使用可微分的体素溅射渲染技术,实现高效的渲染和优化。3) 设计了一系列损失函数,包括L1损失、SSIM损失等,以提高重建质量。4) 采用自适应密度控制策略,动态调整高斯分布的数量,以平衡重建质量和内存占用。5) 使用CUDA等并行计算技术,加速渲染和优化过程。

🖼️ 关键图片

📊 实验亮点

该综述总结了3DGS在表面重建、头像建模、动画和内容生成等方面的应用,强调了其高效的渲染能力和对前馈管线的适用性。虽然没有给出具体的性能数据,但强调了3DGS在实时渲染方面的优势,并讨论了其局限性以及解决这些局限性的研究进展。

🎯 应用场景

3DGS技术在虚拟现实、增强现实、游戏开发、机器人导航、自动驾驶等领域具有广泛的应用前景。它可以用于创建逼真的虚拟场景、生成高质量的3D模型、实现实时的新视角合成等。未来,随着技术的不断发展,3DGS有望在更多领域发挥重要作用。

📄 摘要(原文)

The problem of 3D reconstruction from posed images is undergoing a fundamental transformation, driven by continuous advances in 3D Gaussian Splatting (3DGS). By modeling scenes explicitly as collections of 3D Gaussians, 3DGS enables efficient rasterization through volumetric splatting, offering thus a seamless integration with common graphics pipelines. Despite its real-time rendering capabilities for novel view synthesis, 3DGS suffers from a high memory footprint, the tendency to bake lighting effects directly into its representation, and limited support for secondary-ray effects. This tutorial provides a concise yet comprehensive overview of the 3DGS pipeline, starting from its splatting formulation and then exploring the main efforts in addressing its limitations. Finally, we survey a range of applications that leverage 3DGS for surface reconstruction, avatar modeling, animation, and content generation-highlighting its efficient rendering and suitability for feed-forward pipelines.