Glyph: Scaling Context Windows via Visual-Text Compression

作者: Jiale Cheng, Yusen Liu, Xinyu Zhang, Yulin Fei, Wenyi Hong, Ruiliang Lyu, Weihan Wang, Zhe Su, Xiaotao Gu, Xiao Liu, Yushi Bai, Jie Tang, Hongning Wang, Minlie Huang

分类: cs.CV, cs.CL, cs.LG

发布日期: 2025-10-20 (更新: 2025-10-21)

🔗 代码/项目: GITHUB

💡 一句话要点

Glyph:通过视觉-文本压缩扩展LLM上下文窗口,提升长文本处理效率。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 长文本处理 视觉-语言模型 文本压缩 上下文窗口 遗传搜索

📋 核心要点

- 现有LLM扩展上下文窗口面临计算和内存成本的挑战,限制了其在长文本处理中的应用。

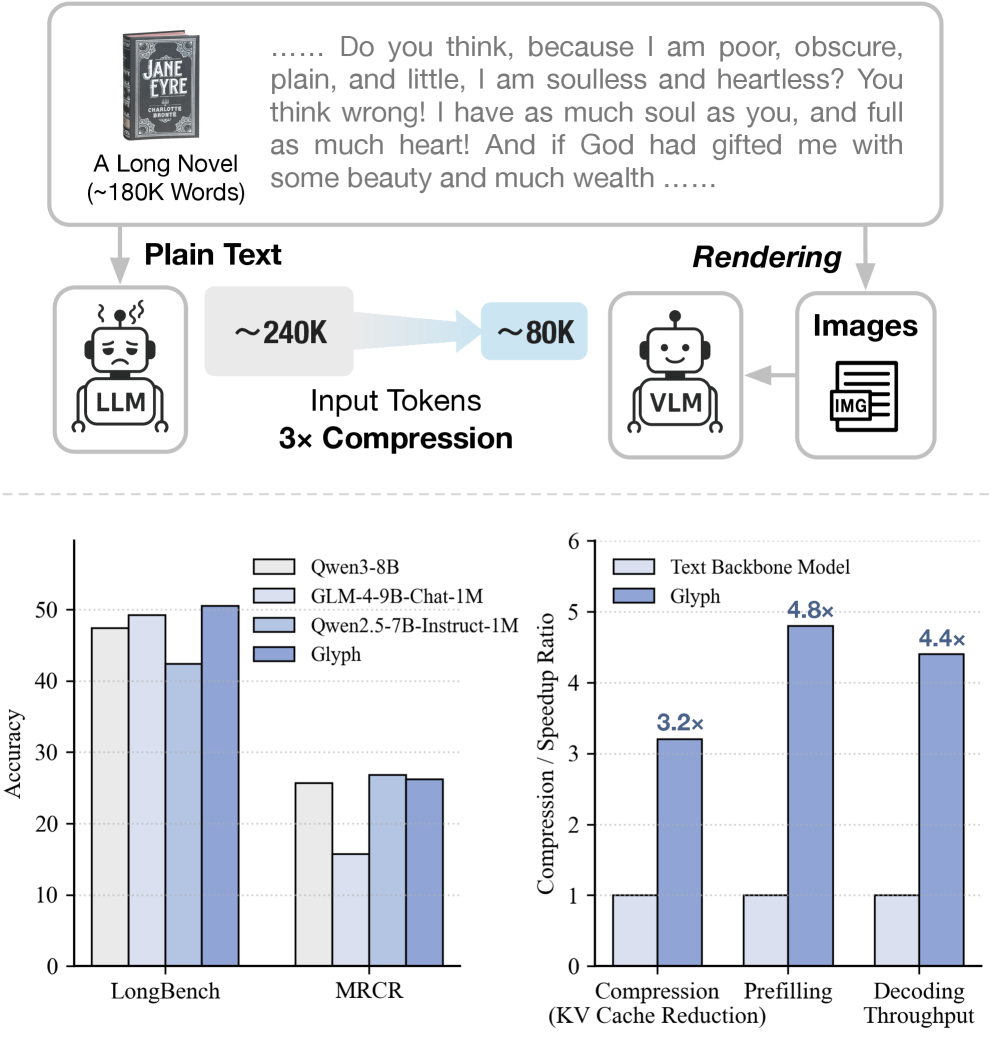

- Glyph通过将长文本渲染为图像,利用视觉-语言模型进行处理,实现文本压缩和语义信息保留。

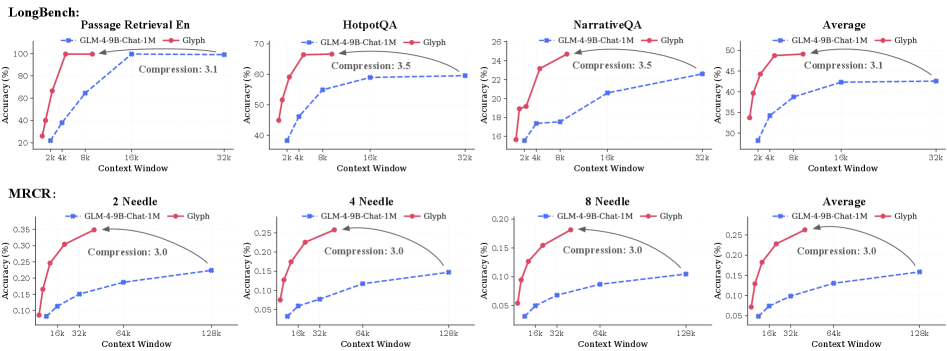

- 实验表明,Glyph在保持准确性的同时,实现了3-4倍的token压缩,并显著提升了预填充、解码和SFT训练速度。

📝 摘要(中文)

大型语言模型(LLMs)越来越依赖长上下文建模来处理文档理解、代码分析和多步骤推理等任务。然而,将上下文窗口扩展到百万token级别会带来巨大的计算和内存成本,限制了长上下文LLMs的实际应用。本文提出了一种不同的视角——视觉上下文扩展——来应对这一挑战。我们提出了Glyph,一个将长文本渲染成图像并使用视觉-语言模型(VLMs)处理它们的框架。这种方法在保留语义信息的同时,大幅压缩了文本输入。我们还设计了一种由LLM驱动的遗传搜索,以识别用于平衡准确性和压缩的最佳视觉渲染配置。通过广泛的实验,我们证明了我们的方法实现了3-4倍的token压缩,同时在各种长上下文基准测试中保持了与Qwen3-8B等领先LLMs相当的准确性。这种压缩还带来了大约4倍的预填充和解码速度提升,以及大约2倍的SFT训练速度提升。此外,在极端压缩下,一个128K上下文的VLM可以扩展到处理百万token级别的文本任务。此外,渲染的文本数据有利于文档理解等现实世界的多模态任务。我们的代码和模型已在https://github.com/thu-coai/Glyph上发布。

🔬 方法详解

问题定义:现有大型语言模型在处理长文本时,需要扩展上下文窗口,但直接增加token数量会导致计算和内存成本呈指数级增长,严重限制了模型的实际应用。现有方法难以在计算效率和信息保留之间取得平衡。

核心思路:Glyph的核心思路是将长文本转换为图像,利用视觉-语言模型处理图像,从而实现对长文本的压缩和高效处理。通过视觉表示,可以将多个token的信息压缩到一个像素中,从而大幅减少需要处理的数据量。

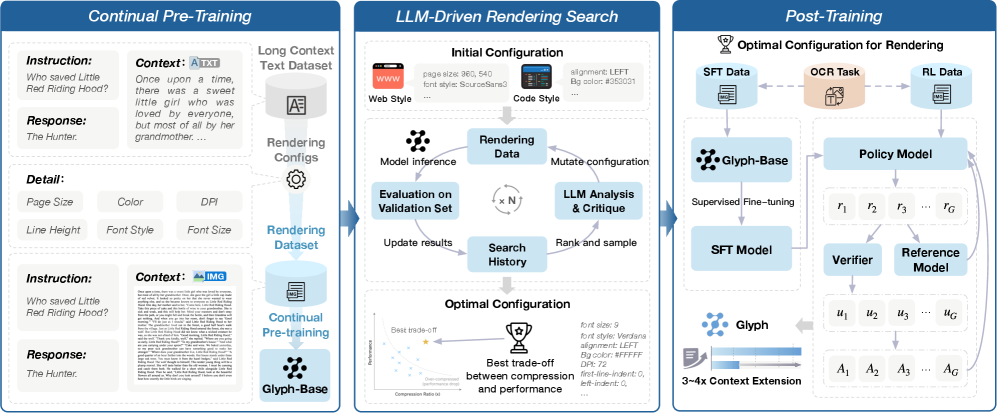

技术框架:Glyph框架主要包含三个阶段:1) 文本渲染:将长文本渲染成图像,涉及字体、颜色、布局等参数的选择;2) 视觉-语言模型处理:使用VLM对渲染后的图像进行编码,提取视觉特征;3) LLM驱动的遗传搜索:利用LLM作为评估器,通过遗传算法搜索最佳的文本渲染配置,以平衡准确性和压缩率。

关键创新:Glyph的关键创新在于将视觉信息引入到长文本处理中,通过视觉压缩的方式降低了计算复杂度。与传统的token-based方法相比,Glyph能够显著减少token数量,同时保留文本的语义信息。此外,利用LLM驱动的遗传搜索优化渲染配置也是一个创新点。

关键设计:文本渲染阶段,需要选择合适的字体、颜色、背景等参数,这些参数会影响图像的可读性和VLM的特征提取效果。遗传搜索算法中,LLM作为评估器,需要设计合适的prompt来评估不同渲染配置的优劣。VLM的选择也会影响最终的性能,需要根据具体的任务选择合适的VLM。

🖼️ 关键图片

📊 实验亮点

Glyph在长上下文基准测试中实现了3-4倍的token压缩,同时保持了与Qwen3-8B等领先LLMs相当的准确性。该方法还带来了大约4倍的预填充和解码速度提升,以及大约2倍的SFT训练速度提升。在极端压缩下,一个128K上下文的VLM可以扩展到处理百万token级别的文本任务。

🎯 应用场景

Glyph在文档理解、代码分析、多步骤推理等长文本处理任务中具有广泛的应用前景。该方法可以降低长文本处理的计算成本,提高处理效率,使得LLM能够更好地应用于实际场景。此外,渲染的文本数据还可以用于多模态任务,例如文档图像分类、信息抽取等。

📄 摘要(原文)

Large language models (LLMs) increasingly rely on long-context modeling for tasks such as document understanding, code analysis, and multi-step reasoning. However, scaling context windows to the million-token level brings prohibitive computational and memory costs, limiting the practicality of long-context LLMs. In this work, we take a different perspective-visual context scaling-to tackle this challenge. Instead of extending token-based sequences, we propose Glyph, a framework that renders long texts into images and processes them with vision-language models (VLMs). This approach substantially compresses textual input while preserving semantic information, and we further design an LLM-driven genetic search to identify optimal visual rendering configurations for balancing accuracy and compression. Through extensive experiments, we demonstrate that our method achieves 3-4x token compression while maintaining accuracy comparable to leading LLMs such as Qwen3-8B on various long-context benchmarks. This compression also leads to around 4x faster prefilling and decoding, and approximately 2x faster SFT training. Furthermore, under extreme compression, a 128K-context VLM could scale to handle 1M-token-level text tasks. In addition, the rendered text data benefits real-world multimodal tasks, such as document understanding. Our code and model are released at https://github.com/thu-coai/Glyph.