Towards 3D Objectness Learning in an Open World

作者: Taichi Liu, Zhenyu Wang, Ruofeng Liu, Guang Wang, Desheng Zhang

分类: cs.CV

发布日期: 2025-10-20

备注: Accepted by NeurIPS 2025

💡 一句话要点

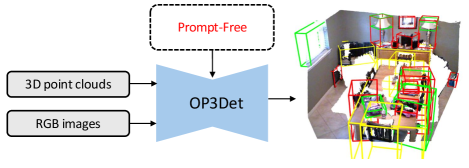

提出OP3Det,解决开放世界3D场景中通用物体检测问题。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 开放世界 3D物体检测 类别无关 跨模态融合 2D基础模型

📋 核心要点

- 现有3D物体检测器在封闭环境下表现良好,但在开放世界场景中泛化能力不足,无法检测训练时未见过的物体。

- OP3Det利用2D基础模型的强大泛化能力,结合3D几何信息,无需文本提示即可实现类别无关的3D物体检测。

- 实验结果表明,OP3Det在开放世界3D物体检测任务上显著优于现有方法,AR指标提升高达16.0%。

📝 摘要(中文)

本文研究开放世界3D物体检测,旨在检测3D场景中的所有物体,包括训练期间未见过的类别。传统的封闭集3D检测器难以泛化到开放世界,而直接采用3D开放词汇模型又面临词汇扩展和语义重叠问题。为实现通用3D物体发现,我们提出OP3Det,一种无需文本提示的、类别无关的开放世界3D检测器,用于检测3D场景中的任何物体。OP3Det利用2D基础模型的泛化和零样本能力,结合2D语义先验和3D几何先验生成类别无关的候选框,从而扩展3D物体发现。通过跨模态专家混合,融合点云和RGB图像的互补信息,动态路由单模态和多模态特征,学习通用3D物体性。大量实验表明,OP3Det性能显著优于现有的开放世界3D检测器,AR指标提升高达16.0%,并且比封闭世界3D检测器提升13.5%。

🔬 方法详解

问题定义:现有3D物体检测器通常在封闭世界假设下工作,即训练和测试类别相同。然而,现实世界是开放的,存在大量未知的物体类别。直接将封闭世界的检测器应用于开放世界会导致性能急剧下降。此外,利用开放词汇模型的方案存在词汇扩展和语义重叠的问题,难以有效检测所有物体。

核心思路:OP3Det的核心思路是利用2D基础模型强大的泛化能力和零样本学习能力,结合3D几何信息,实现类别无关的3D物体检测。通过将2D语义先验和3D几何先验相结合,生成高质量的3D候选框,从而扩大了3D物体发现的范围。同时,采用跨模态专家混合的方式,融合点云和RGB图像的互补信息,提升检测的准确性。

技术框架:OP3Det的整体框架包括以下几个主要模块:1) 3D候选框生成:利用2D基础模型提取图像特征,结合3D几何信息生成类别无关的3D候选框。2) 特征提取:分别从点云和RGB图像中提取特征。3) 跨模态专家混合:根据输入数据的特点,动态选择单模态或多模态特征进行融合。4) 物体性评分:对候选框进行评分,判断其是否包含物体。

关键创新:OP3Det的关键创新在于:1) 提出了一个无需文本提示的开放世界3D物体检测框架。2) 利用2D基础模型的泛化能力,实现了类别无关的3D候选框生成。3) 采用跨模态专家混合的方式,有效融合了点云和RGB图像的互补信息。

关键设计:在3D候选框生成阶段,利用2D基础模型提取图像的语义信息,并将其投影到3D空间中,生成3D候选框。在跨模态专家混合阶段,设计了一个动态路由机制,根据输入数据的特点,选择合适的专家进行特征融合。损失函数包括物体性损失和定位损失,用于优化模型的性能。

🖼️ 关键图片

📊 实验亮点

OP3Det在ScanNet和SUN RGB-D数据集上进行了广泛的实验,结果表明其性能显著优于现有的开放世界3D检测器。在AR指标上,OP3Det比现有方法提升高达16.0%,并且比封闭世界3D检测器提升13.5%。这些结果验证了OP3Det在开放世界3D物体检测任务上的有效性。

🎯 应用场景

OP3Det在机器人导航、自动驾驶、场景理解等领域具有广泛的应用前景。它可以帮助机器人在复杂的开放环境中识别各种物体,从而实现更智能的交互和决策。此外,该技术还可以应用于三维场景重建、虚拟现实等领域,提升用户体验。

📄 摘要(原文)

Recent advancements in 3D object detection and novel category detection have made significant progress, yet research on learning generalized 3D objectness remains insufficient. In this paper, we delve into learning open-world 3D objectness, which focuses on detecting all objects in a 3D scene, including novel objects unseen during training. Traditional closed-set 3D detectors struggle to generalize to open-world scenarios, while directly incorporating 3D open-vocabulary models for open-world ability struggles with vocabulary expansion and semantic overlap. To achieve generalized 3D object discovery, We propose OP3Det, a class-agnostic Open-World Prompt-free 3D Detector to detect any objects within 3D scenes without relying on hand-crafted text prompts. We introduce the strong generalization and zero-shot capabilities of 2D foundation models, utilizing both 2D semantic priors and 3D geometric priors for class-agnostic proposals to broaden 3D object discovery. Then, by integrating complementary information from point cloud and RGB image in the cross-modal mixture of experts, OP3Det dynamically routes uni-modal and multi-modal features to learn generalized 3D objectness. Extensive experiments demonstrate the extraordinary performance of OP3Det, which significantly surpasses existing open-world 3D detectors by up to 16.0% in AR and achieves a 13.5% improvement compared to closed-world 3D detectors.