Res-Bench: Benchmarking the Robustness of Multimodal Large Language Models to Dynamic Resolution Input

作者: Chenxu Li, Zhicai Wang, Yuan Sheng, Xingyu Zhu, Yanbin Hao, Xiang Wang

分类: cs.CV, cs.CL

发布日期: 2025-10-19 (更新: 2025-11-14)

备注: 23 pages

💡 一句话要点

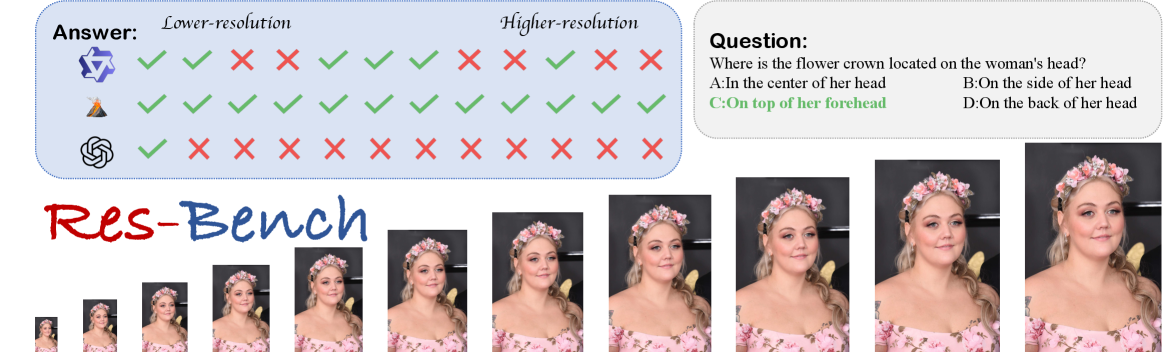

Res-Bench:评估多模态大语言模型对动态分辨率输入的鲁棒性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态大语言模型 分辨率鲁棒性 基准测试 性能评估 动态分辨率 鲁棒性指标 模型微调

📋 核心要点

- 现有MLLM评估侧重语义性能,忽略了模型在不同分辨率输入下的鲁棒性问题。

- Res-Bench通过构建多分辨率数据集和提出鲁棒性指标,全面评估MLLM的分辨率鲁棒性。

- 实验分析了不同模型、任务和预处理方法对鲁棒性的影响,并探索了微调提升稳定性的方法。

📝 摘要(中文)

多模态大语言模型(MLLMs)越来越多地支持动态图像分辨率。然而,目前的评估范式主要评估语义性能,忽略了分辨率鲁棒性的关键问题——即性能在不同输入分辨率下是否保持稳定。为了解决这个差距,我们引入了 extbf{Res-Bench},这是一个全面的基准,包含14,400个样本,跨越12个分辨率级别和六个核心能力维度。我们设计了一个新颖的评估框架,超越了传统的准确性指标,以捕捉性能稳定性。该框架引入了多个鲁棒性指标:用于评估分辨率-性能趋势的Spearman相关性,以及用于测量性能波动性的绝对/相对连续误差(ACE/RCE)。使用这些指标,我们对领先的MLLM进行了大规模评估。我们的分析包括:(1)以模型为中心和以任务为中心的鲁棒性检查,(2)对包括填充和超分辨率在内的预处理策略的调查,以及(3)对用于增强稳定性的微调的探索。

🔬 方法详解

问题定义:现有MLLM评估主要关注语义理解能力,忽略了输入图像分辨率变化对模型性能的影响。实际应用中,图像分辨率可能动态变化,模型需要具备对不同分辨率输入的鲁棒性。现有方法缺乏对这一关键能力的系统性评估。

核心思路:Res-Bench的核心思路是构建一个包含多个分辨率级别图像的数据集,并设计相应的评估指标,以量化MLLM在不同分辨率下的性能稳定程度。通过分析模型在不同分辨率下的表现,可以深入了解其鲁棒性,并为后续的改进提供指导。

技术框架:Res-Bench包含以下几个主要组成部分:1) 多分辨率数据集:包含14,400个样本,覆盖12个分辨率级别和6个核心能力维度。2) 鲁棒性评估指标:包括Spearman相关性(评估分辨率-性能趋势)和绝对/相对连续误差(ACE/RCE)(评估性能波动性)。3) 大规模模型评估:对多个领先的MLLM进行评估,分析其鲁棒性表现。4) 预处理策略研究:研究填充和超分辨率等预处理方法对鲁棒性的影响。5) 微调策略探索:探索通过微调提升模型鲁棒性的方法。

关键创新:Res-Bench的关键创新在于:1) 提出了分辨率鲁棒性这一新的评估维度,弥补了现有评估体系的不足。2) 构建了多分辨率数据集,为鲁棒性评估提供了数据基础。3) 设计了Spearman相关性和ACE/RCE等鲁棒性指标,实现了对性能稳定性的量化评估。

关键设计:在数据集构建方面,Res-Bench覆盖了多种图像分辨率,并确保不同分辨率下的图像内容一致。在鲁棒性指标设计方面,Spearman相关性用于评估分辨率与性能之间的单调关系,ACE/RCE用于评估性能的波动程度。在实验方面,Res-Bench对多个MLLM进行了大规模评估,并分析了不同预处理和微调策略的影响。

🖼️ 关键图片

📊 实验亮点

Res-Bench对多个领先的MLLM进行了大规模评估,揭示了它们在分辨率鲁棒性方面的差异。实验结果表明,不同模型在不同任务上的鲁棒性表现各异。此外,研究还发现,某些预处理方法(如超分辨率)可以提升模型的鲁棒性,而微调也可以有效增强模型的稳定性。

🎯 应用场景

Res-Bench的研究成果可应用于评估和提升多模态大语言模型在实际应用场景中的可靠性,例如智能助手、自动驾驶、医疗诊断等。通过提高模型对不同分辨率输入的鲁棒性,可以增强其在复杂环境下的适应能力,减少因图像质量问题导致的错误。

📄 摘要(原文)

Multimodal Large Language Models (MLLMs) increasingly support dynamic image resolutions. However, current evaluation paradigms primarily assess semantic performance, overlooking the critical question of resolution robustness - whether performance remains stable across varying input resolutions. To address this gap, we introduce \textbf{Res-Bench}, a comprehensive benchmark comprising 14,400 samples across 12 resolution levels and six core capability dimensions. We designed a novel evaluation framework that goes beyond traditional accuracy metrics to capture performance stability. This framework introduces multiple robustness metrics: Spearman's correlation for assessing resolution-performance trends, and Absolute/Relative Continuous Error (ACE/RCE) for measuring performance volatility. Using these metrics, we conducted a large-scale evaluation of leading MLLMs. Our analysis encompasses: (1) model-centric and task-centric robustness examination, (2) investigation of preprocessing strategies including padding and super-resolution, and (3) exploration of fine-tuning for stability enhancement.