Uncovering Brain-Like Hierarchical Patterns in Vision-Language Models through fMRI-Based Neural Encoding

作者: Yudan Ren, Xinlong Wang, Kexin Wang, Tian Xia, Zihan Ma, Zhaowei Li, Xiangrong Bi, Xiao Li, Xiaowei He

分类: cs.CV

发布日期: 2025-10-19

备注: 14 pages, 7 figures

💡 一句话要点

通过fMRI神经编码揭示视觉-语言模型中类脑分层模式

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉-语言模型 fMRI 神经编码 人工神经网络 类脑智能

📋 核心要点

- 现有研究未能充分捕捉大脑的多模态处理能力,且忽略了人工神经网络中单个神经元的作用。

- 该研究提出了一种神经元级别的分析框架,结合人工神经元分析与fMRI体素编码,研究视觉-语言模型中的信息处理机制。

- 研究发现人工神经元能够预测生物神经元的活动,且视觉-语言模型的架构会影响神经元的激活模式。

📝 摘要(中文)

本研究旨在探索人工神经网络(ANN)与人脑处理之间的联系,针对现有研究的局限性,即单模态ANN研究无法捕捉大脑固有的多模态处理能力,以及多模态ANN研究主要关注高层模型输出而忽略了神经元的作用,提出了一个新颖的神经元级别分析框架。该框架结合了精细的人工神经元(AN)分析与基于fMRI的体素编码,以研究两种架构不同的视觉-语言模型(VLM):CLIP和METER。研究揭示了四个关键发现:(1)AN成功预测了多个功能网络(包括语言、视觉、注意力和默认模式)中的生物神经元(BN)活动,表明共享的表征机制;(2)AN和BN都表现出功能冗余,通过重叠的神经表征反映大脑的容错和协作信息处理机制;(3)AN表现出与BN平行的极性模式,相反激活的BN在VLM层中显示出镜像激活趋势,反映了神经信息处理的复杂性和双向性;(4)CLIP和METER的架构驱动不同的BN:CLIP的独立分支显示出模态特定的专业化,而METER的跨模态设计产生统一的跨模态激活,突出了架构对ANN类脑属性的影响。这些结果为VLM中神经元级别的类脑分层处理提供了有力的证据。

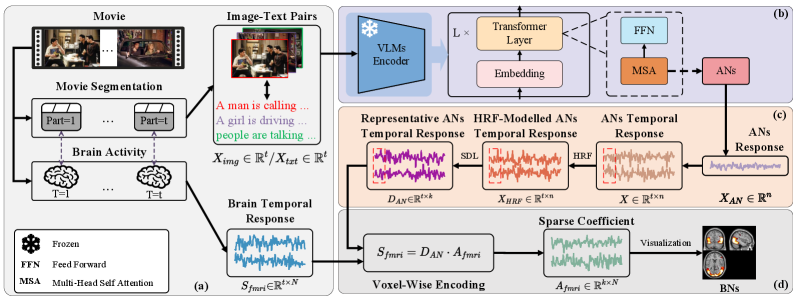

🔬 方法详解

问题定义:现有研究对人工神经网络(ANN)和人脑之间联系的理解不足。单模态ANN研究无法捕捉大脑的多模态处理能力,而多模态ANN研究主要关注高层模型输出,忽略了神经元级别的作用。因此,需要一种方法来更深入地理解视觉-语言模型(VLM)中神经元级别的信息处理机制,并将其与人脑活动联系起来。

核心思路:该研究的核心思路是将人工神经网络中的人工神经元(AN)与人脑中的生物神经元(BN)进行比较,通过分析AN的活动模式来预测BN的活动模式。利用fMRI技术获取人脑活动数据,并使用体素编码方法将AN的活动与fMRI数据进行关联。通过这种方式,可以揭示VLM中神经元级别的信息处理机制,并探索其与人脑活动的相似性。

技术框架:该研究的技术框架主要包括以下几个步骤:1) 选择两种架构不同的VLM:CLIP和METER;2) 使用fMRI技术获取人脑在执行视觉-语言任务时的活动数据;3) 提取VLM中人工神经元的活动数据;4) 使用体素编码方法,将人工神经元的活动与fMRI数据进行关联,建立AN和BN之间的映射关系;5) 分析AN和BN的活动模式,比较它们的相似性和差异性。

关键创新:该研究的关键创新在于提出了一个神经元级别的分析框架,该框架能够将人工神经网络中的人工神经元与人脑中的生物神经元进行比较,从而更深入地理解VLM中神经元级别的信息处理机制。此外,该研究还发现,VLM的架构会影响神经元的激活模式,CLIP的独立分支显示出模态特定的专业化,而METER的跨模态设计产生统一的跨模态激活。

关键设计:该研究的关键设计包括:1) 选择CLIP和METER两种架构不同的VLM,以便比较不同架构对神经元激活模式的影响;2) 使用fMRI技术获取人脑活动数据,并使用体素编码方法将AN的活动与fMRI数据进行关联;3) 分析AN和BN的活动模式,包括功能冗余和极性模式等。

🖼️ 关键图片

📊 实验亮点

研究发现,人工神经元能够成功预测生物神经元在多个功能网络(包括语言、视觉、注意力和默认模式)中的活动,表明共享的表征机制。此外,研究还发现,VLM的架构会影响神经元的激活模式,CLIP的独立分支显示出模态特定的专业化,而METER的跨模态设计产生统一的跨模态激活。

🎯 应用场景

该研究的成果可以应用于开发更类脑的人工智能系统,例如,可以设计具有更强多模态处理能力和容错能力的VLM。此外,该研究还可以帮助我们更深入地理解人脑的信息处理机制,为神经科学研究提供新的思路。

📄 摘要(原文)

While brain-inspired artificial intelligence(AI) has demonstrated promising results, current understanding of the parallels between artificial neural networks (ANNs) and human brain processing remains limited: (1) unimodal ANN studies fail to capture the brain's inherent multimodal processing capabilities, and (2) multimodal ANN research primarily focuses on high-level model outputs, neglecting the crucial role of individual neurons. To address these limitations, we propose a novel neuron-level analysis framework that investigates the multimodal information processing mechanisms in vision-language models (VLMs) through the lens of human brain activity. Our approach uniquely combines fine-grained artificial neuron (AN) analysis with fMRI-based voxel encoding to examine two architecturally distinct VLMs: CLIP and METER. Our analysis reveals four key findings: (1) ANs successfully predict biological neurons (BNs) activities across multiple functional networks (including language, vision, attention, and default mode), demonstrating shared representational mechanisms; (2) Both ANs and BNs demonstrate functional redundancy through overlapping neural representations, mirroring the brain's fault-tolerant and collaborative information processing mechanisms; (3) ANs exhibit polarity patterns that parallel the BNs, with oppositely activated BNs showing mirrored activation trends across VLM layers, reflecting the complexity and bidirectional nature of neural information processing; (4) The architectures of CLIP and METER drive distinct BNs: CLIP's independent branches show modality-specific specialization, whereas METER's cross-modal design yields unified cross-modal activation, highlighting the architecture's influence on ANN brain-like properties. These results provide compelling evidence for brain-like hierarchical processing in VLMs at the neuronal level.