A Comprehensive Survey on World Models for Embodied AI

作者: Xinqing Li, Xin He, Le Zhang, Min Wu, Xiaoli Li, Yun Liu

分类: cs.CV

发布日期: 2025-10-19 (更新: 2025-11-29)

备注: https://github.com/Li-Zn-H/AwesomeWorldModels

🔗 代码/项目: GITHUB

💡 一句话要点

对具身智能中世界模型的全面综述,涵盖功能、时序建模和空间表示三个维度。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 世界模型 具身智能 环境建模 强化学习 自主导航

📋 核心要点

- 现有具身智能方法在模拟环境动态、支持长期预测和决策方面存在不足,尤其是在物理一致性和计算效率之间难以平衡。

- 本文提出一个统一的世界模型框架,从功能、时序建模和空间表示三个维度对现有方法进行分类和分析,从而系统性地理解和比较不同的世界模型。

- 论文整理了机器人、自动驾驶和通用视频等领域的数据集和评估指标,并对现有模型进行了定量比较,总结了未来研究的关键挑战。

📝 摘要(中文)

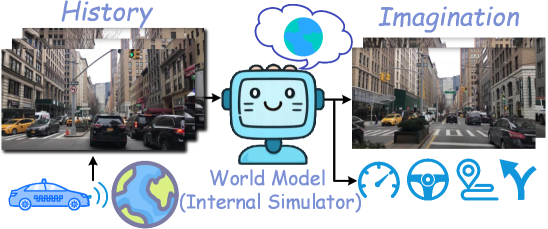

具身智能需要智能体感知、行动并预测行动如何重塑未来的世界状态。世界模型作为内部模拟器,捕获环境动态,支持前向和反事实推演,从而支持感知、预测和决策。本综述提出了具身智能中世界模型的统一框架。具体而言,我们形式化了问题设置和学习目标,并提出了一个三轴分类法,包括:(1)功能性:决策耦合 vs. 通用;(2)时间建模:序列模拟和推理 vs. 全局差异预测;(3)空间表示:全局潜在向量、Token特征序列、空间潜在网格和分解渲染表示。我们系统化了机器人、自动驾驶和通用视频设置中的数据资源和指标,涵盖像素预测质量、状态级理解和任务性能。此外,我们对最先进的模型进行了定量比较,并提炼了关键的开放挑战,包括统一数据集的稀缺,以及评估物理一致性而非像素保真度的评估指标的需求,模型性能与实时控制所需的计算效率之间的权衡,以及实现长时程时间一致性同时减轻误差累积的核心建模难度。最后,我们维护了一个精选的参考书目,网址为https://github.com/Li-Zn-H/AwesomeWorldModels。

🔬 方法详解

问题定义:具身智能需要智能体能够理解环境动态,并预测自身行为对环境的影响。现有的世界模型在捕捉环境动态、实现长期预测和进行有效决策方面存在挑战。主要的痛点包括:缺乏统一的框架来理解和比较不同的世界模型,缺乏能够评估物理一致性的指标,以及在模型性能和计算效率之间难以取得平衡。

核心思路:本文的核心思路是构建一个统一的框架,从三个维度对现有的世界模型进行分类和分析:功能性(决策耦合 vs. 通用)、时间建模(序列模拟和推理 vs. 全局差异预测)和空间表示(全局潜在向量、Token特征序列、空间潜在网格和分解渲染表示)。通过这个框架,可以更清晰地理解不同模型的优缺点,并为未来的研究提供指导。

技术框架:该综述没有提出新的模型,而是对现有模型进行分类和分析。整体框架包括:1) 形式化问题设置和学习目标;2) 提出三轴分类法;3) 系统化数据资源和评估指标;4) 对比现有模型;5) 总结开放挑战。主要模块包括:功能性分析模块、时间建模分析模块和空间表示分析模块。

关键创新:本文的创新点在于提出了一个三轴分类法,能够系统地理解和比较不同的世界模型。这个分类法涵盖了世界模型设计的关键方面,包括功能、时间建模和空间表示。此外,本文还整理了不同领域的数据集和评估指标,并对现有模型进行了定量比较。

关键设计:本文没有涉及具体的模型设计细节。但是,文章强调了评估指标的重要性,特别是需要设计能够评估物理一致性的指标,而不仅仅是像素保真度。此外,文章还强调了模型性能和计算效率之间的权衡,需要在设计模型时考虑到实时控制的需求。

🖼️ 关键图片

📊 实验亮点

该综述系统地整理了现有世界模型的研究进展,并从功能、时序建模和空间表示三个维度进行了分类和分析。通过定量比较现有模型,论文指出了当前研究的局限性,并提出了未来研究的关键挑战,例如缺乏统一数据集和评估物理一致性的指标。

🎯 应用场景

该研究成果对机器人、自动驾驶、游戏AI等领域具有重要应用价值。通过对世界模型的深入理解和系统分析,可以帮助研究人员设计更有效的智能体,从而提升智能体在复杂环境中的感知、预测和决策能力。未来的研究可以集中在解决现有模型的局限性,例如提高物理一致性、降低计算复杂度等。

📄 摘要(原文)

Embodied AI requires agents that perceive, act, and anticipate how actions reshape future world states. World models serve as internal simulators that capture environment dynamics, enabling forward and counterfactual rollouts to support perception, prediction, and decision making. This survey presents a unified framework for world models in embodied AI. Specifically, we formalize the problem setting and learning objectives, and propose a three-axis taxonomy encompassing: (1) Functionality, Decision-Coupled vs. General-Purpose; (2) Temporal Modeling, Sequential Simulation and Inference vs. Global Difference Prediction; (3) Spatial Representation, Global Latent Vector, Token Feature Sequence, Spatial Latent Grid, and Decomposed Rendering Representation. We systematize data resources and metrics across robotics, autonomous driving, and general video settings, covering pixel prediction quality, state-level understanding, and task performance. Furthermore, we offer a quantitative comparison of state-of-the-art models and distill key open challenges, including the scarcity of unified datasets and the need for evaluation metrics that assess physical consistency over pixel fidelity, the trade-off between model performance and the computational efficiency required for real-time control, and the core modeling difficulty of achieving long-horizon temporal consistency while mitigating error accumulation. Finally, we maintain a curated bibliography at https://github.com/Li-Zn-H/AwesomeWorldModels.