Self-Supervised Learning to Fly using Efficient Semantic Segmentation and Metric Depth Estimation for Low-Cost Autonomous UAVs

作者: Sebastian Mocanu, Emil Slusanschi, Marius Leordeanu

分类: cs.CV, cs.RO

发布日期: 2025-10-18

💡 一句话要点

提出一种基于语义分割和单目深度估计的低成本无人机自主飞行方法

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 无人机自主导航 语义分割 单目深度估计 知识蒸馏 自适应尺度因子 视觉SLAM 低成本无人机

📋 核心要点

- 现有无人机自主导航依赖GPS或激光雷达等昂贵传感器,限制了其在资源受限环境中的应用。

- 该论文提出一种基于语义分割和单目深度估计的低成本方案,利用知识蒸馏和自适应尺度因子算法实现精确的度量深度估计。

- 实验结果表明,该方法在真实和数字孪生环境中均能有效提升无人机自主导航性能,任务成功率达到87.5%。

📝 摘要(中文)

本文提出了一种仅使用视觉的小型无人机自主飞行系统,该系统适用于受控室内环境。该系统结合了语义分割和单目深度估计,无需GPS或激光雷达等昂贵传感器,即可实现避障、场景探索和自主安全着陆。一个关键创新是自适应尺度因子算法,该算法利用语义地面平面检测和相机内部参数,将非度量的单目深度预测转换为精确的度量距离测量,实现了14.4厘米的平均距离误差。该方法使用知识蒸馏框架,其中基于颜色的支持向量机(SVM)教师为轻量级U-Net学生网络(160万个参数)生成训练数据,该网络能够进行实时语义分割。对于更复杂的环境,SVM教师可以替换为最先进的分割模型。在5x4米的受控实验室环境中进行了测试,其中包含八个模拟城市结构的纸板障碍物。在真实环境中的30次飞行测试和数字孪生环境中的100次飞行测试中进行的广泛验证表明,结合分割和深度方法可增加监视期间的行驶距离并减少任务时间,同时保持100%的成功率。该系统通过端到端学习得到进一步优化,其中紧凑的学生神经网络从我们性能最佳的方法生成的演示数据中学习完整的飞行策略,从而实现了87.5%的自主任务成功率。这项工作推进了结构化环境中基于视觉的实用无人机导航,展示了度量深度估计和计算效率挑战的解决方案,从而可以在资源受限的平台上进行部署。

🔬 方法详解

问题定义:现有无人机自主导航系统通常依赖于GPS或激光雷达等高精度传感器,这增加了成本和功耗,限制了其在室内或资源受限环境中的应用。因此,如何在低成本、低功耗的条件下,实现无人机的自主导航和避障是一个重要的研究问题。

核心思路:该论文的核心思路是利用视觉信息,特别是语义分割和单目深度估计,来替代昂贵的传感器。通过语义分割识别场景中的障碍物和地面,并利用单目深度估计获取场景的深度信息,从而实现无人机的自主导航和避障。为了解决单目深度估计的尺度不确定性问题,提出了自适应尺度因子算法。

技术框架:该系统的整体框架包括以下几个主要模块:1) 图像采集:使用无人机上的摄像头获取图像;2) 语义分割:使用轻量级的U-Net网络进行实时语义分割,识别场景中的障碍物和地面;3) 单目深度估计:使用现有的单目深度估计方法预测场景的深度图;4) 自适应尺度因子算法:利用语义分割结果和相机参数,将非度量的深度图转换为度量的距离信息;5) 路径规划和控制:根据语义分割和深度信息,进行路径规划和控制,实现无人机的自主导航和避障。

关键创新:该论文最重要的技术创新点在于提出了自适应尺度因子算法,该算法能够有效地解决单目深度估计的尺度不确定性问题,将非度量的深度图转换为精确的度量距离信息。与现有方法相比,该算法不需要额外的传感器或复杂的标定过程,只需要语义分割结果和相机参数即可实现。

关键设计:在语义分割方面,采用了知识蒸馏的方法,使用一个基于颜色的SVM教师网络生成训练数据,训练一个轻量级的U-Net学生网络,以实现实时语义分割。在自适应尺度因子算法中,利用语义分割结果检测地面平面,并根据相机参数计算地面平面的尺度因子,从而将非度量的深度图转换为度量的距离信息。损失函数的设计也至关重要,需要平衡语义分割和深度估计的精度。

🖼️ 关键图片

📊 实验亮点

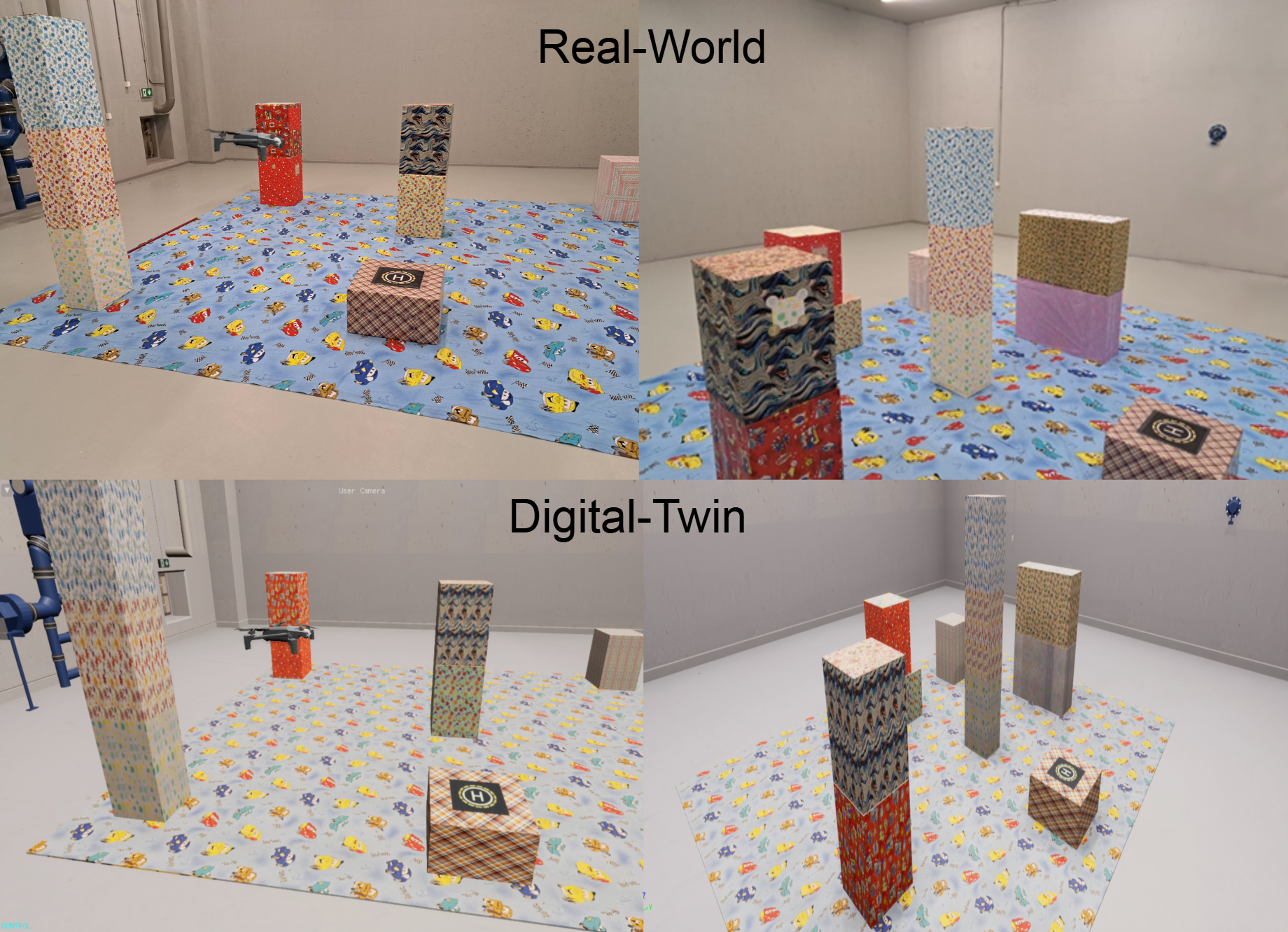

该系统在5x4米的实验室环境中进行了测试,使用8个纸板障碍物模拟城市结构。在真实环境中的30次飞行测试和数字孪生环境中的100次飞行测试中,该方法实现了100%的任务成功率,并显著增加了监视期间的行驶距离,减少了任务时间。自适应尺度因子算法实现了14.4厘米的平均距离误差。通过端到端学习,无人机自主任务成功率达到87.5%。

🎯 应用场景

该研究成果可应用于室内无人机巡检、物流配送、安防监控等领域。在无需GPS或激光雷达等昂贵传感器的前提下,实现无人机在复杂环境中的自主导航和避障,降低了无人机的使用成本和门槛,具有广阔的应用前景。未来可进一步拓展到更复杂的室外环境和任务。

📄 摘要(原文)

This paper presents a vision-only autonomous flight system for small UAVs operating in controlled indoor environments. The system combines semantic segmentation with monocular depth estimation to enable obstacle avoidance, scene exploration, and autonomous safe landing operations without requiring GPS or expensive sensors such as LiDAR. A key innovation is an adaptive scale factor algorithm that converts non-metric monocular depth predictions into accurate metric distance measurements by leveraging semantic ground plane detection and camera intrinsic parameters, achieving a mean distance error of 14.4 cm. The approach uses a knowledge distillation framework where a color-based Support Vector Machine (SVM) teacher generates training data for a lightweight U-Net student network (1.6M parameters) capable of real-time semantic segmentation. For more complex environments, the SVM teacher can be replaced with a state-of-the-art segmentation model. Testing was conducted in a controlled 5x4 meter laboratory environment with eight cardboard obstacles simulating urban structures. Extensive validation across 30 flight tests in a real-world environment and 100 flight tests in a digital-twin environment demonstrates that the combined segmentation and depth approach increases the distance traveled during surveillance and reduces mission time while maintaining 100% success rates. The system is further optimized through end-to-end learning, where a compact student neural network learns complete flight policies from demonstration data generated by our best-performing method, achieving an 87.5% autonomous mission success rate. This work advances practical vision-based drone navigation in structured environments, demonstrating solutions for metric depth estimation and computational efficiency challenges that enable deployment on resource-constrained platforms.