UrbanVerse: Scaling Urban Simulation by Watching City-Tour Videos

作者: Mingxuan Liu, Honglin He, Elisa Ricci, Wayne Wu, Bolei Zhou

分类: cs.CV, cs.AI, cs.RO

发布日期: 2025-10-16

备注: Technical report. Project page: https://urbanverseproject.github.io/

💡 一句话要点

UrbanVerse:通过城市漫游视频扩展城市模拟规模,用于具身智能体训练。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 城市模拟 具身智能 数据驱动 真实到模拟 机器人导航

📋 核心要点

- 现有城市模拟环境构建方法,如人工设计或程序生成,难以兼顾可扩展性和真实世界复杂性,限制了具身智能体训练。

- UrbanVerse提出了一种数据驱动的真实到模拟系统,利用城市漫游视频自动构建具有物理感知和交互性的城市模拟环境。

- 实验表明,UrbanVerse生成的场景在真实感和泛化能力上优于现有方法,显著提升了具身智能体在真实世界的导航性能。

📝 摘要(中文)

城市具身AI智能体,如送货机器人和四足机器人,越来越多地出现在我们的城市中,在复杂的街道上导航以提供最后一公里的连接。训练这些智能体需要多样化、高保真的城市环境,但现有的人工制作或程序生成的模拟场景要么缺乏可扩展性,要么无法捕捉真实世界的复杂性。我们介绍了UrbanVerse,一个数据驱动的真实到模拟系统,它将众包的城市漫游视频转换为具有物理感知、可交互的模拟场景。UrbanVerse包括:(i)UrbanVerse-100K,一个包含10万+带语义和物理属性的城市3D资产的存储库,以及(ii)UrbanVerse-Gen,一个自动管道,可以从视频中提取场景布局,并使用检索到的资产实例化度量尺度的3D模拟。UrbanVerse在IsaacSim中运行,提供来自24个国家的160个高质量构建场景,以及一个由艺术家设计的10个测试场景的基准。实验表明,UrbanVerse场景保留了真实世界的语义和布局,实现了与手动制作场景相当的人工评估真实感。在城市导航中,在UrbanVerse中训练的策略表现出缩放幂律和强大的泛化能力,与先前的方法相比,在模拟中提高了+6.3%的成功率,在零样本sim-to-real迁移中提高了+30.1%的成功率,仅通过两次干预就完成了300米的真实世界任务。

🔬 方法详解

问题定义:论文旨在解决城市具身智能体训练中,现有模拟环境构建方法无法同时满足可扩展性和真实世界复杂性的问题。人工构建成本高昂,程序生成难以捕捉真实世界的细节,导致训练出的智能体在真实环境中表现不佳。

核心思路:论文的核心思路是利用众包的城市漫游视频,从中提取场景布局和3D资产,自动构建大规模、高保真的城市模拟环境。通过数据驱动的方式,避免了人工设计的局限性,并能更好地反映真实世界的复杂性。

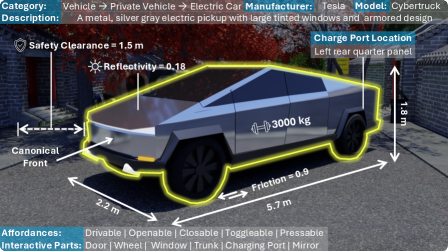

技术框架:UrbanVerse系统包含两个主要组成部分:UrbanVerse-100K和UrbanVerse-Gen。UrbanVerse-100K是一个包含超过10万个带语义和物理属性的城市3D资产的存储库。UrbanVerse-Gen是一个自动管道,它从城市漫游视频中提取场景布局,并使用UrbanVerse-100K中的资产实例化度量尺度的3D模拟场景。整个系统在NVIDIA IsaacSim中运行,提供物理引擎和传感器模拟。

关键创新:该论文的关键创新在于提出了一个数据驱动的真实到模拟的框架,能够自动将城市漫游视频转换为可交互的3D模拟环境。与传统的模拟环境构建方法相比,UrbanVerse具有更高的可扩展性和真实感,能够更好地支持具身智能体的训练和评估。

关键设计:UrbanVerse-Gen管道的关键设计包括:(1) 使用视觉SLAM技术从视频中重建场景的几何结构;(2) 使用语义分割和目标检测技术识别场景中的物体;(3) 从UrbanVerse-100K中检索与检测到的物体相匹配的3D资产;(4) 将检索到的3D资产放置到重建的场景中,生成完整的3D模拟环境。论文还设计了一套评估指标,用于评估生成场景的真实感和物理合理性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,UrbanVerse生成的场景在人工评估中达到了与手动制作场景相当的真实感。在城市导航任务中,使用UrbanVerse训练的策略在模拟环境中取得了显著的性能提升(+6.3%),并且在零样本sim-to-real迁移中,成功率提高了+30.1%,仅通过两次人工干预就完成了300米的真实世界导航任务,验证了UrbanVerse的有效性和泛化能力。

🎯 应用场景

UrbanVerse可广泛应用于机器人、自动驾驶、增强现实等领域。例如,可以用于训练送货机器人、自动驾驶汽车在复杂城市环境中的导航能力。此外,UrbanVerse还可以用于城市规划、游戏开发等领域,提供逼真的城市模拟环境,辅助决策和创作。

📄 摘要(原文)

Urban embodied AI agents, ranging from delivery robots to quadrupeds, are increasingly populating our cities, navigating chaotic streets to provide last-mile connectivity. Training such agents requires diverse, high-fidelity urban environments to scale, yet existing human-crafted or procedurally generated simulation scenes either lack scalability or fail to capture real-world complexity. We introduce UrbanVerse, a data-driven real-to-sim system that converts crowd-sourced city-tour videos into physics-aware, interactive simulation scenes. UrbanVerse consists of: (i) UrbanVerse-100K, a repository of 100k+ annotated urban 3D assets with semantic and physical attributes, and (ii) UrbanVerse-Gen, an automatic pipeline that extracts scene layouts from video and instantiates metric-scale 3D simulations using retrieved assets. Running in IsaacSim, UrbanVerse offers 160 high-quality constructed scenes from 24 countries, along with a curated benchmark of 10 artist-designed test scenes. Experiments show that UrbanVerse scenes preserve real-world semantics and layouts, achieving human-evaluated realism comparable to manually crafted scenes. In urban navigation, policies trained in UrbanVerse exhibit scaling power laws and strong generalization, improving success by +6.3% in simulation and +30.1% in zero-shot sim-to-real transfer comparing to prior methods, accomplishing a 300 m real-world mission with only two interventions.