GauSSmart: Enhanced 3D Reconstruction through 2D Foundation Models and Geometric Filtering

作者: Alexander Valverde, Brian Xu, Yuyin Zhou, Meng Xu, Hongyun Wang

分类: cs.CV, cs.GR

发布日期: 2025-10-16 (更新: 2025-11-10)

💡 一句话要点

GauSSmart:融合2D基础模型与几何滤波,提升3D高斯溅射重建效果

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 三维重建 高斯溅射 2D基础模型 语义特征 几何滤波

📋 核心要点

- 现有高斯溅射方法在稀疏区域重建中,难以捕捉精细细节和保持真实感,受限于稀疏的3D训练数据。

- GauSSmart融合2D基础模型和3D高斯溅射,利用2D先验和语义特征监督,引导高斯点的优化。

- 实验结果表明,GauSSmart在多个数据集上优于现有高斯溅射方法,验证了混合方法的有效性。

📝 摘要(中文)

场景重建是计算机视觉的核心挑战之一,神经辐射场(NeRF)和高斯溅射等方法取得了显著进展。虽然高斯溅射在大型数据集上表现出色,但由于稀疏3D训练数据的固有局限性,它在捕捉精细细节或在覆盖稀疏区域保持真实感方面存在困难。本文提出了GauSSmart,一种有效桥接2D基础模型和3D高斯溅射重建的混合方法。该方法集成了成熟的2D计算机视觉技术,包括凸滤波和来自DINO等基础模型的语义特征监督,以增强基于高斯的场景重建。通过利用2D分割先验和高维特征嵌入,该方法引导高斯点的密集化和细化,改善了代表性不足区域的覆盖范围,并保留了复杂的结构细节。在三个数据集上的验证表明,GauSSmart在大多数评估场景中始终优于现有的高斯溅射方法。结果表明,混合2D-3D方法具有巨大的潜力,通过深思熟虑地将2D基础模型与3D重建流程相结合,可以克服各自方法固有的局限性。

🔬 方法详解

问题定义:现有基于高斯溅射的3D场景重建方法,在训练数据稀疏的区域,难以重建出精细的几何结构和纹理细节,导致重建质量下降。这是由于3D重建本身依赖于高质量的3D数据,而稀疏的训练数据无法提供足够的约束。

核心思路:GauSSmart的核心思路是利用预训练的2D基础模型(如DINO)提供的先验知识,辅助3D高斯溅射的训练过程。具体来说,利用2D图像的分割信息和语义特征,引导高斯点的密集化和优化,从而在稀疏区域也能获得高质量的重建结果。这种方法结合了2D基础模型的泛化能力和3D高斯溅射的渲染能力。

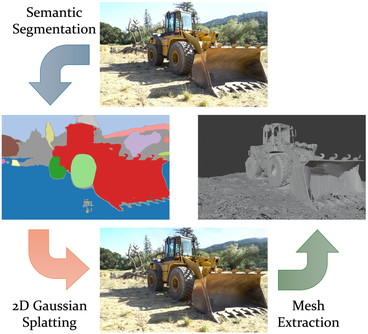

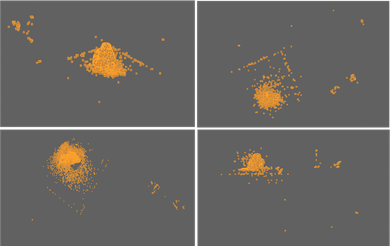

技术框架:GauSSmart的整体框架包含以下几个主要步骤:1) 使用2D基础模型(如DINO)提取输入图像的语义特征和分割掩码。2) 利用凸滤波等技术对分割掩码进行处理,得到更精确的区域划分。3) 将2D语义特征和分割信息投影到3D空间,作为高斯点密集化和优化的指导信号。4) 使用改进的损失函数,结合2D和3D信息,训练高斯溅射模型。5) 通过迭代优化,最终得到高质量的3D场景重建结果。

关键创新:GauSSmart的关键创新在于将2D基础模型的语义信息有效地融入到3D高斯溅射的训练过程中。与传统的3D重建方法相比,GauSSmart不再仅仅依赖于3D数据,而是充分利用了2D图像的先验知识,从而提高了重建的鲁棒性和精度。此外,GauSSmart还提出了一种新的损失函数,能够更好地平衡2D和3D信息的贡献。

关键设计:GauSSmart的关键设计包括:1) 使用DINO等预训练的2D基础模型提取语义特征,利用其强大的表征能力。2) 采用凸滤波等技术对分割掩码进行优化,提高分割精度。3) 设计了一种新的损失函数,包括3D重建损失、2D语义一致性损失和几何约束损失,以保证重建结果的质量。4) 通过自适应地调整高斯点的密度和形状,实现对场景的精细建模。

🖼️ 关键图片

📊 实验亮点

GauSSmart在三个数据集上进行了验证,结果表明,在大多数评估场景中,GauSSmart的重建质量均优于现有的高斯溅射方法。具体而言,GauSSmart在细节重建和真实感保持方面表现出色,尤其是在训练数据稀疏的区域。实验结果证明了GauSSmart融合2D基础模型和3D高斯溅射的有效性,为三维重建领域提供了一种新的思路。

🎯 应用场景

GauSSmart在三维重建领域具有广泛的应用前景,例如虚拟现实、增强现实、机器人导航、自动驾驶、城市建模等。该方法可以用于创建高质量的3D场景模型,为用户提供更逼真的沉浸式体验。此外,GauSSmart还可以应用于文物保护、建筑设计等领域,为相关专业人员提供更精确的三维数据支持。未来,该方法有望进一步推广到更多领域,推动三维重建技术的发展。

📄 摘要(原文)

Scene reconstruction has emerged as a central challenge in computer vision, with approaches such as Neural Radiance Fields (NeRF) and Gaussian Splatting achieving remarkable progress. While Gaussian Splatting demonstrates strong performance on large-scale datasets, it often struggles to capture fine details or maintain realism in regions with sparse coverage, largely due to the inherent limitations of sparse 3D training data. In this work, we propose GauSSmart, a hybrid method that effectively bridges 2D foundational models and 3D Gaussian Splatting reconstruction. Our approach integrates established 2D computer vision techniques, including convex filtering and semantic feature supervision from foundational models such as DINO, to enhance Gaussian-based scene reconstruction. By leveraging 2D segmentation priors and high-dimensional feature embeddings, our method guides the densification and refinement of Gaussian splats, improving coverage in underrepresented areas and preserving intricate structural details. We validate our approach across three datasets, where GauSSmart consistently outperforms existing Gaussian Splatting in the majority of evaluated scenes. Our results demonstrate the significant potential of hybrid 2D-3D approaches, highlighting how the thoughtful combination of 2D foundational models with 3D reconstruction pipelines can overcome the limitations inherent in either approach alone.