Epistemic-aware Vision-Language Foundation Model for Fetal Ultrasound Interpretation

作者: Xiao He, Huangxuan Zhao, Guojia Wan, Wei Zhou, Yanxing Liu, Juhua Liu, Yongchao Xu, Yong Luo, Dacheng Tao, Bo Du

分类: cs.CV, cs.AI, cs.IR, cs.MM

发布日期: 2025-10-14 (更新: 2026-01-27)

备注: This paper contains fundamental errors and will not be replaced

DOI: 10.48550/arXiv.2510.12953

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出FetalMind,用于胎儿超声报告生成和诊断,提升多视图推理和疾病识别能力。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 胎儿超声 视觉-语言模型 报告生成 疾病诊断 认知解耦 强化学习 医学影像

📋 核心要点

- 现有医学视觉-语言模型在胎儿超声图像上表现不佳,原因是缺乏对多视图推理和复杂疾病的有效处理。

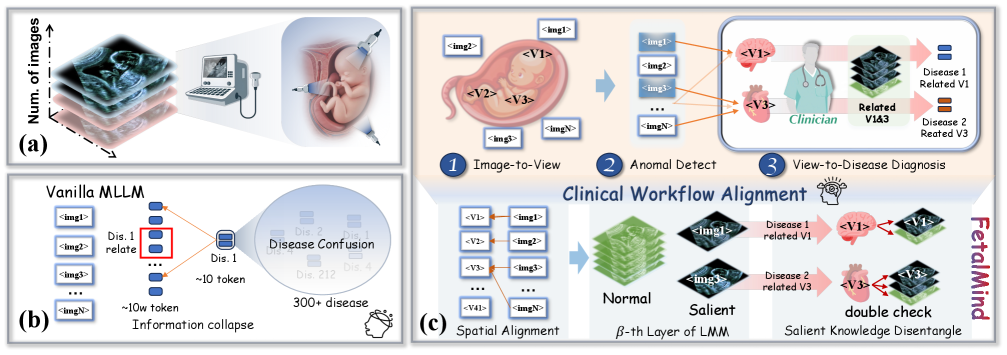

- FetalMind通过引入显著性认知解耦(SED)模块,利用专家知识解耦视图-疾病关联,并使用强化学习模拟临床诊断流程。

- FetalMind在FetalSigma-1M数据集上训练,实验结果表明其在报告生成和疾病诊断方面显著优于现有方法。

📝 摘要(中文)

本文提出FetalMind,一个专为胎儿超声设计的医学AI系统,用于报告生成和诊断。针对胎儿超声图像多视图推理、疾病种类繁多和图像多样性的挑战,提出了显著性认知解耦(SED)方法,通过专家构建的二分图将视图-疾病关联解耦,并通过强化学习引导模型沿着临床步骤进行偏好选择。该设计缓解了疾病间的变异性和视图间的异质性,减少学习瓶颈,同时使模型的推理与产科实践对齐。为了大规模训练FetalMind,构建了FetalSigma-1M数据集,这是首个大规模胎儿超声报告语料库,包含来自十二个医疗中心的2万份报告,解决了领域数据稀缺的问题。大量实验表明,FetalMind在所有妊娠阶段均优于开源和闭源基线,平均提升+14%,在关键疾病上的准确率提高+61.2%,同时保持高效、稳定和可扩展。

🔬 方法详解

问题定义:现有医学视觉-语言模型在胎儿超声图像的报告生成和疾病诊断任务中表现不佳。主要痛点在于胎儿超声图像具有多视图特性,疾病种类繁多,且图像质量和内容差异大,导致模型难以有效学习和推理。此外,现有模型通常针对结构化的成人影像数据设计,缺乏对胎儿超声领域知识的有效利用。

核心思路:FetalMind的核心思路是利用专家知识,将胎儿超声图像的视图信息和疾病信息进行解耦,从而缓解视图和疾病之间的复杂关联带来的学习困难。通过引入显著性认知解耦(SED)模块,模型可以更好地理解不同视图对诊断特定疾病的重要性,并模拟临床医生的诊断流程。

技术框架:FetalMind的整体框架包含一个视觉-语言模型,以及一个显著性认知解耦(SED)模块。视觉-语言模型负责提取图像和文本特征,SED模块则利用专家构建的二分图来解耦视图-疾病关联。模型首先通过视觉编码器提取胎儿超声图像的特征,然后将这些特征与文本信息一起输入到语言模型中进行处理。SED模块在语言模型的中间层注入,用于调整特征表示,使其更好地反映视图和疾病之间的关系。最后,模型输出报告或诊断结果。

关键创新:FetalMind最重要的技术创新点是显著性认知解耦(SED)模块。SED模块通过专家构建的二分图,显式地建模了视图和疾病之间的关联关系。这种显式建模使得模型能够更好地理解不同视图对诊断特定疾病的重要性,从而提高诊断的准确性。与现有方法相比,SED模块能够更有效地利用领域知识,并缓解视图和疾病之间的复杂关联带来的学习困难。

关键设计:SED模块的关键设计包括:1) 专家构建的二分图,用于表示视图和疾病之间的关联关系;2) 基于强化学习的偏好选择机制,用于模拟临床医生的诊断流程;3) 特定的损失函数,用于鼓励模型学习到视图和疾病之间的正确关联。此外,FetalMind还使用了大规模的FetalSigma-1M数据集进行训练,以提高模型的泛化能力。

🖼️ 关键图片

📊 实验亮点

FetalMind在FetalSigma-1M数据集上进行了广泛的实验,结果表明其在报告生成和疾病诊断方面显著优于现有的开源和闭源基线模型。具体而言,FetalMind在所有妊娠阶段的平均性能提升了+14%,在关键疾病上的诊断准确率提高了+61.2%。这些结果表明FetalMind具有很强的实用价值和应用前景。

🎯 应用场景

FetalMind可应用于胎儿超声图像的自动报告生成和疾病诊断,辅助医生进行临床决策,提高诊断效率和准确性。该研究具有重要的临床价值,有助于改善孕妇的健康管理和胎儿的健康状况。未来,该技术可进一步推广到其他医学影像领域,例如成人超声、X光和CT等。

📄 摘要(原文)

Recent medical vision-language models have shown promise on tasks such as VQA, report generation, and anomaly detection. However, most are adapted to structured adult imaging and underperform in fetal ultrasound, which poses challenges of multi-view image reasoning, numerous diseases, and image diversity. To bridge this gap, we introduce FetalMind, a medical AI system tailored to fetal ultrasound for both report generation and diagnosis. Guided by clinical workflow, we propose Salient Epistemic Disentanglement (SED), which injects an expert-curated bipartite graph into the model to decouple view-disease associations and to steer preference selection along clinically faithful steps via reinforcement learning. This design mitigates variability across diseases and heterogeneity across views, reducing learning bottlenecks while aligning the model's inference with obstetric practice. To train FetalMind at scale, we curate FetalSigma-1M dataset, the first large-scale fetal ultrasound report corpus, comprising 20K reports from twelve medical centers, addressing the scarcity of domain data. Extensive experiments show that FetalMind outperforms open- and closed-source baselines across all gestational stages, achieving +14% average gains and +61.2% higher accuracy on critical conditions while remaining efficient, stable, and scalable. Project Page: https://hexiao0275.github.io/FetalMind.