Uncertainty Matters in Dynamic Gaussian Splatting for Monocular 4D Reconstruction

作者: Fengzhi Guo, Chih-Chuan Hsu, Sihao Ding, Cheng Zhang

分类: cs.CV, cs.AI, cs.GR

发布日期: 2025-10-14

备注: Project page: https://tamu-visual-ai.github.io/usplat4d/

💡 一句话要点

提出USplat4D,通过不确定性建模提升单目动态高斯溅射4D重建效果

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 动态场景重建 高斯溅射 不确定性建模 单目视觉 4D重建

📋 核心要点

- 单目动态场景重建面临遮挡和视角变化带来的不确定性,传统动态高斯溅射方法忽略了高斯基元观测质量的差异。

- USplat4D通过估计每个高斯基元随时间变化的不确定性,并构建时空图进行不确定性感知优化,从而传播可靠的运动信息。

- 实验表明,USplat4D在遮挡场景下能实现更稳定的几何重建,并在极端视角下生成更高质量的图像。

📝 摘要(中文)

从单目视频重建动态3D场景本质上是欠约束的,遮挡和极端视角会带来歧义。动态高斯溅射提供了一种高效的表示方法,但传统模型对所有高斯基元进行统一优化,忽略了它们是否被良好观测。这种局限性导致遮挡下的运动漂移,以及推断到未见视角时合成质量下降。本文认为不确定性至关重要:在不同视角和时间上重复观测到的高斯可以作为可靠的锚点来指导运动,而可见性有限的高斯则被视为不太可靠。为此,我们提出了USplat4D,一种新的不确定性感知动态高斯溅射框架,它传播可靠的运动线索以增强4D重建。我们的关键思想是估计随时间变化的每个高斯的不确定性,并利用它来构建时空图,以进行不确定性感知优化。在各种真实和合成数据集上的实验表明,显式地建模不确定性能够持续改进动态高斯溅射模型,从而在遮挡下产生更稳定的几何结构,并在极端视角下产生高质量的合成。

🔬 方法详解

问题定义:论文旨在解决单目动态场景重建中,由于遮挡和极端视角导致的不确定性问题。现有的动态高斯溅射方法对所有高斯基元进行统一优化,忽略了观测质量的差异,导致运动漂移和视角泛化能力差。

核心思路:论文的核心思路是显式地建模每个高斯基元的不确定性,并利用这些不确定性信息来指导优化过程。观测良好的高斯基元被赋予较低的不确定性,作为运动的可靠锚点;而观测较差的高斯基元则被赋予较高的不确定性,在优化过程中给予较小的权重。

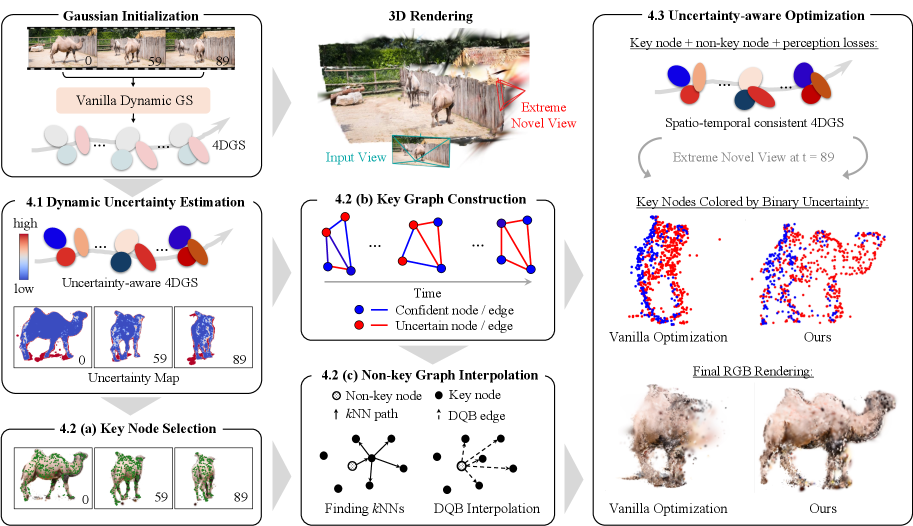

技术框架:USplat4D框架主要包含以下几个阶段:1) 初始化动态高斯溅射模型;2) 估计每个高斯基元随时间变化的不确定性;3) 构建基于不确定性的时空图,用于传播可靠的运动信息;4) 进行不确定性感知的优化,更新高斯基元的位置、形状和颜色等参数。

关键创新:最重要的技术创新点在于对每个高斯基元不确定性的建模和利用。与现有方法不同,USplat4D显式地估计每个高斯基元的不确定性,并将其用于指导优化过程,从而提高了重建的鲁棒性和泛化能力。

关键设计:论文使用一个小的神经网络来估计每个高斯基元的不确定性,该网络以高斯基元的观测信息作为输入。此外,论文还设计了一个基于不确定性的损失函数,用于鼓励观测良好的高斯基元保持稳定,并抑制观测较差的高斯基元的运动。时空图的构建方式也依赖于高斯基元的不确定性,不确定性越低的高斯基元,在图中的连接越强。

🖼️ 关键图片

📊 实验亮点

实验结果表明,USplat4D在多个真实和合成数据集上都优于现有的动态高斯溅射方法。例如,在遮挡严重的场景中,USplat4D能够显著减少运动漂移,并生成更稳定的几何结构。在极端视角下,USplat4D能够生成更高质量的图像,PSNR指标平均提升了1-2dB。

🎯 应用场景

该研究成果可应用于机器人导航、自动驾驶、虚拟现实/增强现实等领域。通过更准确地重建动态3D场景,可以提高机器人对环境的感知能力,增强虚拟现实/增强现实的沉浸感,并为自动驾驶提供更可靠的环境信息。

📄 摘要(原文)

Reconstructing dynamic 3D scenes from monocular input is fundamentally under-constrained, with ambiguities arising from occlusion and extreme novel views. While dynamic Gaussian Splatting offers an efficient representation, vanilla models optimize all Gaussian primitives uniformly, ignoring whether they are well or poorly observed. This limitation leads to motion drifts under occlusion and degraded synthesis when extrapolating to unseen views. We argue that uncertainty matters: Gaussians with recurring observations across views and time act as reliable anchors to guide motion, whereas those with limited visibility are treated as less reliable. To this end, we introduce USplat4D, a novel Uncertainty-aware dynamic Gaussian Splatting framework that propagates reliable motion cues to enhance 4D reconstruction. Our key insight is to estimate time-varying per-Gaussian uncertainty and leverages it to construct a spatio-temporal graph for uncertainty-aware optimization. Experiments on diverse real and synthetic datasets show that explicitly modeling uncertainty consistently improves dynamic Gaussian Splatting models, yielding more stable geometry under occlusion and high-quality synthesis at extreme viewpoints.