PET Head Motion Estimation Using Supervised Deep Learning with Attention

作者: Zhuotong Cai, Tianyi Zeng, Jiazhen Zhang, Eléonore V. Lieffrig, Kathryn Fontaine, Chenyu You, Enette Mae Revilla, James S. Duncan, Jingmin Xin, Yihuan Lu, John A. Onofrey

分类: cs.CV

发布日期: 2025-10-14

备注: Accepted for publication in IEEE Transactions on Medical Imaging (TMI), 2025. This is the accepted manuscript version

🔗 代码/项目: GITHUB

💡 一句话要点

提出基于注意力机制的深度学习方法DL-HMC++,用于PET头部运动估计与校正。

🎯 匹配领域: 支柱七:动作重定向 (Motion Retargeting) 支柱八:物理动画 (Physics-based Animation)

关键词: PET成像 头部运动校正 深度学习 注意力机制 医学图像处理

📋 核心要点

- 头部运动是PET成像中的主要问题,导致图像质量下降和定量分析不准确,现有硬件运动跟踪方法应用受限。

- 提出DL-HMC++,一种基于深度学习和交叉注意力机制的头部运动校正方法,直接从PET原始数据预测头部运动。

- 实验结果表明,DL-HMC++在多种PET扫描仪和示踪剂下均优于现有方法,生成高质量图像,且与金标准方法结果高度一致。

📝 摘要(中文)

头部运动是脑部正电子发射断层扫描(PET)成像中的一个重大挑战,会导致图像伪影和示踪剂摄取量化不准确。有效的头部运动估计和校正对于精确的定量图像分析和神经系统疾病的准确诊断至关重要。基于硬件的运动跟踪(HMT)在实际临床应用中具有局限性。为了克服这一限制,我们提出了一种基于深度学习的头部运动校正方法,即带有交叉注意力的DL-HMC++,以从一秒钟的3D PET原始数据中预测刚性头部运动。DL-HMC++通过利用现有的动态PET扫描以及来自外部HMT的金标准运动测量,以监督方式进行训练。我们在两种PET扫描仪(HRRT和mCT)和四种放射性示踪剂(18F-FDG、18F-FPEB、11C-UCB-J和11C-LSN3172176)上评估DL-HMC++,以证明该方法在大型队列PET研究中的有效性和泛化性。定量和定性结果表明,DL-HMC++始终优于最先进的数据驱动的运动估计方法,生成无运动伪影的图像,具有清晰的大脑结构轮廓,并且与金标准HMT无法区分。大脑感兴趣区域的标准摄取值分析显示,HRRT的DL-HMC++与金标准HMT之间的平均差异比率为1.2±0.5%,mCT为0.5±0.2%。DL-HMC++展示了数据驱动的PET头部运动校正的潜力,可以消除HMT的负担,使运动校正能够应用于研究环境之外的临床人群。

🔬 方法详解

问题定义:论文旨在解决PET成像中头部运动导致的图像伪影和定量分析误差问题。现有的硬件运动跟踪(HMT)方法虽然精度高,但成本高昂,操作复杂,难以在临床环境中广泛应用。数据驱动的运动估计方法虽然降低了成本,但精度仍有提升空间。

核心思路:论文的核心思路是利用深度学习直接从PET原始数据中学习头部运动的模式,从而实现高精度、低成本的运动校正。通过监督学习的方式,利用HMT提供的金标准运动数据训练深度学习模型,使其能够准确预测头部运动。

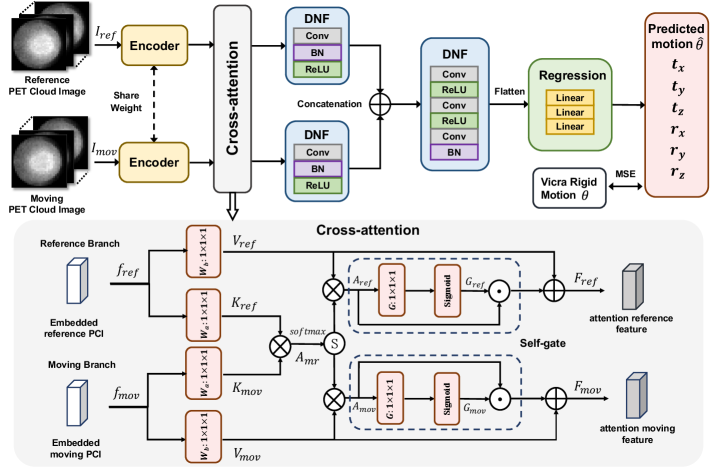

技术框架:DL-HMC++的整体框架包括数据预处理、深度学习模型训练和运动校正三个主要阶段。首先,对PET原始数据进行预处理,包括数据归一化等操作。然后,使用带有交叉注意力机制的深度学习模型,以PET原始数据作为输入,预测头部运动参数。最后,利用预测的运动参数对PET图像进行运动校正。

关键创新:DL-HMC++的关键创新在于使用了带有交叉注意力机制的深度学习模型。交叉注意力机制能够有效地捕捉PET数据中不同区域之间的相关性,从而提高运动估计的精度。此外,该方法直接从PET原始数据进行学习,避免了传统方法中需要手动设计特征的步骤。

关键设计:DL-HMC++使用了三维卷积神经网络作为基础架构,并引入了交叉注意力模块。损失函数采用均方误差(MSE),优化器选择Adam。训练数据包括来自HRRT和mCT扫描仪的PET数据,以及四种不同的放射性示踪剂。为了提高模型的泛化能力,采用了数据增强技术,例如随机旋转和缩放。

🖼️ 关键图片

📊 实验亮点

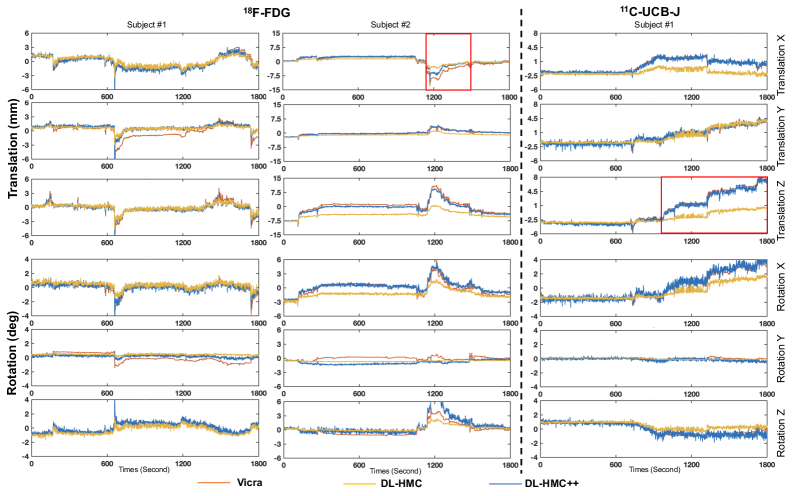

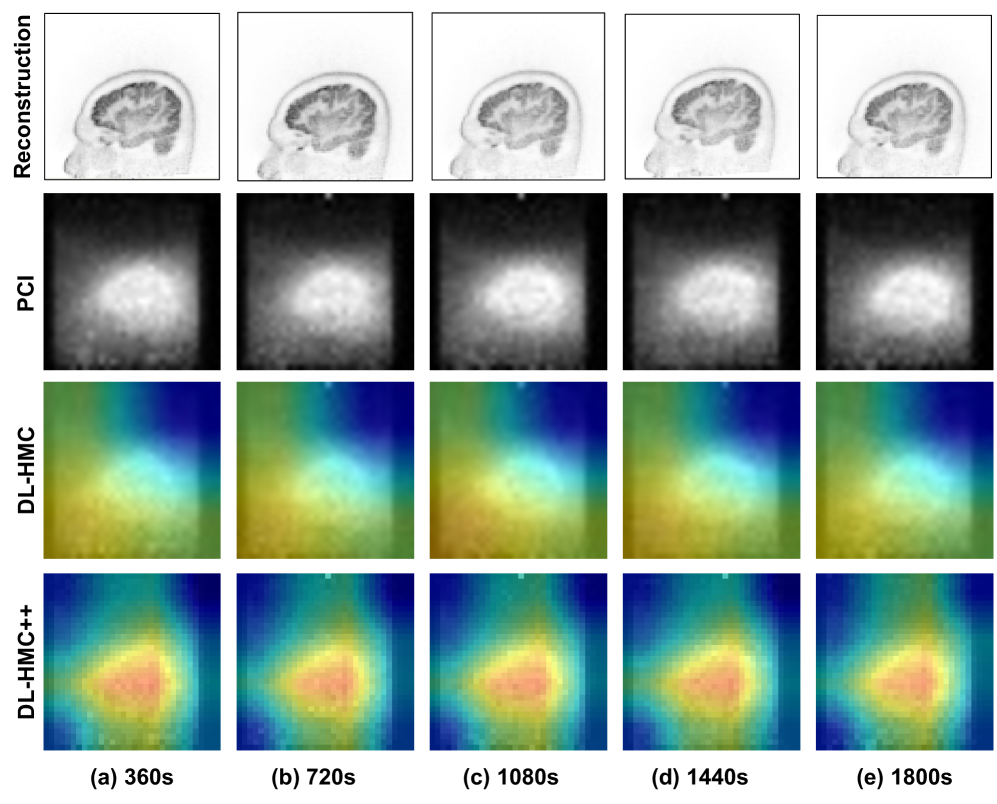

DL-HMC++在HRRT和mCT扫描仪上,以及四种放射性示踪剂下均表现出优异的性能。与金标准HMT相比,HRRT的DL-HMC++与金标准HMT之间的平均差异比率为1.2±0.5%,mCT为0.5±0.2%。定性和定量结果均表明,DL-HMC++优于现有的数据驱动运动估计方法,能够生成高质量的无运动伪影图像。

🎯 应用场景

该研究成果可广泛应用于临床PET成像,提高图像质量和定量分析的准确性,从而改善神经系统疾病的诊断和治疗效果。该方法有望降低PET运动校正的成本和复杂性,使其能够应用于更广泛的临床人群,并促进PET成像技术在临床研究和药物开发中的应用。

📄 摘要(原文)

Head movement poses a significant challenge in brain positron emission tomography (PET) imaging, resulting in image artifacts and tracer uptake quantification inaccuracies. Effective head motion estimation and correction are crucial for precise quantitative image analysis and accurate diagnosis of neurological disorders. Hardware-based motion tracking (HMT) has limited applicability in real-world clinical practice. To overcome this limitation, we propose a deep-learning head motion correction approach with cross-attention (DL-HMC++) to predict rigid head motion from one-second 3D PET raw data. DL-HMC++ is trained in a supervised manner by leveraging existing dynamic PET scans with gold-standard motion measurements from external HMT. We evaluate DL-HMC++ on two PET scanners (HRRT and mCT) and four radiotracers (18F-FDG, 18F-FPEB, 11C-UCB-J, and 11C-LSN3172176) to demonstrate the effectiveness and generalization of the approach in large cohort PET studies. Quantitative and qualitative results demonstrate that DL-HMC++ consistently outperforms state-of-the-art data-driven motion estimation methods, producing motion-free images with clear delineation of brain structures and reduced motion artifacts that are indistinguishable from gold-standard HMT. Brain region of interest standard uptake value analysis exhibits average difference ratios between DL-HMC++ and gold-standard HMT to be 1.2 plus-minus 0.5% for HRRT and 0.5 plus-minus 0.2% for mCT. DL-HMC++ demonstrates the potential for data-driven PET head motion correction to remove the burden of HMT, making motion correction accessible to clinical populations beyond research settings. The code is available at https://github.com/maxxxxxxcai/DL-HMC-TMI.