Personalized Federated Fine-Tuning of Vision Foundation Models for Healthcare

作者: Adam Tupper, Christian Gagné

分类: cs.CV, cs.DC

发布日期: 2025-10-14

备注: Accepted to the Symposium on Model Accountability, Sustainability and Healthcare (SMASH) 2025

💡 一句话要点

提出个性化联邦微调方法,用于医疗领域视觉基础模型。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 联邦学习 视觉基础模型 个性化微调 医疗影像 LoRA适配器

📋 核心要点

- 医疗数据隐私限制导致数据共享困难,阻碍了视觉基础模型在医疗领域的应用。

- 提出一种个性化联邦微调方法,通过正交LoRA适配器解耦通用知识和客户端特定知识。

- 在真实医疗影像数据集上的实验表明,该方法与现有联邦微调方法相比具有竞争力。

📝 摘要(中文)

基础模型为人工智能在医疗领域的应用开辟了新的可能性。然而,即使在健康数据上进行预训练,它们仍然需要针对特定的下游任务进行微调。此外,尽管基础模型减少了实现良好性能所需的训练数据量,但获得足够的数据仍然是一个挑战。这部分是由于共享和聚合来自不同来源的数据以保护患者隐私的限制。一个可能的解决方案是通过联邦学习跨多个参与客户端(即医院、诊所等)微调基础模型。在这项工作中,我们提出了一种新的个性化联邦微调方法,该方法学习正交LoRA适配器来解耦通用和客户端特定的知识,使每个客户端能够充分利用他们自己的数据和他人的数据。我们在真实世界的联邦医疗成像任务上的初步结果表明,我们的方法与当前的联邦微调方法相比具有竞争力。

🔬 方法详解

问题定义:论文旨在解决医疗领域中,由于数据隐私限制导致无法直接共享和聚合数据,从而阻碍视觉基础模型微调的问题。现有联邦学习方法在个性化方面存在不足,无法充分利用每个客户端的独特数据特征。

核心思路:论文的核心思路是利用正交LoRA适配器,将视觉基础模型中的通用知识和客户端特定知识进行解耦。通过学习正交的适配器,每个客户端可以在保留通用知识的同时,专注于学习自身数据的独特特征,从而实现个性化的微调。

技术框架:整体框架基于联邦学习,每个客户端拥有自己的本地数据集。在每一轮联邦学习中,客户端首先使用本地数据和正交LoRA适配器对基础模型进行微调。然后,客户端将适配器的参数上传到服务器进行聚合。服务器聚合后,将更新后的适配器参数发送回客户端。客户端使用更新后的适配器参数继续进行下一轮的微调。

关键创新:最重要的技术创新点是使用正交LoRA适配器来解耦通用知识和客户端特定知识。与传统的联邦微调方法相比,该方法能够更好地利用每个客户端的独特数据特征,从而实现更个性化的微调效果。正交性约束保证了适配器学习到的知识与原始模型知识的互补性,避免了灾难性遗忘。

关键设计:LoRA适配器被设计为与原始模型参数正交,通过添加正交性约束到损失函数中来实现。损失函数包括数据拟合损失和正交性约束损失。具体来说,使用Frobenius内积来衡量LoRA适配器参数与原始模型参数之间的正交性,并将其作为正则化项添加到损失函数中。通过调整正则化系数,可以控制正交性约束的强度。

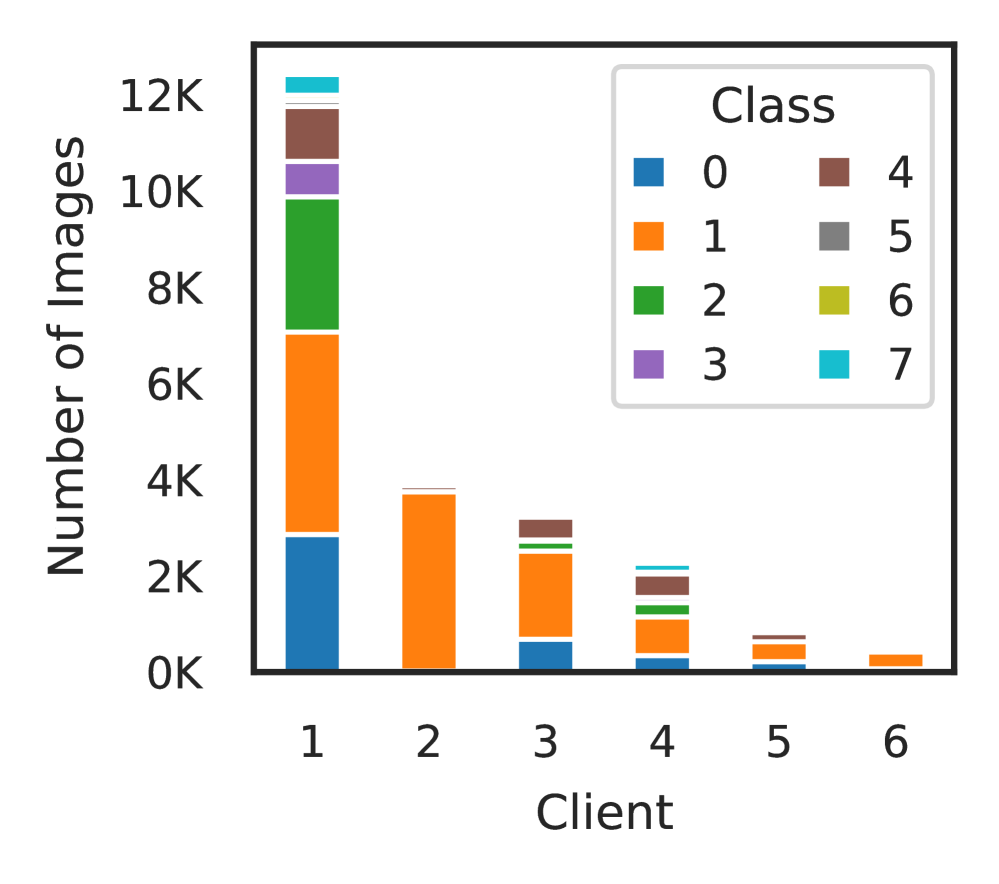

🖼️ 关键图片

📊 实验亮点

论文在真实世界的联邦医疗影像任务上进行了实验,结果表明该方法与当前的联邦微调方法相比具有竞争力。具体性能数据和对比基线在摘要中未明确给出,但强调了该方法在实际应用中的潜力。未来的工作可以进一步量化性能提升,并与其他先进的联邦学习算法进行更全面的比较。

🎯 应用场景

该研究成果可应用于医疗影像诊断、病理分析、基因组学等多个领域。通过联邦学习和个性化微调,可以在保护患者隐私的前提下,利用多中心数据训练出更精准、更具泛化能力的AI模型,辅助医生进行诊断和治疗决策,提升医疗服务质量。

📄 摘要(原文)

Foundation models open up new possibilities for the use of AI in healthcare. However, even when pre-trained on health data, they still need to be fine-tuned for specific downstream tasks. Furthermore, although foundation models reduce the amount of training data required to achieve good performance, obtaining sufficient data is still a challenge. This is due, in part, to restrictions on sharing and aggregating data from different sources to protect patients' privacy. One possible solution to this is to fine-tune foundation models via federated learning across multiple participating clients (i.e., hospitals, clinics, etc.). In this work, we propose a new personalized federated fine-tuning method that learns orthogonal LoRA adapters to disentangle general and client-specific knowledge, enabling each client to fully exploit both their own data and the data of others. Our preliminary results on real-world federated medical imaging tasks demonstrate that our approach is competitive against current federated fine-tuning methods.