SAIL-Embedding Technical Report: Omni-modal Embedding Foundation Model

作者: Lin Lin, Jiefeng Long, Zhihe Wan, Yuchi Wang, Dingkang Yang, Shuang Yang, Yueyang Yao, Xu Chen, Zirui Guo, Shengqiang Li, Weiran Li, Hanyu Li, Yaling Mou, Yan Qiu, Haiyang Yu, Xiao Liang, Hongsheng Li, Chao Feng

分类: cs.IR, cs.CV

发布日期: 2025-10-14 (更新: 2025-11-02)

备注: Technical Report

💡 一句话要点

SAIL-Embedding:面向真实场景的通用多模态嵌入基础模型

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态嵌入 跨模态学习 推荐系统 知识蒸馏 对比学习 内容理解 用户行为建模

📋 核心要点

- 现有跨模态嵌入模型在模态支持、训练稳定性和领域适应性方面存在不足,难以满足实际应用需求。

- SAIL-Embedding通过定制训练策略和架构设计,提出多阶段训练方案,增强模型对下游任务的适应性和跨模态能力。

- 实验表明,SAIL-Embedding在检索任务中达到SOTA,并在抖音等真实场景中显著提升了用户生命周期等关键指标。

📝 摘要(中文)

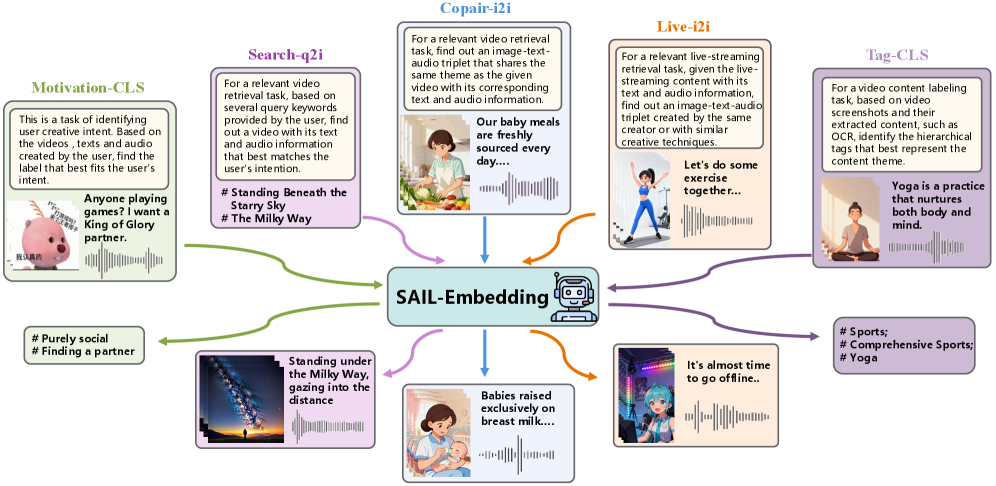

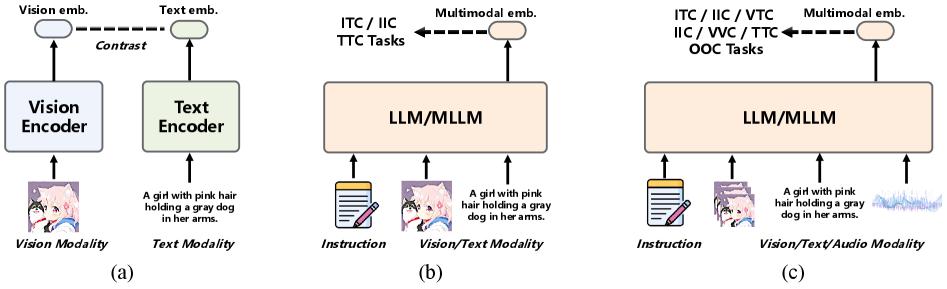

多模态嵌入模型旨在生成信息丰富的统一表示,从而支持各种跨模态任务。尽管基于CLIP的双塔架构到大型视觉语言模型的演进取得了可喜的进展,但先前的工作在实际应用和商业场景中仍然面临不可避免的挑战,例如模态支持有限、训练机制不稳定以及工业领域差距。本文介绍了SAIL-Embedding,一种通用多模态嵌入基础模型,通过定制的训练策略和架构设计来解决这些问题。在优化过程中,我们提出了一种多阶段训练方案,以提高表示学习的多方面有效性。具体而言,内容感知渐进式训练旨在增强模型对各种下游任务的适应性,并掌握丰富的跨模态能力。协作感知推荐增强训练通过从序列到项目和ID到项目嵌入中提取知识,同时挖掘用户历史兴趣,进一步调整多模态表示以适应推荐场景。同时,我们开发了随机专业化和数据集驱动的模式匹配,以加强模型训练的灵活性和泛化性。实验结果表明,与其他方法相比,SAIL-Embedding在不同的检索任务中实现了SOTA性能。在与我们的模型集成的各种真实场景的在线实验中,我们观察到生命周期(LT)的显着增加,这是推荐体验的关键指标。例如,该模型在抖音精选场景中实现了+0.5%的7天LT增益。对于抖音Feed排序模型,SAIL-Embedding生成的匹配特征产生了+0.1%的AUC增益。

🔬 方法详解

问题定义:现有方法在多模态嵌入方面存在模态支持不足、训练不稳定以及领域适应性差等问题,难以满足实际工业应用的需求。尤其是在推荐系统中,如何有效利用多模态信息来提升用户体验是一个挑战。

核心思路:SAIL-Embedding的核心思路是通过定制化的训练策略和架构设计,构建一个通用的多模态嵌入模型。该模型旨在学习到信息丰富且具有良好泛化能力的统一表示,从而支持各种跨模态任务,并能有效地应用于实际的推荐场景。

技术框架:SAIL-Embedding采用多阶段训练方案,包括内容感知渐进式训练和协作感知推荐增强训练。内容感知渐进式训练旨在提升模型对不同下游任务的适应性,并学习丰富的跨模态知识。协作感知推荐增强训练则通过知识蒸馏和用户历史兴趣挖掘,优化模型在推荐场景下的表现。此外,还引入了随机专业化和数据集驱动的模式匹配来增强模型的灵活性和泛化能力。

关键创新:SAIL-Embedding的关键创新在于其多阶段训练方案和针对推荐场景的优化策略。内容感知渐进式训练能够有效提升模型的跨模态理解能力,而协作感知推荐增强训练则能够将多模态信息与用户行为数据相结合,从而更好地捕捉用户兴趣。随机专业化和数据集驱动的模式匹配则进一步提升了模型的泛化能力。

关键设计:内容感知渐进式训练的具体实现方式未知,但推测可能涉及逐步增加训练数据的复杂度和多样性,以及采用不同的损失函数来引导模型学习不同层次的跨模态特征。协作感知推荐增强训练可能使用了知识蒸馏技术,将序列到项目和ID到项目嵌入的知识迁移到多模态嵌入模型中。随机专业化和数据集驱动的模式匹配的具体实现方式也未知。

🖼️ 关键图片

📊 实验亮点

SAIL-Embedding在不同检索任务中取得了SOTA性能。在抖音精选场景中,该模型带来了+0.5%的7天用户生命周期增益。在抖音Feed排序模型中,SAIL-Embedding生成的匹配特征带来了+0.1%的AUC增益。这些结果表明,该模型在实际应用中具有显著的提升效果。

🎯 应用场景

SAIL-Embedding具有广泛的应用前景,可应用于图像、文本、音频、视频等多模态数据的检索、推荐、分类等任务。尤其在电商、短视频等领域,该模型能够有效提升用户体验和平台收益,例如个性化推荐、内容审核、智能搜索等。

📄 摘要(原文)

Multimodal embedding models aim to yield informative unified representations that empower diverse cross-modal tasks. Despite promising developments in the evolution from CLIP-based dual-tower architectures to large vision-language models, prior works still face unavoidable challenges in real-world applications and business scenarios, such as the limited modality support, unstable training mechanisms, and industrial domain gaps. In this work, we introduce SAIL-Embedding, an omni-modal embedding foundation model that addresses these issues through tailored training strategies and architectural design. In the optimization procedure, we propose a multi-stage training scheme to boost the multifaceted effectiveness of representation learning. Specifically, the content-aware progressive training aims to enhance the model's adaptability to diverse downstream tasks and master enriched cross-modal proficiency. The collaboration-aware recommendation enhancement training further adapts multimodal representations for recommendation scenarios by distilling knowledge from sequence-to-item and ID-to-item embeddings while mining user historical interests. Concurrently, we develop the stochastic specialization and dataset-driven pattern matching to strengthen model training flexibility and generalizability. Experimental results show that SAIL-Embedding achieves SOTA performance compared to other methods in different retrieval tasks. In online experiments across various real-world scenarios integrated with our model, we observe a significant increase in Lifetime (LT), which is a crucial indicator for the recommendation experience. For instance, the model delivers the 7-day LT gain of +0.5% in the Douyin-Selected scenario. For the Douyin feed rank model, the match features produced by SAIL-Embedding yield a +0.1% AUC gain.