Unlocking Zero-Shot Plant Segmentation with Pl@ntNet Intelligence

作者: Simon Ravé, Jean-Christophe Lombardo, Pejman Rasti, Alexis Joly, David Rousseau

分类: cs.CV

发布日期: 2025-10-14

💡 一句话要点

利用Pl@ntNet知识,实现农业图像零样本植物分割

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 零样本分割 农业图像 植物分割 Plantnet DinoV2 Segment Anything Model 农业智能化

📋 核心要点

- 现有农业图像分割方法依赖大量标注数据,成本高昂且难以适应复杂场景。

- 利用Plantnet的植物知识和DinoV2特征,结合SAM进行零样本分割,无需额外标注。

- 实验表明,Plantnet微调的DinoV2显著提升了分割性能,验证了该方法的有效性。

📝 摘要(中文)

本文提出了一种农业图像的零样本分割方法,该方法结合了大规模植物分类模型Plantnet及其DinoV2骨干网络与Segment Anything Model (SAM)。该方法没有收集和标注新的数据集,而是利用Plantnet的专业植物表征来识别植物区域并生成粗略的分割掩码。然后,这些掩码通过SAM进行细化,从而产生详细的分割结果。我们在四个公开可用的数据集上进行了评估,这些数据集在对比度方面具有不同的复杂性,其中一些数据集由于训练数据规模有限和复杂的田间条件,常常阻碍纯监督方法。结果表明,使用Plantnet微调的DinoV2相比于基础DinoV2模型,在Jaccard指数(IoU)的测量下,性能得到了持续提升。这些发现突出了将基础模型与专门的以植物为中心的模型相结合的潜力,从而缓解了标注瓶颈,并实现了在各种农业场景中的有效分割。

🔬 方法详解

问题定义:农业图像分割任务中,现有方法依赖于大量标注数据,这在实际应用中成本高昂且难以获取。特别是在田间环境复杂、光照条件多变的情况下,标注数据的质量和数量直接影响分割效果。因此,如何降低对标注数据的依赖,实现零样本或少样本的植物分割是一个重要的挑战。

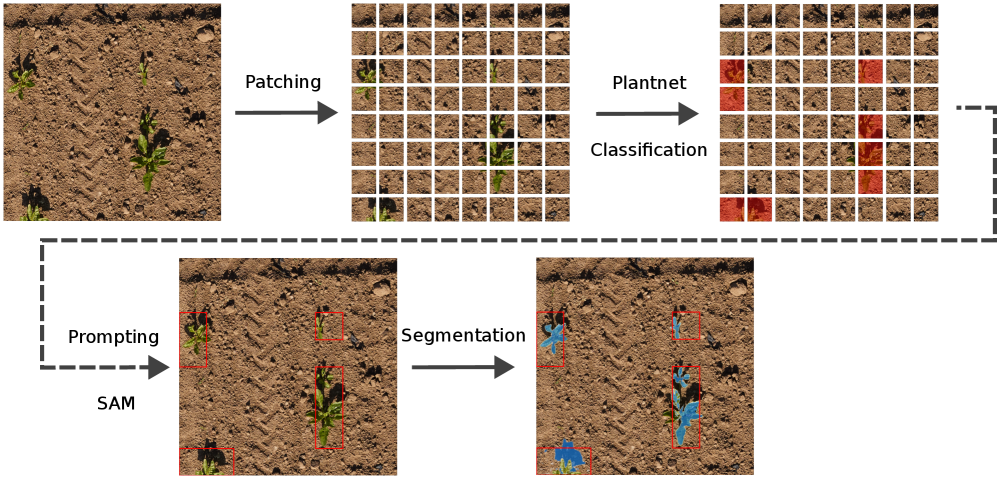

核心思路:本文的核心思路是利用预训练的植物分类模型Plantnet所学习到的植物特征表示,结合Segment Anything Model (SAM)的强大分割能力,实现零样本的植物分割。Plantnet能够提供植物区域的粗略定位,而SAM则负责对这些区域进行精细分割。

技术框架:该方法主要包含两个阶段:首先,利用Plantnet的DinoV2骨干网络提取输入图像的特征,这些特征包含了丰富的植物语义信息。然后,利用这些特征生成粗略的分割掩码,这些掩码指示了图像中可能存在的植物区域。其次,将这些粗略的掩码作为SAM的提示信息,SAM利用其强大的分割能力对掩码进行细化,最终得到精确的植物分割结果。

关键创新:该方法最重要的创新点在于利用了Plantnet这种专门的植物分类模型,将其学习到的植物知识迁移到分割任务中。与直接使用通用视觉模型相比,Plantnet能够提供更具针对性的植物特征表示,从而提高了分割的准确性。此外,该方法实现了零样本分割,无需针对特定场景进行标注。

关键设计:Plantnet的DinoV2骨干网络是关键,它提供了植物特征提取能力。SAM的使用简化了分割流程,无需训练新的分割模型。实验中,作者比较了Plantnet微调的DinoV2和原始DinoV2的性能,验证了Plantnet知识迁移的有效性。具体的参数设置和损失函数信息在论文中可能有所涉及,但摘要中未明确提及。

🖼️ 关键图片

📊 实验亮点

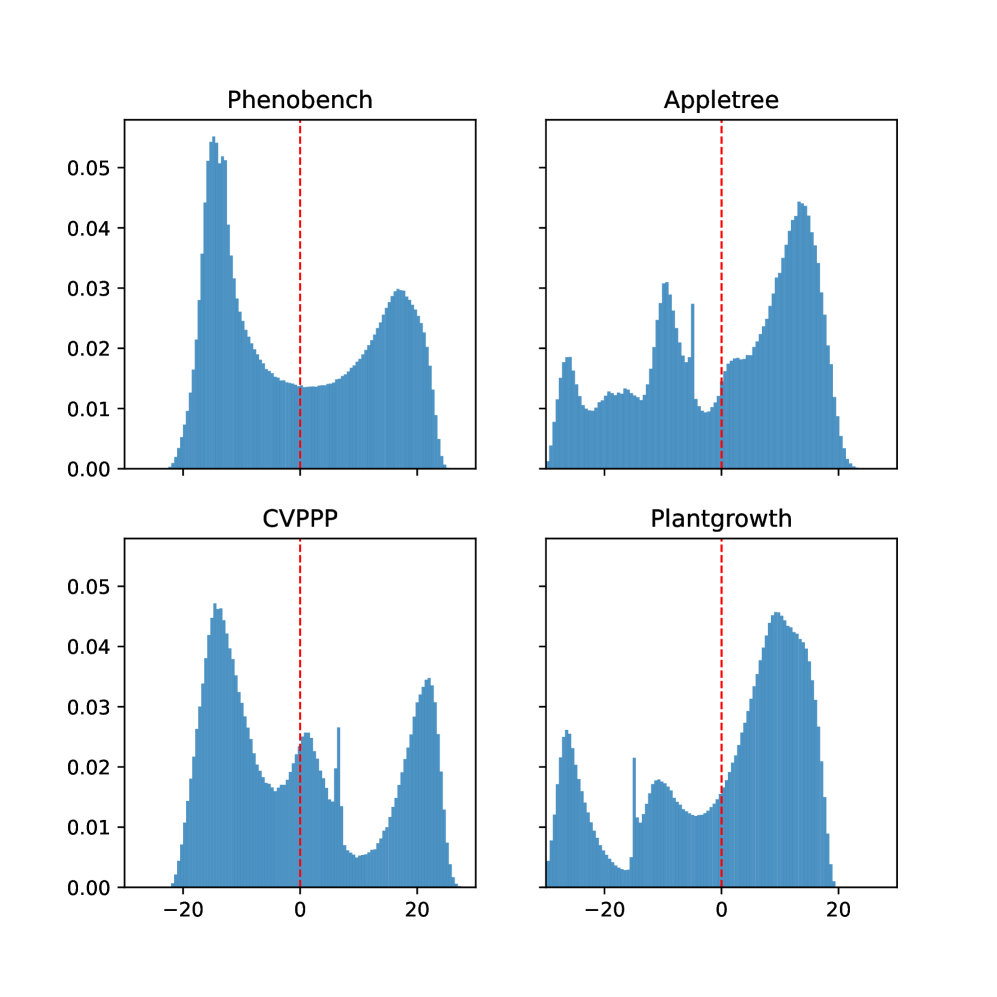

实验结果表明,使用Plantnet微调的DinoV2相比于基础DinoV2模型,在Jaccard指数(IoU)的测量下,性能得到了持续提升。这证明了Plantnet的植物知识可以有效提升零样本分割的性能。具体的IoU提升幅度在摘要中未明确给出,需要在论文中查找。

🎯 应用场景

该研究成果可广泛应用于精准农业领域,例如杂草识别、作物病虫害检测、产量估计等。通过零样本分割,可以快速部署到新的农业场景,降低人工标注成本,提高农业生产效率。未来,该方法有望与无人机、机器人等技术结合,实现智能化田间管理。

📄 摘要(原文)

We present a zero-shot segmentation approach for agricultural imagery that leverages Plantnet, a large-scale plant classification model, in conjunction with its DinoV2 backbone and the Segment Anything Model (SAM). Rather than collecting and annotating new datasets, our method exploits Plantnet's specialized plant representations to identify plant regions and produce coarse segmentation masks. These masks are then refined by SAM to yield detailed segmentations. We evaluate on four publicly available datasets of various complexity in terms of contrast including some where the limited size of the training data and complex field conditions often hinder purely supervised methods. Our results show consistent performance gains when using Plantnet-fine-tuned DinoV2 over the base DinoV2 model, as measured by the Jaccard Index (IoU). These findings highlight the potential of combining foundation models with specialized plant-centric models to alleviate the annotation bottleneck and enable effective segmentation in diverse agricultural scenarios.