Learning Human Motion with Temporally Conditional Mamba

作者: Quang Nguyen, Tri Le, Baoru Huang, Minh Nhat Vu, Ngan Le, Thieu Vo, Anh Nguyen

分类: cs.CV

发布日期: 2025-10-14

备注: 10 pages

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出时序条件Mamba模型,提升时序人体运动生成任务的对齐性和真实感。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱四:生成式动作 (Generative Motion) 支柱七:动作重定向 (Motion Retargeting) 支柱八:物理动画 (Physics-based Animation)

关键词: 人体运动生成 时序建模 Mamba 状态空间模型 条件生成 循环神经网络 深度学习

📋 核心要点

- 现有方法在时序人体运动生成中依赖交叉注意力,难以维持条件输入和运动之间的精细时序对齐。

- TCM将条件信息融入Mamba块的循环动态,从而在模型内部实现条件和运动的时序对齐。

- 实验表明,TCM在时序对齐、运动真实感和条件一致性方面显著优于现有方法。

📝 摘要(中文)

本文提出了一种名为时序条件Mamba (Temporally Conditional Mamba, TCM) 的新型模型,用于解决基于时变输入信号的人体运动生成问题。该任务旨在生成或估计能够持续反映条件输入时序模式的人体运动。现有方法通常依赖于交叉注意力机制来融合条件信息和运动信息,但这种方法主要捕获全局交互,难以维持逐步的时序对齐。TCM通过将条件信息集成到Mamba块的循环动态中,从而实现更好时序对齐的运动生成。在各种人体运动任务上的大量实验表明,与现有技术相比,该模型显著提高了时序对齐、运动真实感和条件一致性。

🔬 方法详解

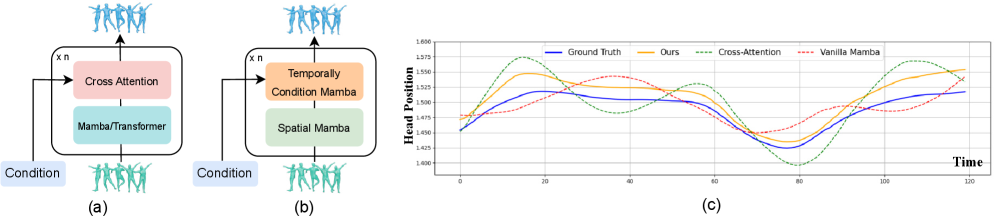

问题定义:论文旨在解决基于时序条件的人体运动生成问题。现有方法,如基于Transformer的架构,通常使用交叉注意力机制融合条件信息,但交叉注意力主要关注全局交互,难以捕捉细粒度的时序依赖关系,导致生成的运动与条件输入在时间上不对齐,运动真实感不足。

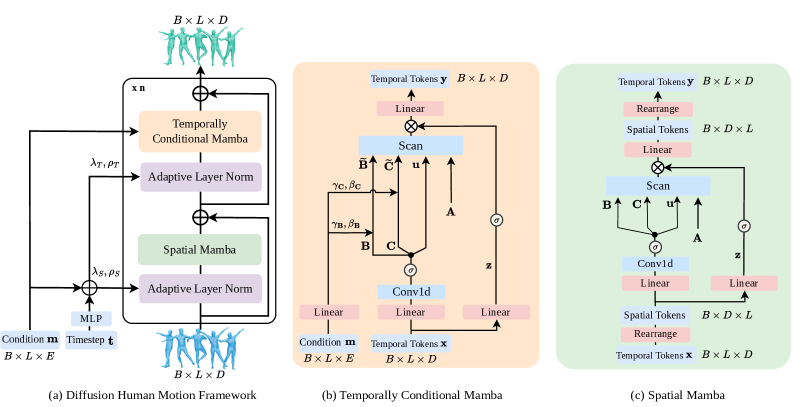

核心思路:论文的核心思路是将条件信息直接融入Mamba块的循环动态中。Mamba架构本身擅长处理时序数据,通过将条件信息嵌入到Mamba的状态空间模型中,可以使模型在生成运动的过程中,更好地感知和利用条件信息的时序变化,从而实现更精确的时序对齐。

技术框架:TCM模型基于Mamba架构,主要包含以下几个模块:1) 条件编码器:将输入的时序条件信号编码成高维特征表示。2) Mamba块:核心的时序建模模块,条件信息通过某种方式(例如,加性或乘性调制)融入到Mamba块的状态转移矩阵中。3) 运动解码器:将Mamba块输出的特征解码成人体运动序列。整个流程是:条件信号 -> 条件编码器 -> Mamba块 -> 运动解码器 -> 生成的运动序列。

关键创新:最关键的创新在于将条件信息融入到Mamba块的循环动态中。与传统的交叉注意力机制不同,这种方法不是简单地将条件信息与运动特征进行融合,而是让条件信息直接影响Mamba块的状态转移过程,从而使模型能够更好地感知和利用条件信息的时序变化。这种方法能够更有效地捕捉条件输入和运动之间的时序依赖关系,从而提高时序对齐的精度。

关键设计:具体的条件信息融合方式(例如,加性或乘性调制)是关键的设计细节。论文可能还涉及一些其他的技术细节,例如:Mamba块的具体参数设置,损失函数的设计(可能包含时序对齐损失),以及运动解码器的结构等。这些细节决定了模型的最终性能。

🖼️ 关键图片

📊 实验亮点

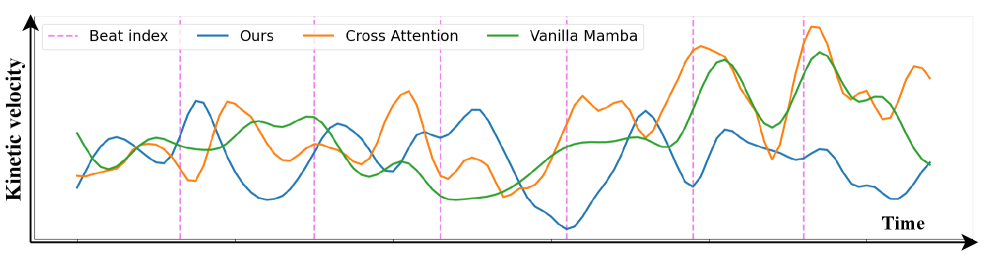

论文通过大量实验验证了TCM模型的有效性。实验结果表明,与基于Transformer的现有方法相比,TCM在时序对齐、运动真实感和条件一致性方面均有显著提升。具体的性能数据(例如,时序对齐误差、运动真实感评分等)和提升幅度需要在论文中查找。

🎯 应用场景

该研究成果可应用于虚拟现实、游戏、动画制作等领域,实现更自然、更逼真的人机交互。例如,可以根据用户的语音指令或手势,生成相应的角色动作;也可以用于康复训练,根据患者的运动数据,生成个性化的训练方案。此外,该技术还可以用于预测人体运动轨迹,为机器人导航和自动驾驶提供支持。

📄 摘要(原文)

Learning human motion based on a time-dependent input signal presents a challenging yet impactful task with various applications. The goal of this task is to generate or estimate human movement that consistently reflects the temporal patterns of conditioning inputs. Existing methods typically rely on cross-attention mechanisms to fuse the condition with motion. However, this approach primarily captures global interactions and struggles to maintain step-by-step temporal alignment. To address this limitation, we introduce Temporally Conditional Mamba, a new mamba-based model for human motion generation. Our approach integrates conditional information into the recurrent dynamics of the Mamba block, enabling better temporally aligned motion. To validate the effectiveness of our method, we evaluate it on a variety of human motion tasks. Extensive experiments demonstrate that our model significantly improves temporal alignment, motion realism, and condition consistency over state-of-the-art approaches. Our project page is available at https://zquang2202.github.io/TCM.