Hybrid Gaussian Splatting for Novel Urban View Synthesis

作者: Mohamed Omran, Farhad Zanjani, Davide Abati, Jens Petersen, Amirhossein Habibian

分类: cs.CV

发布日期: 2025-10-14

备注: ICCV 2025 RealADSim Workshop

💡 一句话要点

提出混合高斯溅射方法,用于城市街景的新视角合成

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 新视角合成 高斯溅射 扩散模型 城市街景 三维重建

📋 核心要点

- 现有新视角合成方法在复杂城市环境中面临挑战,难以生成高质量、一致性的渲染结果。

- 该论文提出了一种混合方法,结合高斯溅射进行3D重建和扩散模型进行图像增强,提升渲染质量。

- 实验结果表明,该方法在RealADSim-NVS挑战赛中取得了第二名的成绩,验证了其有效性。

📝 摘要(中文)

本文介绍了高通AI研究团队针对ICCV 2025 RealADSim Workshop中RealADSim-NVS挑战赛提出的解决方案。该挑战赛关注街景中的新视角合成,要求参赛者从训练过程中捕获的以车辆为中心的帧生成同一城市环境的渲染图,但视角来自不同的轨迹(例如,不同的街道车道或车辆方向)。我们的解决方案受到场景生成和生成模拟器中混合方法的启发,融合了高斯溅射和扩散模型,由两个阶段组成:首先,我们拟合场景的3D重建,并渲染目标相机视角下的新视图。然后,我们使用专门的单步扩散模型增强生成的帧。我们讨论了高斯基元初始化以及增强模型的微调和训练数据选择的具体方法。我们报告了我们模型设计的性能,并通过PSNR、SSIM和LPIPS等指标评估了其组件在新视角质量方面的表现。在公开排行榜上,我们的方案获得了0.432的综合得分,总体排名第二。

🔬 方法详解

问题定义:论文旨在解决城市街景中新视角合成的问题。现有方法难以在复杂的城市环境中生成高质量、真实感强的新视角图像,尤其是在视角变化较大时,容易出现模糊、失真等问题。

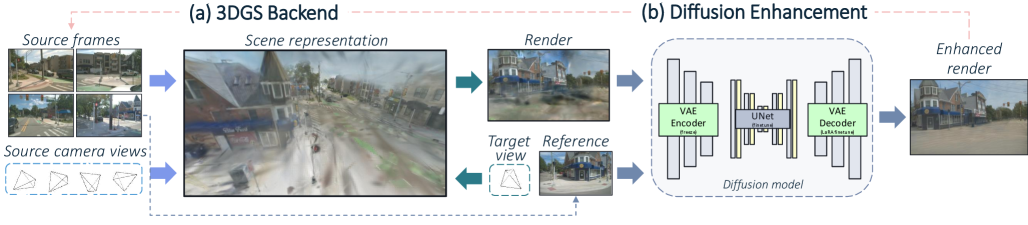

核心思路:论文的核心思路是利用高斯溅射进行场景的3D重建,然后使用扩散模型对渲染结果进行增强。高斯溅射能够高效地表示场景的几何和外观信息,而扩散模型则可以提升图像的细节和真实感。

技术框架:该方法包含两个主要阶段:1) 3D重建与新视角渲染:使用高斯溅射技术对场景进行3D重建,并从目标相机视角渲染新视图。2) 图像增强:使用单步扩散模型对渲染结果进行增强,提升图像的细节和真实感。

关键创新:该方法的关键创新在于将高斯溅射和扩散模型相结合,充分利用了两种技术的优势。高斯溅射提供了高效的3D场景表示,而扩散模型则提供了强大的图像生成能力。此外,论文还针对城市街景的特点,对高斯基元的初始化和扩散模型的训练数据进行了专门的设计。

关键设计:论文在高斯基元的初始化方面,可能采用了针对城市环境的策略,例如考虑了道路结构和建筑物分布。在扩散模型的训练数据方面,可能使用了高质量的城市街景图像,并进行了数据增强。此外,单步扩散模型的具体结构和损失函数也是关键的设计细节,但论文摘要中未明确说明。

🖼️ 关键图片

📊 实验亮点

该方法在RealADSim-NVS挑战赛中取得了第二名的成绩,综合得分为0.432。通过PSNR、SSIM和LPIPS等指标评估了新视角质量,并进行了消融实验,验证了各个组件的有效性。具体性能提升幅度未知,需要在论文全文中查找。

🎯 应用场景

该研究成果可应用于自动驾驶、虚拟现实、城市规划等领域。在自动驾驶中,可以用于生成各种视角的图像,提升感知系统的鲁棒性。在虚拟现实中,可以用于创建更加逼真的城市环境。在城市规划中,可以用于模拟不同规划方案下的城市景观。

📄 摘要(原文)

This paper describes the Qualcomm AI Research solution to the RealADSim-NVS challenge, hosted at the RealADSim Workshop at ICCV 2025. The challenge concerns novel view synthesis in street scenes, and participants are required to generate, starting from car-centric frames captured during some training traversals, renders of the same urban environment as viewed from a different traversal (e.g. different street lane or car direction). Our solution is inspired by hybrid methods in scene generation and generative simulators merging gaussian splatting and diffusion models, and it is composed of two stages: First, we fit a 3D reconstruction of the scene and render novel views as seen from the target cameras. Then, we enhance the resulting frames with a dedicated single-step diffusion model. We discuss specific choices made in the initialization of gaussian primitives as well as the finetuning of the enhancer model and its training data curation. We report the performance of our model design and we ablate its components in terms of novel view quality as measured by PSNR, SSIM and LPIPS. On the public leaderboard reporting test results, our proposal reaches an aggregated score of 0.432, achieving the second place overall.