IL3D: A Large-Scale Indoor Layout Dataset for LLM-Driven 3D Scene Generation

作者: Wenxu Zhou, Kaixuan Nie, Hang Du, Dong Yin, Wei Huang, Siqiang Guo, Xiaobo Zhang, Pengbo Hu

分类: cs.CV

发布日期: 2025-10-14

备注: 9 pages main paper; 15 pages references and appendix

💡 一句话要点

IL3D:用于LLM驱动的3D场景生成的大规模室内布局数据集

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 3D场景生成 大型语言模型 室内布局数据集 多模态学习 具身智能

📋 核心要点

- 现有3D场景生成方法缺乏多样化、高质量的室内布局数据集,限制了大型语言模型在该领域的应用。

- IL3D数据集通过提供大规模、多模态、带自然语言标注的室内布局数据,为LLM驱动的3D场景生成提供了坚实基础。

- 实验表明,在IL3D上微调LLM能显著提升场景生成的泛化能力,优于在其他数据集上的微调效果。

📝 摘要(中文)

本研究提出了IL3D,一个专为大型语言模型(LLM)驱动的3D场景生成而精心设计的大规模数据集,旨在解决室内布局设计中对多样化、高质量训练数据的迫切需求。IL3D包含27,816个室内布局,涵盖18种常见的房间类型,以及一个包含29,215个高保真3D对象资产的库。数据集还通过实例级别的自然语言标注进行了增强,以支持视觉-语言任务的鲁棒多模态学习。我们建立了严格的基准来评估LLM驱动的场景生成。实验结果表明,在IL3D上对LLM进行监督式微调(SFT)能够显著提高泛化能力,并超越在其他数据集上进行SFT的性能。IL3D提供灵活的多模态数据导出功能,包括点云、3D边界框、多视角图像、深度图、法线贴图和语义掩码,从而能够无缝适应各种视觉任务。作为一个通用且强大的资源,IL3D通过提供高保真场景数据来支持具身智能体的环境感知任务,从而显著推进了3D场景生成和具身智能领域的研究。

🔬 方法详解

问题定义:现有3D场景生成方法面临缺乏大规模、高质量、多样化的室内布局数据集的挑战。这限制了大型语言模型(LLM)在理解和生成逼真室内场景方面的能力。现有数据集可能规模较小、缺乏细粒度的标注信息(如实例级别的自然语言描述),或者在房间类型和对象种类方面不够全面。

核心思路:IL3D的核心思路是构建一个大规模、多模态的室内布局数据集,该数据集不仅包含大量的室内场景,还提供丰富的标注信息,包括实例级别的自然语言描述、3D边界框、点云、多视角图像等。通过提供这些信息,IL3D旨在促进LLM对室内场景的理解和生成,并支持各种视觉-语言任务。

技术框架:IL3D数据集的构建流程主要包括以下几个阶段:1) 收集和整理现有的3D模型资源,构建一个包含大量室内对象的高保真3D对象资产库;2) 设计和生成多样化的室内布局,涵盖多种常见的房间类型;3) 对每个室内布局进行详细的标注,包括实例级别的自然语言描述、3D边界框、点云、多视角图像、深度图、法线贴图和语义掩码等;4) 建立评估基准,用于评估LLM驱动的场景生成性能。

关键创新:IL3D的关键创新在于其大规模、多模态和细粒度的标注信息。与现有数据集相比,IL3D提供了更多的室内场景、更丰富的对象种类和更详细的标注信息,这使得LLM能够更好地理解和生成逼真的室内场景。此外,IL3D还提供了灵活的多模态数据导出功能,方便研究人员将其应用于各种视觉-语言任务。

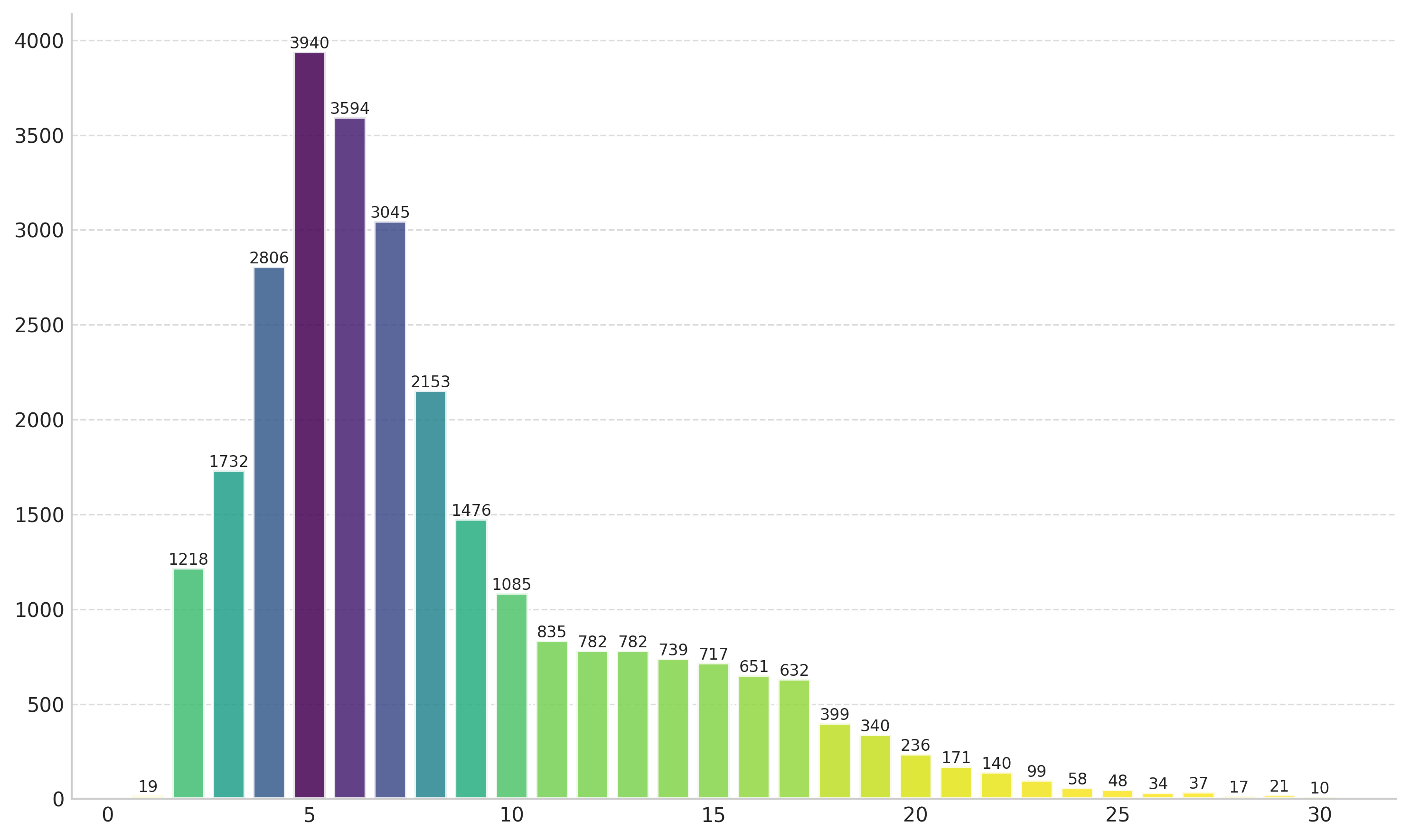

关键设计:IL3D数据集包含27,816个室内布局,涵盖18种常见的房间类型,以及一个包含29,215个高保真3D对象资产的库。每个室内布局都配备了实例级别的自然语言标注,描述了场景中的对象及其关系。数据集还提供了多种模态的数据,包括点云、3D边界框、多视角图像、深度图、法线贴图和语义掩码。为了评估LLM驱动的场景生成性能,论文作者建立了一系列评估指标,包括生成场景的逼真度、多样性和与自然语言描述的一致性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在IL3D数据集上对LLM进行监督式微调(SFT)能够显著提高场景生成的泛化能力,并超越在其他数据集上进行SFT的性能。这表明IL3D数据集能够有效地促进LLM对室内场景的理解和生成,并为3D场景生成领域的研究提供了有力的支持。

🎯 应用场景

IL3D数据集在3D场景生成、具身智能、机器人导航、虚拟现实和增强现实等领域具有广泛的应用前景。它可以用于训练LLM生成逼真的室内场景,为机器人提供环境感知能力,帮助它们在室内环境中进行导航和交互。此外,IL3D还可以用于创建虚拟现实和增强现实体验,例如虚拟家居设计和游戏场景。

📄 摘要(原文)

In this study, we present IL3D, a large-scale dataset meticulously designed for large language model (LLM)-driven 3D scene generation, addressing the pressing demand for diverse, high-quality training data in indoor layout design. Comprising 27,816 indoor layouts across 18 prevalent room types and a library of 29,215 high-fidelity 3D object assets, IL3D is enriched with instance-level natural language annotations to support robust multimodal learning for vision-language tasks. We establish rigorous benchmarks to evaluate LLM-driven scene generation. Experimental results show that supervised fine-tuning (SFT) of LLMs on IL3D significantly improves generalization and surpasses the performance of SFT on other datasets. IL3D offers flexible multimodal data export capabilities, including point clouds, 3D bounding boxes, multiview images, depth maps, normal maps, and semantic masks, enabling seamless adaptation to various visual tasks. As a versatile and robust resource, IL3D significantly advances research in 3D scene generation and embodied intelligence, by providing high-fidelity scene data to support environment perception tasks of embodied agents.