CodePlot-CoT: Mathematical Visual Reasoning by Thinking with Code-Driven Images

作者: Chengqi Duan, Kaiyue Sun, Rongyao Fang, Manyuan Zhang, Yan Feng, Ying Luo, Yufang Liu, Ke Wang, Peng Pei, Xunliang Cai, Hongsheng Li, Yi Ma, Xihui Liu

分类: cs.CV, cs.AI

发布日期: 2025-10-13

🔗 代码/项目: GITHUB

💡 一句话要点

提出CodePlot-CoT,通过代码驱动图像的思维链解决数学视觉推理难题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 数学推理 视觉推理 代码生成 视觉语言模型 思维链 多模态学习 数据集 图像到代码

📋 核心要点

- 现有大型语言模型(LLM)和视觉语言模型(VLM)在数学推理中面临视觉辅助难题,如绘制辅助线或函数图像。

- CodePlot-CoT利用VLM生成文本推理和绘图代码,将代码渲染为图像作为视觉辅助,实现“用图像思考”的数学问题求解。

- 在Math-VR数据集上,CodePlot-CoT相比基线模型性能提升高达21%,验证了代码驱动推理范式的有效性。

📝 摘要(中文)

本文提出CodePlot-CoT,一种代码驱动的思维链范式,用于在数学问题中“用图像思考”。该方法利用视觉语言模型(VLM)生成文本推理和可执行的绘图代码,并将代码渲染成图像作为“视觉思维”,从而解决数学问题。为此,构建了首个大规模双语数学视觉推理数据集和基准Math-VR,包含17.8万个样本。开发了最先进的图像到代码转换器,专门用于将复杂的数学图形解析为代码,以创建高质量的训练数据。最后,使用这些数据训练CodePlot-CoT模型来解决数学问题。实验结果表明,该模型在新基准测试中比基线模型提高了高达21%,充分验证了所提出的代码驱动推理范式的有效性。该工作为多模态数学推理开辟了新方向,并为社区提供了首个大规模数据集、综合基准和强大的方法。

🔬 方法详解

问题定义:现有的大型语言模型和视觉语言模型在解决需要视觉辅助的数学问题时存在瓶颈。例如,一些几何问题需要绘制辅助线,或者需要绘制函数图像才能更好地理解和解决问题。现有的模型要么只能进行文本推理,要么缺乏生成精确可控图像的能力,无法有效地利用视觉信息辅助数学推理。

核心思路:CodePlot-CoT的核心思路是利用视觉语言模型生成可执行的绘图代码,并将这些代码渲染成图像,作为模型进行数学推理的“视觉思维”。通过这种方式,模型可以像人类一样,通过绘制图像来辅助理解和解决问题。这种方法将文本推理和视觉信息结合起来,从而提高了模型解决复杂数学问题的能力。

技术框架:CodePlot-CoT的整体框架包括以下几个主要模块:1) 视觉语言模型(VLM):用于生成文本推理和绘图代码。2) 代码渲染器:将生成的绘图代码渲染成图像。3) 数学问题求解器:利用文本推理和图像信息来解决数学问题。整个流程是,首先VLM接收数学问题作为输入,生成包含文本推理步骤和绘图代码的输出。然后,代码渲染器将绘图代码渲染成图像。最后,数学问题求解器结合文本推理步骤和图像信息,给出最终的答案。

关键创新:CodePlot-CoT的关键创新在于提出了代码驱动的思维链范式,将视觉信息融入到数学推理过程中。与传统的文本推理方法相比,CodePlot-CoT能够利用图像信息来辅助理解和解决问题,从而提高了模型的性能。此外,该论文还构建了首个大规模双语数学视觉推理数据集Math-VR,为该领域的研究提供了宝贵的数据资源。

关键设计:在训练CodePlot-CoT模型时,使用了高质量的图像到代码转换器来生成训练数据。该转换器能够将复杂的数学图形解析为代码,从而保证了训练数据的质量。此外,论文还设计了一种特殊的损失函数,用于优化VLM生成的绘图代码的准确性。具体的网络结构和参数设置在论文中有详细描述,可以参考原文。

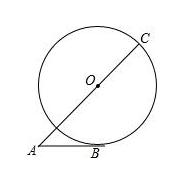

🖼️ 关键图片

📊 实验亮点

CodePlot-CoT在Math-VR数据集上取得了显著的性能提升,相比基线模型提高了高达21%。这一结果充分验证了代码驱动的思维链范式的有效性。此外,该论文还构建了首个大规模双语数学视觉推理数据集Math-VR,为该领域的研究提供了宝贵的数据资源和基准。

🎯 应用场景

CodePlot-CoT在教育领域具有广泛的应用前景,可以用于开发智能辅导系统,帮助学生更好地理解和解决数学问题。此外,该技术还可以应用于科学研究、工程设计等领域,辅助专业人员进行复杂的数学建模和分析。未来,该技术有望进一步发展,实现更高级的视觉推理能力,为各行各业带来更大的价值。

📄 摘要(原文)

Recent advances in Large Language Models (LLMs) and Vision Language Models (VLMs) have shown significant progress in mathematical reasoning, yet they still face a critical bottleneck with problems requiring visual assistance, such as drawing auxiliary lines or plotting functions to solve the problems. Most LLMs and VLMs are constrained to text-only reasoning chains, while multimodal unified models that can generate interleaved text and images lack the necessary precision and controllability for such tasks. To address this, we propose CodePlot-CoT, a code-driven Chain-of-Thought paradigm for "thinking with images" in mathematics. Our approach leverages the VLM to generate text reasoning as well as executable plotting code, which is then rendered into images as "visual thought", to solve mathematical problems. To achieve this, we first construct Math-VR, the first large-scale, bilingual dataset and benchmark for Mathematics problems with Visual Reasoning, comprising 178K samples. Second, to create high-quality training data, we develop a state-of-the-art image-to-code converter specialized for parsing complex mathematical figures into codes. Finally, using these training data, we train the CodePlot-CoT model for solving mathematical problems. Experimental results show that our model achieves up to 21% increase over base model on our new benchmark, fully validating the efficacy of our proposed code-driven reasoning paradigm. Our work opens a new direction for multimodal mathematical reasoning and provides the community with the first large-scale dataset, comprehensive benchmark, and strong approach for such problems. To facilitate future research, we make our datasets, code, and pretrained models publicly available at https://github.com/HKU-MMLab/Math-VR-CodePlot-CoT.