A Framework for Low-Effort Training Data Generation for Urban Semantic Segmentation

作者: Denis Zavadski, Damjan Kalšan, Tim Küchler, Haebom Lee, Stefan Roth, Carsten Rother

分类: cs.CV, cs.GR, cs.LG

发布日期: 2025-10-13

💡 一句话要点

提出一种低成本训练数据生成框架,利用扩散模型提升城市语义分割性能。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 城市语义分割 合成数据生成 扩散模型 领域自适应 低成本训练数据

📋 核心要点

- 现有方法在利用合成数据训练城市场景识别模型时,存在与真实图像的差距,尤其是在特定目标领域。

- 该框架利用扩散模型,通过不完善的伪标签将合成数据适配到目标领域,生成高质量、目标对齐的训练图像。

- 实验结果表明,该方法在多个数据集上显著提升了语义分割性能,使低成本合成数据与高成本数据效果相当。

📝 摘要(中文)

本文提出了一种新框架,通过利用不完善的伪标签,将现成的扩散模型适配到目标领域,从而为城市语义分割生成低成本的训练数据。该框架能够从任何合成数据集(包括快速构建的低成本数据集)的语义地图生成高保真、目标对齐的图像。该方法过滤次优生成结果,校正图像-标签错位,并标准化跨数据集的语义。实验表明,在五个合成数据集和两个真实目标数据集上,该方法相比最先进的转换方法,语义分割性能提升高达 +8.0%pt mIoU。这使得快速构建的合成数据集与需要大量人工设计的高成本合成数据集一样有效。这项工作强调了一种有价值的协作模式,即快速语义原型设计与生成模型相结合,能够为城市场景理解实现可扩展、高质量的训练数据创建。

🔬 方法详解

问题定义:现有方法在利用合成数据集训练城市语义分割模型时,即使是高度逼真的渲染也与真实图像存在明显的差距。这种差距在适应特定目标领域(如Cityscapes)时尤为突出,因为架构、植被、物体外观和相机特性方面的差异会限制下游性能。更详细的3D建模虽然可以缩小差距,但需要昂贵的资产和场景设计,这与低成本标记数据的目的相悖。

核心思路:本文的核心思路是利用扩散模型,将低成本生成的合成数据转换成高质量、目标领域对齐的训练数据。通过将现成的扩散模型适配到目标领域,可以有效地弥合合成数据和真实数据之间的差距,而无需进行昂贵的3D建模和人工设计。

技术框架:该框架包含以下主要模块:1) 利用现成的扩散模型,并使用目标领域的伪标签进行训练,使其能够生成目标领域风格的图像;2) 过滤次优的生成结果,例如通过置信度评分或对抗性判别器;3) 校正图像-标签的错位,例如通过图像配准或语义一致性约束;4) 标准化跨数据集的语义,例如通过语义映射或类别对齐。整体流程是从低成本合成数据集的语义地图开始,经过上述模块的处理,最终生成高质量的、可用于训练语义分割模型的图像。

关键创新:该方法最重要的创新点在于利用扩散模型进行领域自适应,从而能够从低成本的合成数据生成高质量的训练数据。与传统的图像转换方法相比,扩散模型能够生成更逼真、更符合目标领域风格的图像,从而显著提升语义分割性能。此外,该框架还集成了过滤、校正和标准化等模块,进一步提高了生成数据的质量和可用性。

关键设计:扩散模型的具体架构和训练方式是关键设计之一。例如,可以使用条件扩散模型,将语义地图作为条件输入,控制生成图像的语义内容。损失函数可以包括重建损失、对抗损失和语义一致性损失等。此外,过滤模块的设计也很重要,需要选择合适的指标来评估生成图像的质量,并设置合理的阈值来过滤次优结果。图像-标签错位的校正方法也需要根据具体情况进行选择,例如可以使用基于特征的图像配准方法或基于深度学习的语义分割模型。

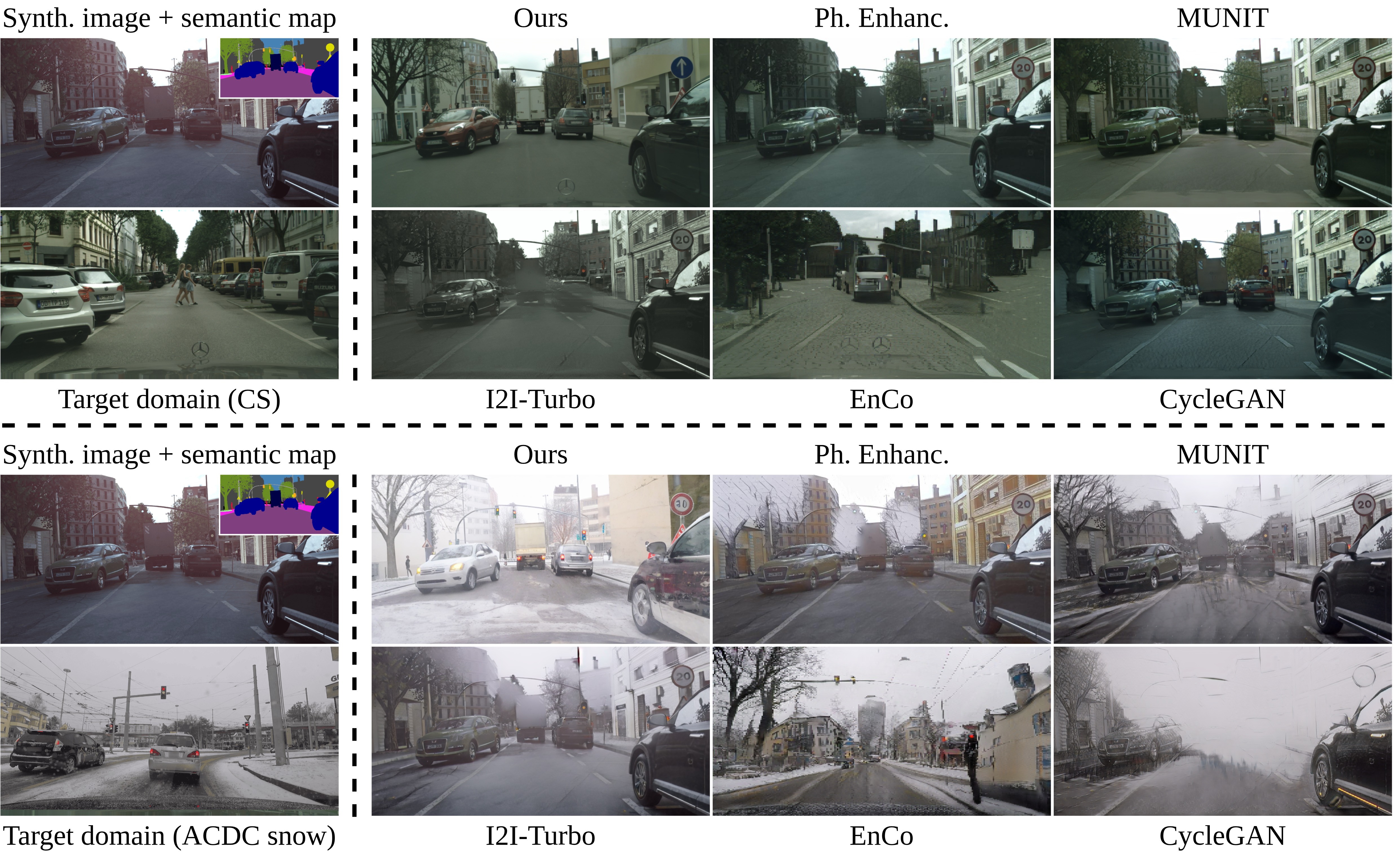

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在五个合成数据集和两个真实目标数据集上,相比最先进的图像转换方法,语义分割性能提升高达 +8.0%pt mIoU。这表明,通过该框架,快速构建的低成本合成数据集可以达到甚至超过需要大量人工设计的高成本合成数据集的效果,显著降低了训练数据的获取成本。

🎯 应用场景

该研究成果可广泛应用于城市环境下的自动驾驶、智能交通、城市规划等领域。通过低成本生成高质量的训练数据,可以降低模型训练的成本和时间,加速相关技术的研发和部署。此外,该方法还可以应用于其他需要大量标注数据的场景,例如遥感图像分析、医学图像诊断等。

📄 摘要(原文)

Synthetic datasets are widely used for training urban scene recognition models, but even highly realistic renderings show a noticeable gap to real imagery. This gap is particularly pronounced when adapting to a specific target domain, such as Cityscapes, where differences in architecture, vegetation, object appearance, and camera characteristics limit downstream performance. Closing this gap with more detailed 3D modelling would require expensive asset and scene design, defeating the purpose of low-cost labelled data. To address this, we present a new framework that adapts an off-the-shelf diffusion model to a target domain using only imperfect pseudo-labels. Once trained, it generates high-fidelity, target-aligned images from semantic maps of any synthetic dataset, including low-effort sources created in hours rather than months. The method filters suboptimal generations, rectifies image-label misalignments, and standardises semantics across datasets, transforming weak synthetic data into competitive real-domain training sets. Experiments on five synthetic datasets and two real target datasets show segmentation gains of up to +8.0%pt. mIoU over state-of-the-art translation methods, making rapidly constructed synthetic datasets as effective as high-effort, time-intensive synthetic datasets requiring extensive manual design. This work highlights a valuable collaborative paradigm where fast semantic prototyping, combined with generative models, enables scalable, high-quality training data creation for urban scene understanding.