VA-GS: Enhancing the Geometric Representation of Gaussian Splatting via View Alignment

作者: Qing Li, Huifang Feng, Xun Gong, Yu-Shen Liu

分类: cs.CV

发布日期: 2025-10-13 (更新: 2025-11-26)

备注: Accepted by NeurIPS 2025

🔗 代码/项目: GITHUB

💡 一句话要点

VA-GS:通过视角对齐增强高斯溅射的几何表示,提升表面重建精度。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱七:动作重定向 (Motion Retargeting)

关键词: 3D高斯溅射 视角对齐 表面重建 新视角合成 几何一致性 光度对齐 边缘感知

📋 核心要点

- 3D高斯溅射在高质量实时新视角合成中表现出色,但其精确表面重建能力仍有待探索,图像渲染损失的监督易导致几何不准确。

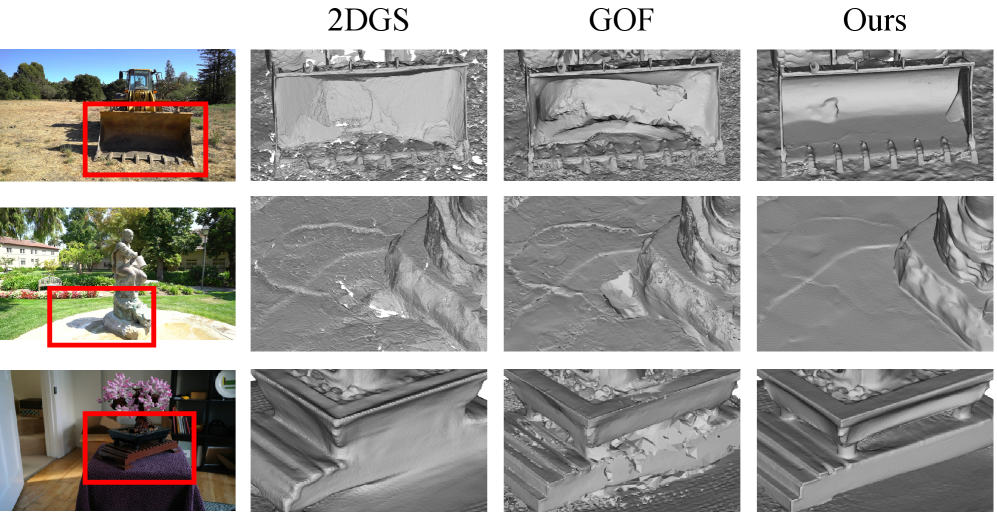

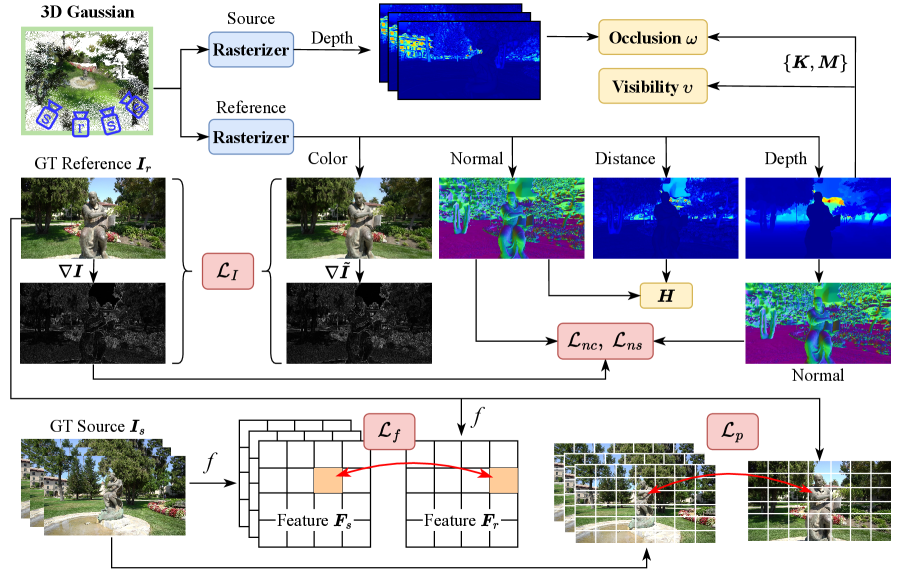

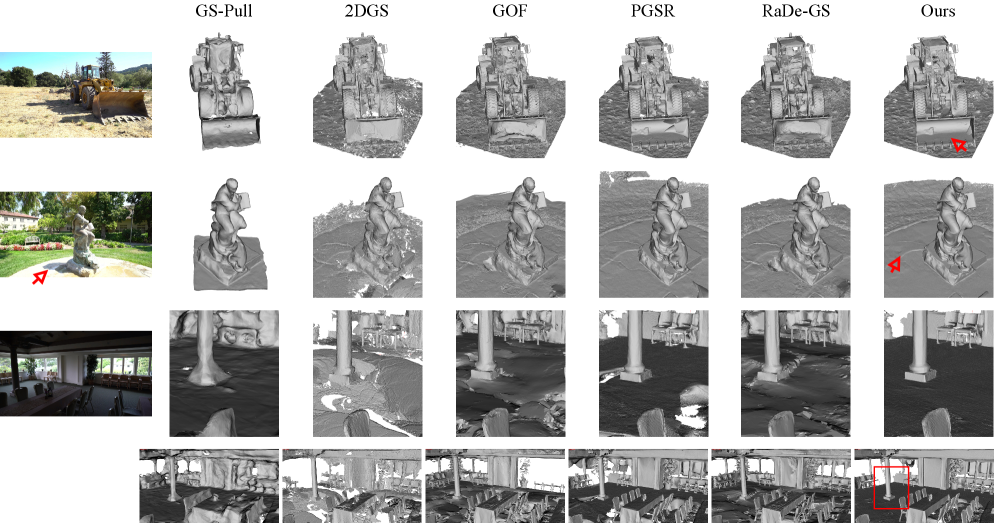

- 提出视角对齐(VA)方法,通过边缘感知图像线索、可见性感知光度对齐损失和法线约束,增强高斯几何表示。

- 实验结果表明,该方法在表面重建和新视角合成方面均达到了最先进的水平,显著提升了几何重建的准确性。

📝 摘要(中文)

本文提出了一种新方法,通过视角对齐(VA)来增强3D高斯溅射的几何表示。针对现有方法仅依赖图像渲染损失导致几何不准确和多视角对齐不一致的问题,本文引入了边缘感知图像线索到渲染损失中,以改善表面边界的描绘。为了增强跨视角的几何一致性,引入了可见性感知的光度对齐损失,该损失模拟遮挡并鼓励高斯之间的精确空间关系。为了进一步减轻光照变化引起的歧义,本文结合了基于法线的约束来细化高斯的空间方向并改善局部表面估计。此外,利用深度图像特征嵌入来增强跨视角一致性,从而提高学习到的几何体在不同视角和光照下的鲁棒性。在标准基准上的大量实验表明,该方法在表面重建和新视角合成方面均实现了最先进的性能。

🔬 方法详解

问题定义:现有3D高斯溅射方法在表面重建方面存在不足,主要原因是仅依赖图像渲染损失进行监督,导致几何形状不准确,且多视角之间的一致性较差。离散且非结构化的3D高斯表示使得准确的几何建模成为挑战。

核心思路:论文的核心思路是通过引入视角对齐(View Alignment)来增强3D高斯溅射的几何表示。具体而言,通过结合边缘感知图像线索、可见性感知的光度对齐损失以及法线约束,来提高表面边界的清晰度、保证跨视角的几何一致性,并减轻光照变化的影响。

技术框架:该方法主要包含以下几个关键模块:1) 边缘感知渲染损失:利用边缘信息来改善表面边界的描绘。2) 可见性感知光度对齐损失:通过建模遮挡关系,鼓励高斯之间的精确空间关系,从而保证跨视角的几何一致性。3) 法线约束:利用法线信息来细化高斯的空间方向,改善局部表面估计。4) 深度图像特征嵌入:利用深度图像特征嵌入来增强跨视角一致性,提高几何体在不同视角和光照下的鲁棒性。

关键创新:该方法最重要的创新点在于将视角对齐的概念引入到3D高斯溅射中,通过多种视角一致性约束来增强几何表示。与现有方法仅依赖图像渲染损失不同,该方法显式地考虑了跨视角的几何一致性,从而提高了表面重建的准确性。

关键设计:1) 边缘感知渲染损失:具体实现方式未知。2) 可见性感知光度对齐损失:通过建模高斯之间的遮挡关系,设计损失函数来鼓励可见高斯之间的光度一致性。3) 法线约束:通过计算高斯表面的法线,并设计损失函数来约束法线的方向,从而提高局部表面估计的准确性。4) 深度图像特征嵌入:使用预训练的深度学习模型提取图像特征,并设计损失函数来鼓励跨视角的特征一致性。

🖼️ 关键图片

📊 实验亮点

该方法在标准benchmark上进行了大量实验,结果表明在表面重建和新视角合成方面均取得了state-of-the-art的性能。具体性能数据和对比基线未知,但论文强调了该方法在几何重建精度和跨视角一致性方面的显著提升。

🎯 应用场景

该研究成果可应用于三维重建、虚拟现实、增强现实、自动驾驶等领域。通过提高三维场景的几何重建精度,可以为这些应用提供更准确、更可靠的三维环境信息,从而提升用户体验和系统性能。未来,该方法有望在机器人导航、场景理解等领域发挥重要作用。

📄 摘要(原文)

3D Gaussian Splatting has recently emerged as an efficient solution for high-quality and real-time novel view synthesis. However, its capability for accurate surface reconstruction remains underexplored. Due to the discrete and unstructured nature of Gaussians, supervision based solely on image rendering loss often leads to inaccurate geometry and inconsistent multi-view alignment. In this work, we propose a novel method that enhances the geometric representation of 3D Gaussians through view alignment (VA). Specifically, we incorporate edge-aware image cues into the rendering loss to improve surface boundary delineation. To enforce geometric consistency across views, we introduce a visibility-aware photometric alignment loss that models occlusions and encourages accurate spatial relationships among Gaussians. To further mitigate ambiguities caused by lighting variations, we incorporate normal-based constraints to refine the spatial orientation of Gaussians and improve local surface estimation. Additionally, we leverage deep image feature embeddings to enforce cross-view consistency, enhancing the robustness of the learned geometry under varying viewpoints and illumination. Extensive experiments on standard benchmarks demonstrate that our method achieves state-of-the-art performance in both surface reconstruction and novel view synthesis. The source code is available at https://github.com/LeoQLi/VA-GS.