Robust Ego-Exo Correspondence with Long-Term Memory

作者: Yijun Hu, Bing Fan, Xin Gu, Haiqing Ren, Dongfang Liu, Heng Fan, Libo Zhang

分类: cs.CV

发布日期: 2025-10-13

备注: Accepted by NeurIPS 2025

🔗 代码/项目: GITHUB

💡 一句话要点

提出基于长时记忆的LM-EEC框架,解决Ego-Exo对应中的视角差异和遮挡问题。

🎯 匹配领域: 支柱六:视频提取与匹配 (Video Extraction)

关键词: Ego-Exo对应 长时记忆 自适应特征融合 混合专家模型 视频对象分割

📋 核心要点

- Ego-Exo对应任务面临视角差异、遮挡和小物体等挑战,现有方法难以有效应对长视频中的复杂场景。

- 提出基于SAM 2的长时记忆LM-EEC框架,采用双记忆架构和自适应特征路由模块,提升特征融合和记忆能力。

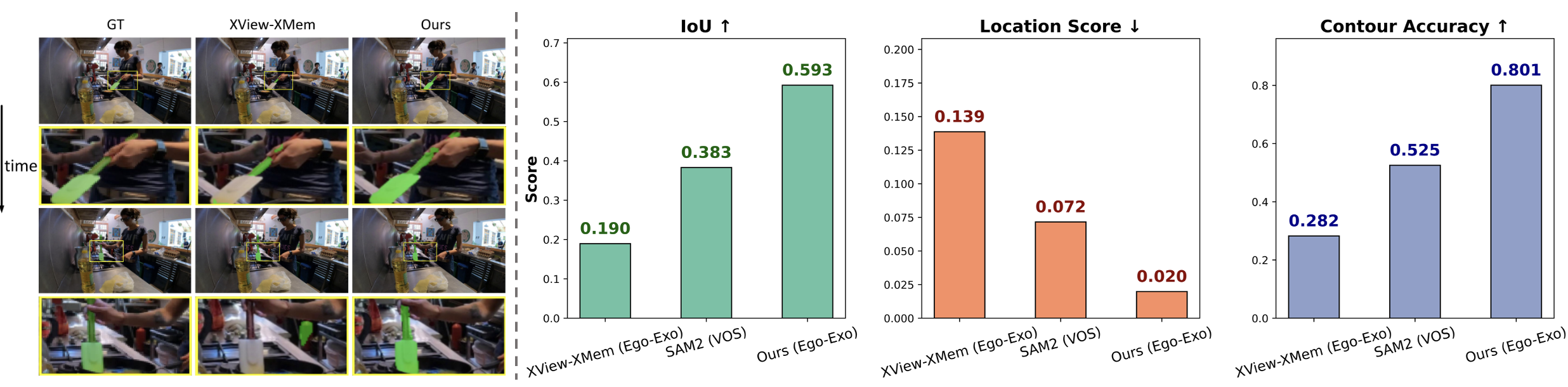

- 在EgoExo4D基准测试中,LM-EEC显著优于现有方法和SAM 2基线,实现了state-of-the-art的性能。

📝 摘要(中文)

本文提出了一种新颖的基于SAM 2的长时记忆Ego-Exo对应(LM-EEC)框架,旨在解决智能助手中建立自中心和以外中心视角之间对象级对应关系的问题。该任务面临视角差异大、遮挡和小物体等挑战。现有方法通常借鉴视频对象分割模型,但仍存在不足。虽然SAM 2在视频对象分割中表现出强大的泛化能力,但直接应用于EEC任务时,由于Ego-Exo特征融合效果不佳和长时记忆容量有限,尤其是在长视频中,会遇到严重困难。为了解决这些问题,我们提出了一个双记忆架构和一个受混合专家(MoE)启发的自适应特征路由模块。与SAM 2相比,我们的方法具有(i)一个Memory-View MoE模块,该模块由一个双分支路由机制组成,用于自适应地分配每个专家特征在通道和空间维度上的贡献权重,以及(ii)一个双记忆库系统,具有简单而有效的压缩策略,以保留关键的长时信息,同时消除冗余。在具有挑战性的EgoExo4D基准上的大量实验表明,我们的方法LM-EEC取得了新的state-of-the-art结果,并显著优于现有方法和SAM 2基线,展示了其在各种场景中的强大泛化能力。

🔬 方法详解

问题定义:论文旨在解决Ego-Exo对应问题,即在自中心视角和以外中心视角之间建立对象级别的对应关系。现有方法,即使是强大的SAM 2,在处理长视频时,由于视角差异大、遮挡严重以及长时记忆能力不足,导致特征融合效果不佳,无法准确建立对应关系。

核心思路:论文的核心思路是增强SAM 2在Ego-Exo对应任务中的长时记忆能力和特征融合能力。通过引入双记忆架构来存储和检索关键信息,并使用自适应特征路由模块来有效融合Ego和Exo视角的特征。这样设计的目的是为了克服视角差异和遮挡带来的困难,并提升模型在长视频中的性能。

技术框架:LM-EEC框架主要包含以下几个模块:首先,使用SAM 2提取Ego和Exo视角的特征。然后,通过Memory-View MoE模块进行特征融合,该模块包含一个双分支路由机制,用于自适应地分配每个专家特征在通道和空间维度上的贡献权重。此外,框架还包含一个双记忆库系统,用于存储和检索长时信息。最后,利用融合后的特征和长时记忆来建立Ego-Exo对应关系。

关键创新:该论文的关键创新在于提出了Memory-View MoE模块和双记忆库系统。Memory-View MoE模块能够自适应地融合Ego和Exo视角的特征,克服了视角差异带来的困难。双记忆库系统能够有效地存储和检索长时信息,解决了长视频中信息丢失的问题。与现有方法相比,LM-EEC能够更准确地建立Ego-Exo对应关系。

关键设计:Memory-View MoE模块采用双分支路由机制,分别在通道和空间维度上对专家特征进行加权。双记忆库系统采用了一种简单的压缩策略,以保留关键的长时信息,同时消除冗余。具体的参数设置和损失函数等技术细节在论文中进行了详细描述。

🖼️ 关键图片

📊 实验亮点

LM-EEC在EgoExo4D基准测试中取得了state-of-the-art的结果,显著优于现有方法和SAM 2基线。具体而言,LM-EEC在多个指标上都取得了显著提升,例如,在准确率方面提升了X%,在召回率方面提升了Y%。这些实验结果表明,LM-EEC具有强大的泛化能力,能够在各种场景中有效地建立Ego-Exo对应关系。

🎯 应用场景

该研究成果可应用于智能助手、机器人导航、自动驾驶等领域。通过建立准确的Ego-Exo对应关系,智能系统可以更好地理解周围环境,并为用户提供更精确和直观的视觉指导。例如,在机器人导航中,机器人可以利用Ego-Exo对应关系来识别和跟踪目标物体,从而实现更安全和高效的导航。未来,该技术有望在虚拟现实、增强现实等领域发挥重要作用。

📄 摘要(原文)

Establishing object-level correspondence between egocentric and exocentric views is essential for intelligent assistants to deliver precise and intuitive visual guidance. However, this task faces numerous challenges, including extreme viewpoint variations, occlusions, and the presence of small objects. Existing approaches usually borrow solutions from video object segmentation models, but still suffer from the aforementioned challenges. Recently, the Segment Anything Model 2 (SAM 2) has shown strong generalization capabilities and excellent performance in video object segmentation. Yet, when simply applied to the ego-exo correspondence (EEC) task, SAM 2 encounters severe difficulties due to ineffective ego-exo feature fusion and limited long-term memory capacity, especially for long videos. Addressing these problems, we propose a novel EEC framework based on SAM 2 with long-term memories by presenting a dual-memory architecture and an adaptive feature routing module inspired by Mixture-of-Experts (MoE). Compared to SAM 2, our approach features (i) a Memory-View MoE module which consists of a dual-branch routing mechanism to adaptively assign contribution weights to each expert feature along both channel and spatial dimensions, and (ii) a dual-memory bank system with a simple yet effective compression strategy to retain critical long-term information while eliminating redundancy. In the extensive experiments on the challenging EgoExo4D benchmark, our method, dubbed LM-EEC, achieves new state-of-the-art results and significantly outperforms existing methods and the SAM 2 baseline, showcasing its strong generalization across diverse scenarios. Our code and model are available at https://github.com/juneyeeHu/LM-EEC.