G2L:From Giga-Scale to Cancer-Specific Large-Scale Pathology Foundation Models via Knowledge Distillation

作者: Yesung Cho, Sungmin Lee, Geongyu Lee, Minkyung Lee, Jongbae Park, Dongmyung Shin

分类: cs.CV, cs.AI

发布日期: 2025-10-13 (更新: 2026-01-05)

备注: Accepted in AAAI 2026 workshop in Health Intelligence Special Theme on Foundation Models and AI Agents

💡 一句话要点

提出G2L框架,通过知识蒸馏将千亿级病理模型能力迁移至百亿级模型,实现癌症特异性任务的性能提升。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 病理学 基础模型 知识蒸馏 癌症诊断 迁移学习

📋 核心要点

- 现有病理学基础模型依赖于千亿级参数和海量数据,计算成本高昂,难以实际部署和应用。

- G2L框架通过知识蒸馏,将千亿级模型的知识迁移到参数量更小的大型模型,降低计算负担。

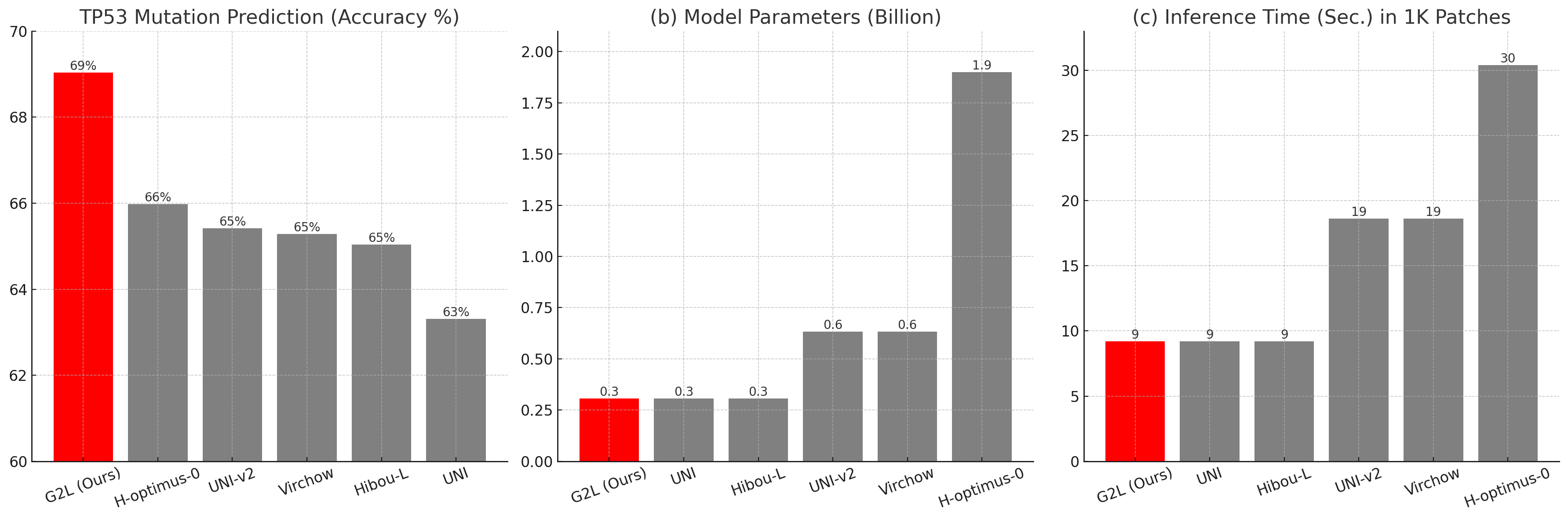

- 实验表明,G2L框架不仅超越了同等规模模型,甚至在部分任务上超过了千亿级教师模型,并提升了模型鲁棒性。

📝 摘要(中文)

病理学基础模型的研究表明,扩大训练数据规模、多样化癌症类型和增加模型大小可以持续提高性能。然而,千亿级基础模型在数十种癌症类型的大量病理切片上训练,包含数十亿参数,这给开发和部署带来了巨大的计算成本挑战。本文提出了一种名为G2L框架的新策略,旨在将大型基础模型(参数量仅为千亿级模型的15%)的性能提升到与千亿级模型在癌症特异性任务中相当的水平。该方法采用知识蒸馏,仅使用目标癌症(如乳腺癌、前列腺癌等)的1K张病理切片,将千亿级模型的能力迁移到大型模型。实验结果表明,蒸馏后的模型不仅在多个基准测试中优于同等规模(即大型)的先进模型,而且在某些基准测试中超过了千亿级教师模型和超大型模型。此外,蒸馏模型表现出更高的鲁棒性指标,表明其对来自多个机构的图像变异具有更强的适应性。这些发现表明,所提出的针对大型模型的蒸馏方法是一种数据和参数高效的方式,可以在没有过高计算负担的情况下,实现千亿级水平的癌症特异性应用性能。

🔬 方法详解

问题定义:论文旨在解决千亿级病理学基础模型计算成本高昂,难以在癌症特异性任务中实际部署的问题。现有方法虽然可以通过扩大模型规模和数据量来提升性能,但同时也带来了巨大的计算负担,限制了其应用范围。

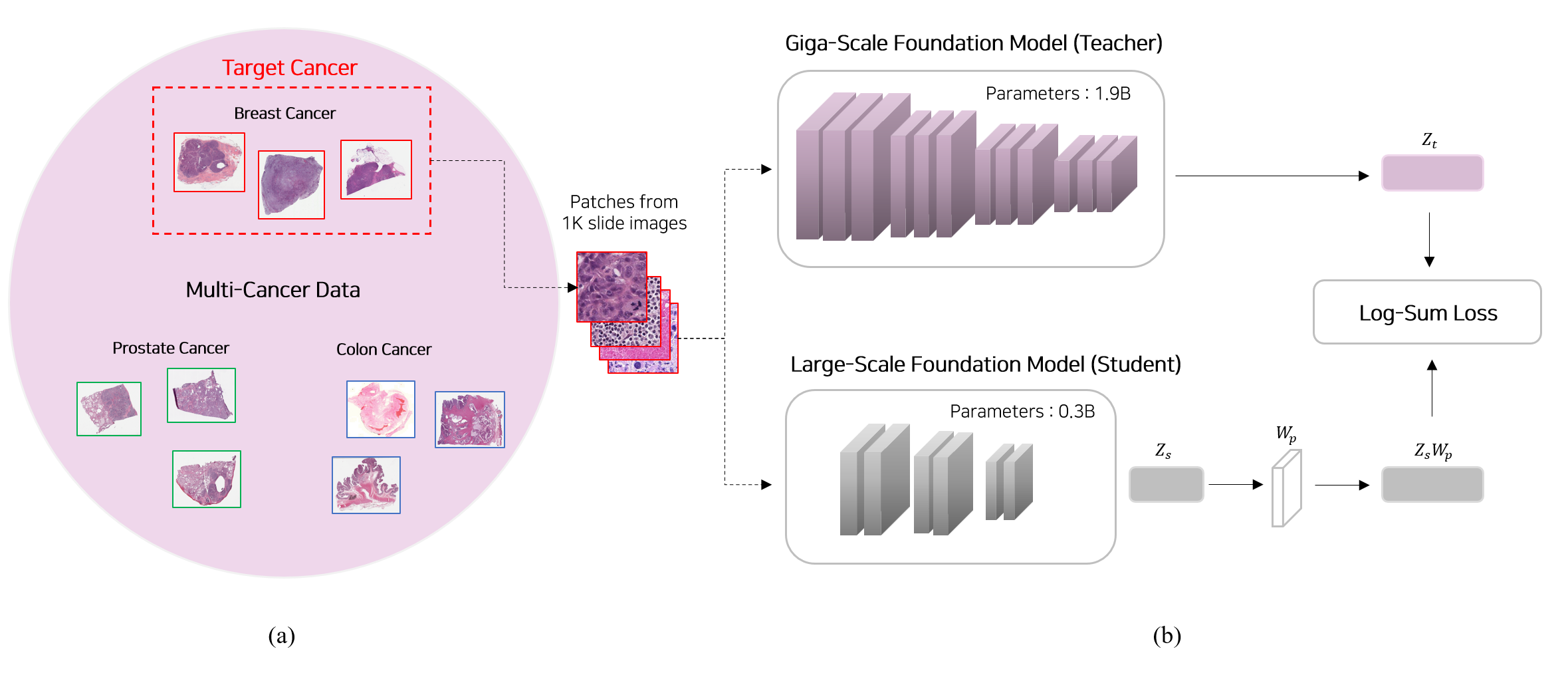

核心思路:论文的核心思路是利用知识蒸馏,将千亿级(Giga-scale)教师模型的知识迁移到大型(Large-scale)学生模型。通过这种方式,学生模型可以在参数量较小的情况下,获得与教师模型相当甚至更好的性能,从而降低计算成本。这样设计的目的是为了在保持性能的同时,提高模型的可部署性和实用性。

技术框架:G2L框架主要包含两个阶段:1) 预训练阶段:首先训练一个千亿级的大型病理学基础模型作为教师模型。2) 知识蒸馏阶段:使用少量(例如1K)目标癌症类型的病理切片,利用教师模型指导大型学生模型的训练。学生模型通过学习教师模型的输出,从而获得其知识和能力。

关键创新:该论文的关键创新在于提出了G2L框架,并将其应用于病理学领域。该框架通过知识蒸馏,有效地将千亿级模型的知识迁移到大型模型,实现了在癌症特异性任务中性能的提升,同时显著降低了计算成本。与直接训练大型模型相比,G2L框架更加高效和实用。

关键设计:在知识蒸馏阶段,论文可能采用了多种损失函数,例如KL散度损失,用于衡量学生模型和教师模型输出之间的差异。此外,论文可能还探索了不同的网络结构和参数设置,以优化学生模型的性能。具体的网络结构和参数设置需要在论文中进一步查找。

🖼️ 关键图片

📊 实验亮点

实验结果表明,G2L框架在多个癌症特异性任务中超越了同等规模的先进模型,并在某些基准测试中超过了千亿级教师模型和超大型模型。此外,蒸馏模型表现出更高的鲁棒性指标,表明其对来自多个机构的图像变异具有更强的适应性。这些结果验证了G2L框架的有效性和优越性。

🎯 应用场景

该研究成果可应用于癌症诊断、预后预测和治疗方案选择等领域。通过部署轻量级的癌症特异性病理学模型,可以降低计算成本,提高诊断效率,并为临床医生提供更准确的决策支持。未来,该方法有望推广到其他医学图像分析任务中。

📄 摘要(原文)

Recent studies in pathology foundation models have shown that scaling training data, diversifying cancer types, and increasing model size consistently improve their performance. However, giga-scale foundation models, which are trained on hundreds of thousands of slides covering tens of cancer types and contain billions of parameters, pose significant challenges for practical use due to their tremendous computational costs in both development and deployment. In this work, we present a novel strategy, named the G2L framework, to increase the performance of large-scale foundation models, which consist of only $15\%$ of the parameters of giga-scale models, to a comparable performance level of giga-scale models in cancer-specific tasks. Our approach applies knowledge distillation, transferring the capabilities of a giga-scale model to a large-scale model, using just 1K pathology slides of a target cancer (e.g., breast, prostate, etc.). The resulting distilled model not only outperformed state-of-the-art models of the same size (i.e., large-scale) across several benchmarks but also, interestingly, surpassed the giga-scale teacher and huge-scale models in some benchmarks. In addition, the distilled model exhibited a higher robustness index, indicating improved resilience to image variations originating from multiple institutions. These findings suggest that the proposed distillation approach for a large-scale model is a data- and parameter-efficient way to achieve giga-scale-level performance for cancer-specific applications without prohibitive computational burden.