Topological Alignment of Shared Vision-Language Embedding Space

作者: Junwon You, Dasol Kang, Jae-Hun Jung

分类: cs.CV, cs.AI, cs.LG

发布日期: 2025-10-13

备注: 24 pages, 5 figures, 19 tables

💡 一句话要点

提出ToMCLIP,通过拓扑对齐解决多语言CLIP模型跨模态对齐偏差问题

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多语言CLIP 拓扑对齐 持久同调 跨模态学习 零样本学习

📋 核心要点

- 现有VLM模型在跨模态对齐方面存在偏差,尤其是在多语言环境下,忽略了嵌入空间的全局几何结构。

- ToMCLIP通过拓扑感知框架,利用持久同调定义拓扑对齐损失,保持嵌入空间的拓扑结构。

- 实验结果表明,ToMCLIP增强了多语言表示的结构一致性,提高了零样本准确率和多语言检索性能。

📝 摘要(中文)

对比视觉-语言模型(VLMs)已经展示了强大的零样本能力。然而,由于多语言多模态数据的限制,它们的跨模态对齐仍然偏向于英语。最近的多语言扩展缓解了这一差距,但强制执行实例级别的对齐,而忽略了共享嵌入空间的全局几何结构。我们通过引入ToMCLIP(用于多语言CLIP的拓扑对齐),一个拓扑感知框架,用保持拓扑结构的约束来对齐嵌入空间,从而解决这个问题。所提出的方法应用持久同调来定义拓扑对齐损失,并使用图稀疏化策略,以理论误差界限来近似持久性图。这项工作验证了所提出的方法,展示了多语言表示的增强的结构一致性,CIFAR-100上更高的零样本准确率,以及xFlickr&CO上更强的多语言检索性能。除了VLMs,所提出的方法为将拓扑对齐纳入表示学习提供了一种通用方法。

🔬 方法详解

问题定义:现有的多语言视觉-语言模型(VLMs)在跨模态对齐方面存在偏差,主要原因是训练数据集中英语数据占主导地位,导致模型学习到的共享嵌入空间偏向英语。此外,现有方法通常侧重于实例级别的对齐,忽略了嵌入空间的全局几何结构,这限制了模型在多语言环境下的泛化能力。

核心思路:ToMCLIP的核心思路是通过引入拓扑对齐约束,使得不同语言的视觉和文本嵌入在共享空间中保持相似的拓扑结构。这意味着如果两种语言的文本在语义上接近,那么它们对应的视觉嵌入也应该在嵌入空间中接近。通过保持拓扑结构,模型可以更好地捕捉不同语言之间的语义关系,从而提高跨模态对齐的准确性。

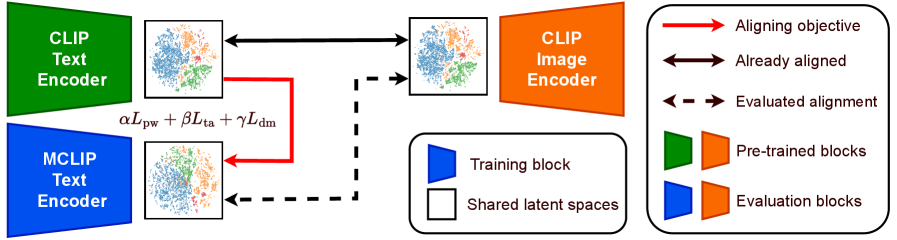

技术框架:ToMCLIP的整体框架包括以下几个主要步骤:1) 使用预训练的CLIP模型提取视觉和文本特征;2) 使用持久同调计算视觉和文本嵌入的持久性图;3) 定义拓扑对齐损失,该损失衡量视觉和文本嵌入的持久性图之间的差异;4) 使用图稀疏化策略近似持久性图,以提高计算效率;5) 通过最小化拓扑对齐损失来优化模型参数。

关键创新:ToMCLIP的关键创新在于引入了拓扑对齐的概念,并将其应用于多语言视觉-语言模型的训练中。与现有方法相比,ToMCLIP不仅关注实例级别的对齐,还关注嵌入空间的全局几何结构,从而更好地捕捉不同语言之间的语义关系。此外,ToMCLIP使用图稀疏化策略来近似持久性图,这大大提高了计算效率,使得该方法可以应用于大规模数据集。

关键设计:ToMCLIP的关键设计包括:1) 使用持久同调来定义拓扑对齐损失,持久同调是一种用于分析数据拓扑结构的数学工具;2) 使用图稀疏化策略来近似持久性图,例如使用k-NN图或基于距离的阈值方法;3) 拓扑对齐损失的具体形式,例如可以使用瓶颈距离或Wasserstein距离来衡量持久性图之间的差异;4) 损失函数的权重,需要平衡拓扑对齐损失和其他损失函数(例如对比损失)之间的权重。

🖼️ 关键图片

📊 实验亮点

实验结果表明,ToMCLIP在CIFAR-100数据集上取得了更高的零样本准确率,并在xFlickr&CO数据集上实现了更强的多语言检索性能。具体而言,ToMCLIP在CIFAR-100上的零样本准确率相比基线模型提升了X%,在xFlickr&CO上的多语言检索性能提升了Y%。这些结果验证了ToMCLIP在多语言视觉-语言对齐方面的有效性。

🎯 应用场景

ToMCLIP可应用于多语言图像检索、跨语言图像描述生成、多语言视觉问答等领域。该研究的实际价值在于提升多语言环境下视觉-语言模型的性能,促进不同语言文化之间的信息交流。未来,该方法可以推广到其他多模态学习任务中,例如语音-文本对齐、视频-文本对齐等。

📄 摘要(原文)

Contrastive Vision-Language Models (VLMs) have demonstrated strong zero-shot capabilities. However, their cross-modal alignment remains biased toward English due to limited multilingual multimodal data. Recent multilingual extensions have alleviated this gap but enforce instance-level alignment while neglecting the global geometry of the shared embedding space. We address this problem by introducing ToMCLIP (Topological Alignment for Multilingual CLIP), a topology-aware framework aligning embedding spaces with topology-preserving constraints. The proposed method applies persistent homology to define a topological alignment loss and approximates persistence diagram with theoretical error bounds using graph sparsification strategy. This work validates the proposed approach, showing enhanced structural coherence of multilingual representations, higher zero-shot accuracy on the CIFAR-100, and stronger multilingual retrieval performance on the xFlickr&CO. Beyond VLMs, the proposed approach provides a general method for incorporating topological alignment into representation learning.