ImHead: A Large-scale Implicit Morphable Model for Localized Head Modeling

作者: Rolandos Alexandros Potamias, Stathis Galanakis, Jiankang Deng, Athanasios Papaioannou, Stefanos Zafeiriou

分类: cs.CV

发布日期: 2025-10-12

备注: ICCV 2025

💡 一句话要点

提出imHead:一种用于局部头部建模的大规模隐式可变形模型

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 3D可变形模型 隐式函数 头部建模 局部编辑 深度学习 人脸建模 3D人脸 大规模数据集

📋 核心要点

- 现有3DMMs依赖严格拓扑和线性性质,难以表示复杂头部形状,限制了其表达能力。

- imHead利用深度隐式函数,通过中间区域特定潜在表示,实现局部编辑和紧凑的身份空间。

- 通过大规模数据集训练,imHead在身份和表情表达上优于现有方法,并支持可解释的3D人脸局部操作。

📝 摘要(中文)

近年来,3D可变形模型(3DMMs)已成为建模和生成富有表现力的3D头像的最先进方法。然而,由于它们依赖于严格的拓扑结构以及其线性性质,它们难以表示复杂的完整头部形状。 随着深度隐式函数的出现,我们提出了imHead,一种新颖的隐式3DMM,它不仅可以建模富有表现力的3D头部头像,还可以促进面部特征的局部编辑。 以前的方法直接将潜在空间划分为局部组件,并伴随身份编码以捕获全局形状变化,从而导致昂贵的潜在空间大小。 相比之下,我们保留了一个紧凑的身份空间,并引入了一个中间的特定区域潜在表示,以实现局部编辑。 为了训练imHead,我们管理了一个包含4K个不同身份的大规模数据集,从而朝着大规模3D头部建模迈出了一步。 在一系列实验中,我们证明了所提出的模型具有强大的表达能力,可以表示各种身份和表情,优于以前的方法。 此外,所提出的方法为3D人脸操作提供了一个可解释的解决方案,允许用户进行局部编辑。

🔬 方法详解

问题定义:论文旨在解决现有3DMM在表示复杂头部形状和进行局部编辑方面的局限性。传统3DMM由于其线性性质和对固定拓扑的依赖,难以捕捉精细的面部细节和进行灵活的局部修改。此外,直接将潜在空间划分为局部组件会导致潜在空间维度过高,增加计算负担。

核心思路:论文的核心思路是利用深度隐式函数来表示3D头部形状,并引入一个中间的区域特定潜在表示,从而在保持紧凑的身份空间的同时,实现对局部面部特征的精确控制和编辑。这种方法避免了直接分割潜在空间带来的高维度问题,并允许用户以更直观的方式操纵3D人脸。

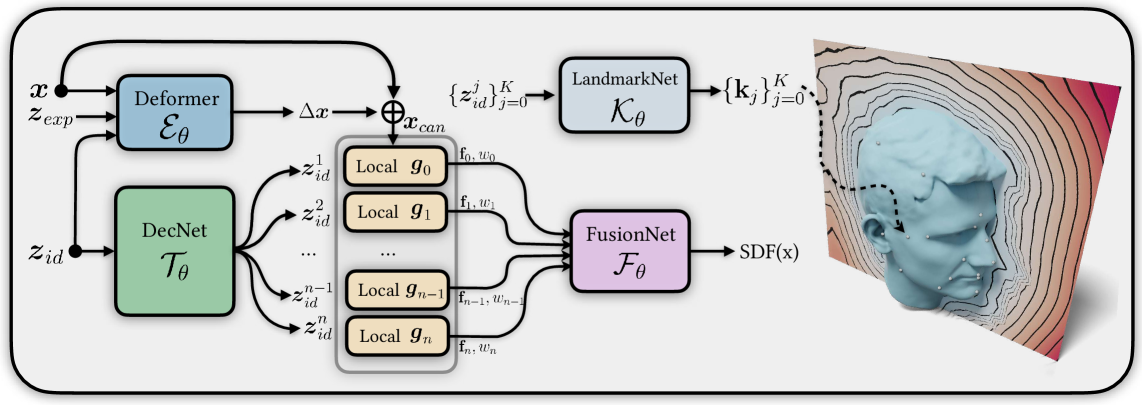

技术框架:imHead的技术框架主要包括以下几个模块:1)一个用于编码全局身份信息的紧凑的身份编码器;2)一个中间的区域特定潜在表示模块,用于生成局部面部区域的潜在编码;3)一个深度隐式函数,用于将身份编码和区域特定潜在编码映射到3D头部形状。训练过程中,模型通过最小化预测形状与真实形状之间的差异进行优化。

关键创新:imHead的关键创新在于其引入的中间区域特定潜在表示。与以往直接分割潜在空间的方法不同,imHead保留了一个全局的身份编码,并通过一个额外的模块生成局部区域的潜在编码。这种设计既保证了全局形状的一致性,又允许对局部特征进行精细的控制。

关键设计:imHead的关键设计包括:1)使用深度隐式函数作为形状表示,避免了对固定拓扑的依赖;2)引入区域特定潜在表示,实现局部编辑;3)使用大规模数据集进行训练,提高模型的泛化能力。具体的网络结构和损失函数细节未在摘要中详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

imHead通过大规模数据集的训练,在表达能力上超越了以往的3DMM方法,能够更好地表示各种身份和表情。实验结果表明,imHead在3D人脸建模和局部编辑方面具有显著的优势,能够生成更逼真、更可控的3D头部模型。具体的性能数据和提升幅度未在摘要中详细说明,属于未知信息。

🎯 应用场景

imHead在3D人脸建模、虚拟现实、增强现实、游戏开发等领域具有广泛的应用前景。它可以用于创建高度逼真的3D头像,实现个性化的虚拟形象定制,以及进行面部表情的动画制作和局部特征的编辑。此外,该技术还可以应用于人脸识别和人脸重建等领域,提高相关算法的准确性和鲁棒性。

📄 摘要(原文)

Over the last years, 3D morphable models (3DMMs) have emerged as a state-of-the-art methodology for modeling and generating expressive 3D avatars. However, given their reliance on a strict topology, along with their linear nature, they struggle to represent complex full-head shapes. Following the advent of deep implicit functions, we propose imHead, a novel implicit 3DMM that not only models expressive 3D head avatars but also facilitates localized editing of the facial features. Previous methods directly divided the latent space into local components accompanied by an identity encoding to capture the global shape variations, leading to expensive latent sizes. In contrast, we retain a single compact identity space and introduce an intermediate region-specific latent representation to enable local edits. To train imHead, we curate a large-scale dataset of 4K distinct identities, making a step-towards large scale 3D head modeling. Under a series of experiments we demonstrate the expressive power of the proposed model to represent diverse identities and expressions outperforming previous approaches. Additionally, the proposed approach provides an interpretable solution for 3D face manipulation, allowing the user to make localized edits.