Image-to-Video Transfer Learning based on Image-Language Foundation Models: A Comprehensive Survey

作者: Jinxuan Li, Chaolei Tan, Haoxuan Chen, Jianxin Ma, Jian-Fang Hu, Jianhuang Lai, Wei-Shi Zheng

分类: cs.CV, cs.AI

发布日期: 2025-10-12 (更新: 2026-01-19)

备注: Updated version, github repository is available at https://github.com/YuriPreisdent/awesome-image-to-video-transfer

💡 一句话要点

首个Image-to-Video迁移学习综述:基于图像-语言预训练模型,提升视频理解能力。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 图像-视频迁移学习 图像-语言预训练模型 视频理解 多模态学习 视频问答

📋 核心要点

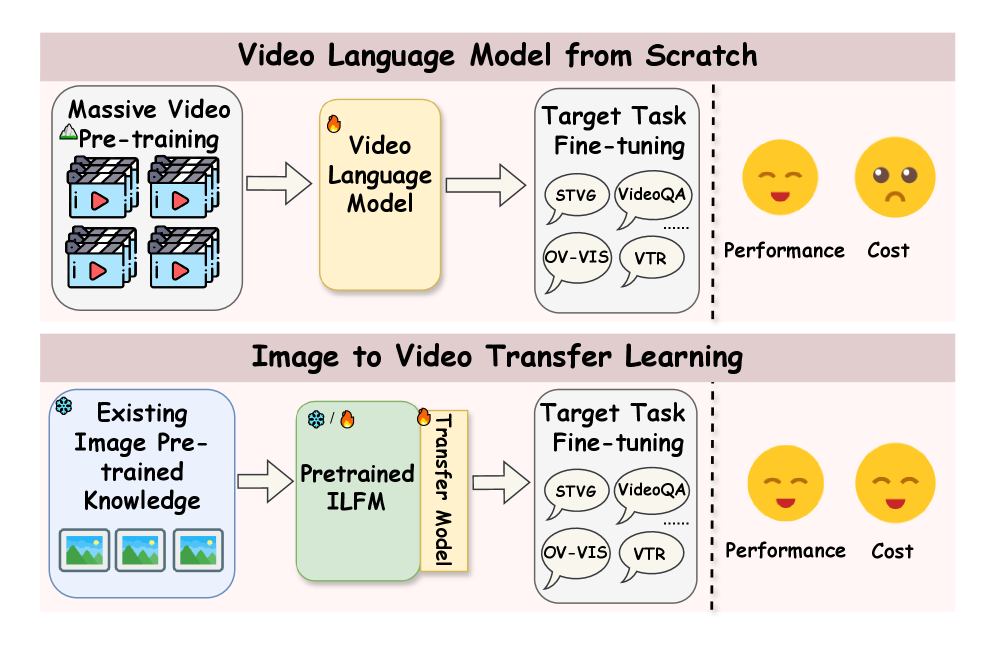

- 现有视频理解模型训练需要大量数据和算力,从头训练成本高昂,阻碍了其发展。

- 论文综述了基于图像-语言预训练模型的图像到视频迁移学习方法,降低了视频理解模型的训练成本。

- 论文对现有方法进行了分类、分析和实验对比,并指出了未来研究方向,为该领域提供了指导。

📝 摘要(中文)

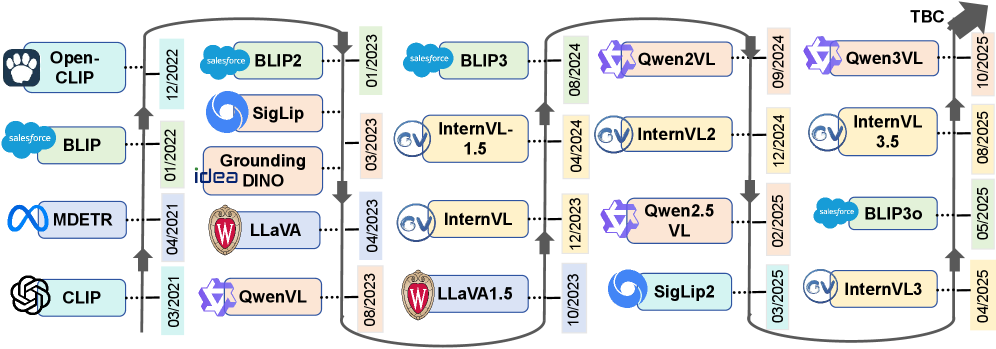

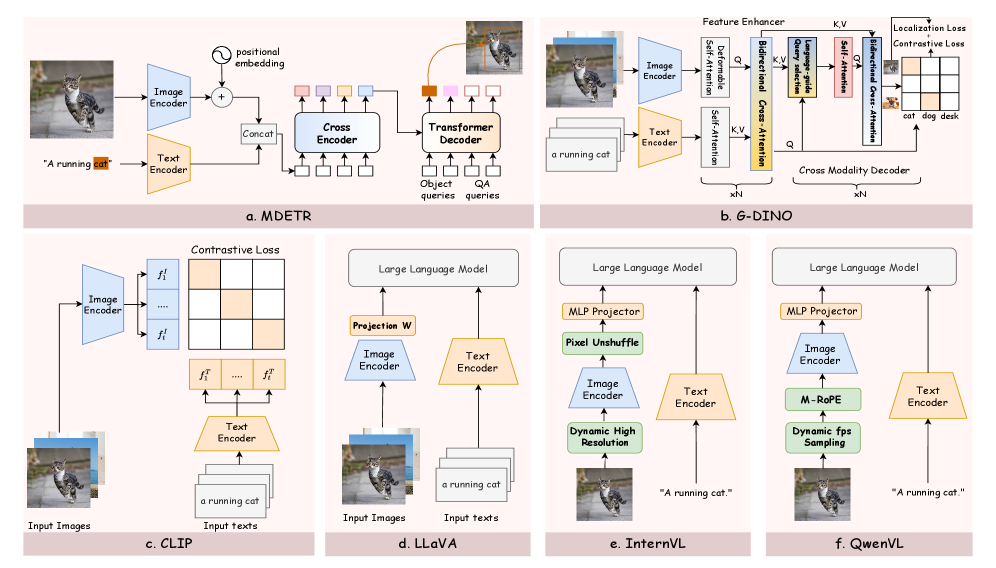

图像-语言预训练模型(ILFMs)在视觉-语言理解方面取得了显著成功,提供了可迁移的多模态表示,能够泛化到各种下游图像任务。视频-文本研究的进步激发了人们将基于图像的模型扩展到视频领域的兴趣。这种被称为图像到视频迁移学习的范例,有效地缓解了从头开始训练视频-语言模型所需的大量数据和计算需求,同时实现了相当甚至更强的模型性能。本综述首次全面回顾了这一新兴领域,首先总结了广泛使用的ILFMs及其能力。然后,基于将图像理解能力迁移到视频任务的范例,系统地将现有的图像到视频迁移学习技术分为两大类(冻结特征和自适应特征),以及许多细粒度的子类别。基于图像到视频迁移的任务特定性质,本综述系统地阐述了这些策略,并详细介绍了它们在各种视频-文本学习任务中的应用,从细粒度设置(例如,时空视频定位)到粗粒度设置(例如,视频问答)。我们进一步提出了详细的实验分析,以研究不同的图像到视频迁移学习范例在一系列下游视频理解任务中的有效性。最后,我们确定了普遍存在的挑战,并强调了未来研究的有希望的方向。通过提供全面和结构化的概述,本综述旨在为基于现有ILFM推进视频-文本学习建立结构化的路线图,并激发这个快速发展领域的未来研究方向。

🔬 方法详解

问题定义:现有视频理解模型训练依赖于大规模标注视频数据,训练成本高昂。直接将图像领域的模型应用于视频领域,无法有效利用视频的时序信息,性能受限。因此,如何高效地将图像领域的知识迁移到视频领域,是当前面临的关键问题。

核心思路:利用在海量图像-文本数据上预训练的图像-语言预训练模型(ILFMs),将其学习到的通用视觉和语言知识迁移到视频领域。通过不同的迁移策略,使模型能够理解视频内容并完成各种视频理解任务。

技术框架:该综述将现有的图像到视频迁移学习方法分为两大类:冻结特征和自适应特征。冻结特征方法直接使用ILFMs提取的图像特征,然后将其与视频帧进行融合。自适应特征方法则进一步微调ILFMs,使其更好地适应视频数据。每大类下又细分为多个子类别,例如,基于Transformer的融合、基于循环神经网络的融合等。

关键创新:该综述首次对图像到视频的迁移学习方法进行了全面的总结和分类,并从冻结特征和自适应特征两个角度对现有方法进行了分析。通过实验对比,分析了不同迁移策略的优缺点,为研究者提供了选择合适方法的指导。

关键设计:论文详细介绍了各种图像到视频迁移学习方法的技术细节,包括特征提取、特征融合、模型微调等。例如,对于冻结特征方法,介绍了如何使用不同的融合策略将图像特征与视频帧进行融合;对于自适应特征方法,介绍了如何设计合适的微调策略,使ILFMs更好地适应视频数据。此外,论文还讨论了不同任务下的迁移策略选择,以及如何针对特定任务进行优化。

🖼️ 关键图片

📊 实验亮点

论文对多种图像到视频迁移学习方法进行了实验对比,结果表明,自适应特征方法通常优于冻结特征方法。在视频问答、视频描述等任务上,基于ILFMs的迁移学习方法取得了显著的性能提升,相比于从头训练的模型,在性能上具有可比性甚至更优。

🎯 应用场景

该研究成果可广泛应用于视频内容理解、视频搜索、智能监控、自动驾驶等领域。通过利用图像-语言预训练模型的知识,可以有效提升视频理解模型的性能,降低训练成本,加速相关技术的落地应用,例如,可以用于开发更智能的视频推荐系统、更准确的视频内容分析工具等。

📄 摘要(原文)

Image-Language Foundation Models (ILFMs) have demonstrated remarkable success in vision-language understanding, providing transferable multimodal representations that generalize across diverse downstream image-based tasks. The advancement of video-text research has spurred growing interest in extending image-based models to the video domain. This paradigm, termed as image-to-video transfer learning, effectively mitigates the substantial data and computational demands compared to training video-language models from scratch while achieves comparable or even stronger model performance. This survey provides the first comprehensive review of this emerging field, which begins by summarizing the widely used ILFMs and their capabilities. We then systematically classify existing image-to-video transfer learning techniques into two broad root categories (frozen features and adapted features), along with numerous fine-grained subcategories, based on the paradigm for transferring image understanding capability to video tasks. Building upon the task-specific nature of image-to-video transfer, this survey methodically elaborates these strategies and details their applications across a spectrum of video-text learning tasks, ranging from fine-grained settings (e.g., spatio-temporal video grounding) to coarse-grained ones (e.g., video question answering). We further present a detailed experimental analysis to investigate the efficacy of different image-to-video transfer learning paradigms on a range of downstream video understanding tasks. Finally, we identify prevailing challenges and highlight promising directions for future research. By offering a comprehensive and structured overview, this survey aims to establish a structured roadmap for advancing video-text learning based on existing ILFM, and to inspire future research directions in this rapidly evolving domain. Github repository is available.