Bridging Perspectives: Foundation Model Guided BEV Maps for 3D Object Detection and Tracking

作者: Markus Käppeler, Özgün Çiçek, Daniele Cattaneo, Claudius Gläser, Yakov Miron, Abhinav Valada

分类: cs.CV, cs.RO

发布日期: 2025-10-11

💡 一句话要点

提出DualViewDistill,利用基础模型引导的BEV地图提升3D目标检测与跟踪性能。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 3D目标检测 目标跟踪 鸟瞰视图 透视视图 基础模型 BEV地图 特征蒸馏

📋 核心要点

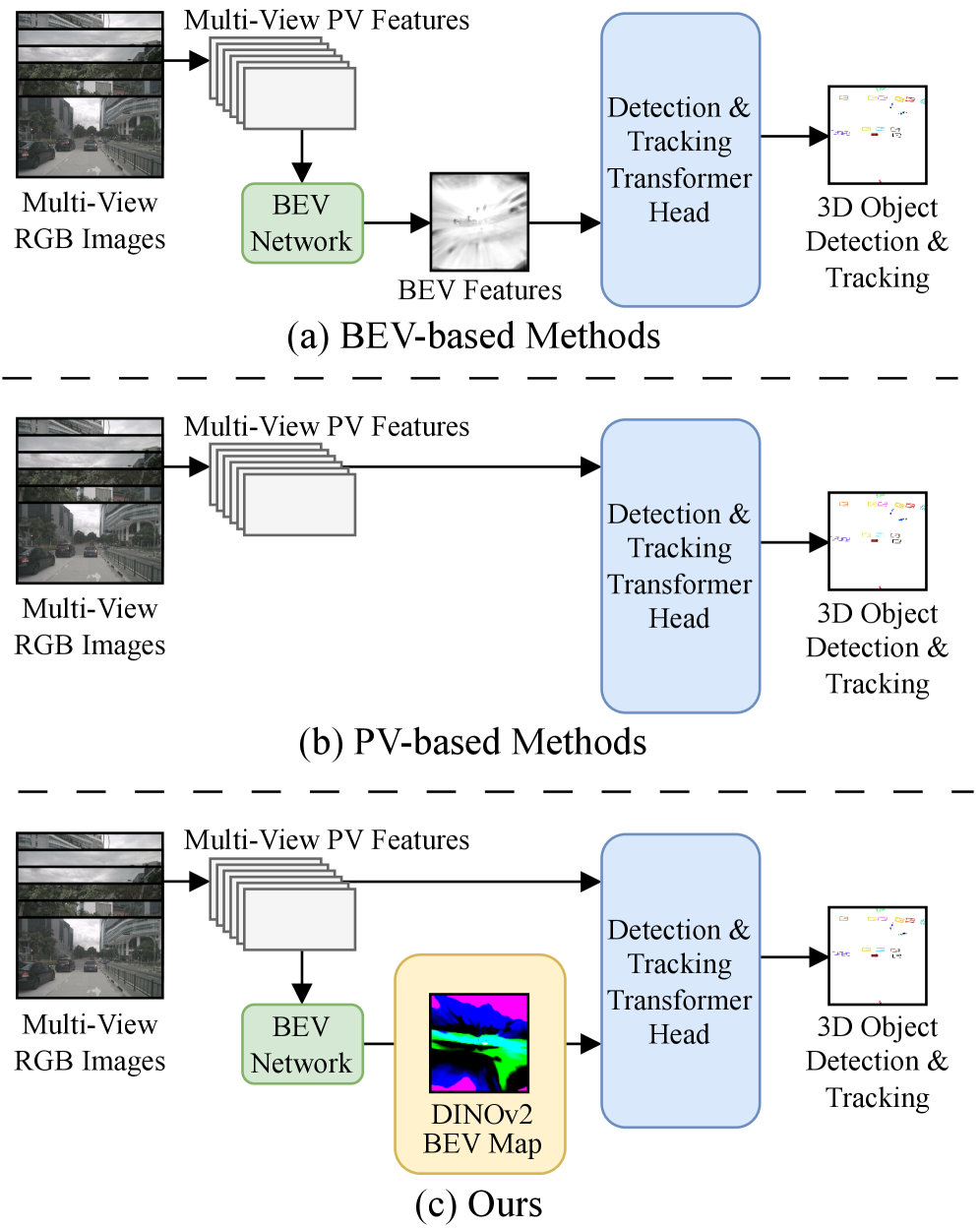

- 现有基于相机的3D目标检测与跟踪方法通常仅依赖透视视图或鸟瞰视图特征,无法同时利用细粒度的物体细节和空间结构化的场景表示。

- DualViewDistill通过基础模型引导的BEV地图,将DINOv2特征蒸馏到BEV表示中,并结合PV特征,实现混合表示,从而提升检测和跟踪性能。

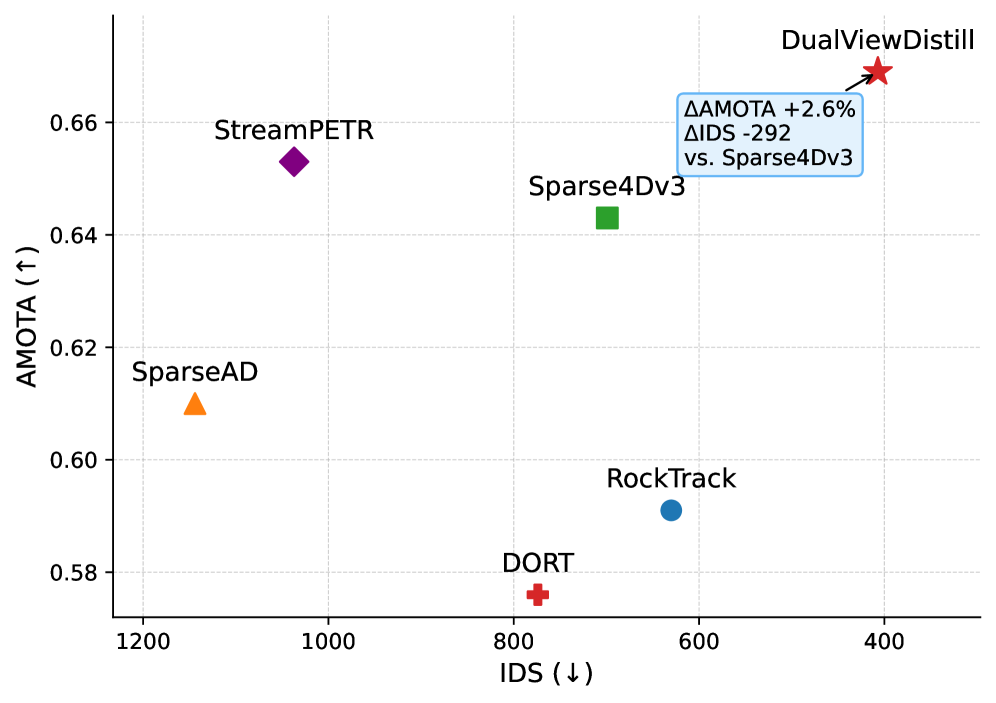

- 在nuScenes和Argoverse 2基准测试上,DualViewDistill取得了最先进的性能,验证了基础模型BEV地图在自动驾驶感知中的潜力。

📝 摘要(中文)

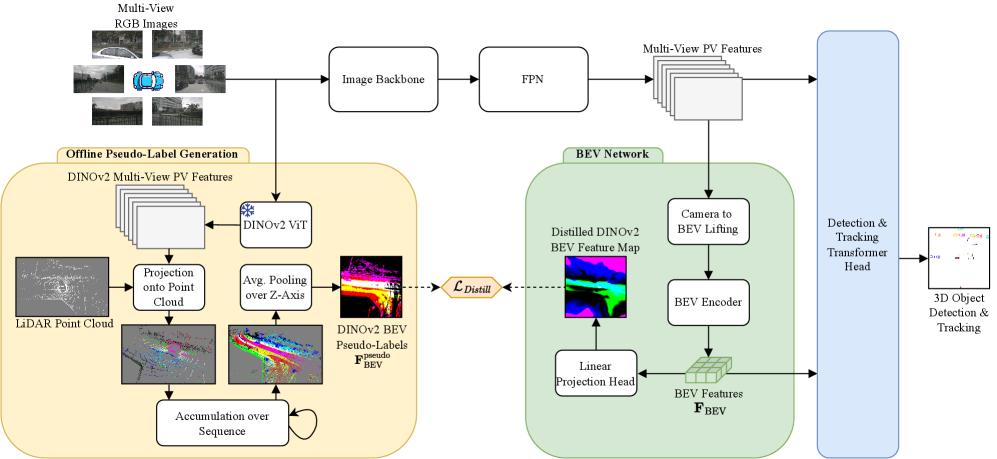

本文提出了一种混合检测和跟踪框架DualViewDistill,该框架融合了透视视图(PV)和鸟瞰视图(BEV)的相机图像特征,以利用它们互补的优势。该方法引入了由基础模型引导的BEV地图,利用描述性的DINOv2特征,并通过一种新颖的蒸馏过程将其提炼到BEV表示中。通过将PV特征与富含DINOv2语义和几何特征的BEV地图集成,我们的模型通过可变形聚合利用这种混合表示来增强3D目标检测和跟踪。在nuScenes和Argoverse 2基准测试上的大量实验表明,DualViewDistill实现了最先进的性能。结果表明,基础模型BEV地图具有为自动驾驶实现更可靠感知的潜力。代码和预训练模型可在https://dualviewdistill.cs.uni-freiburg.de 获取。

🔬 方法详解

问题定义:现有的基于视觉的3D目标检测和跟踪方法通常只关注透视视图(PV)或鸟瞰视图(BEV)中的特征,这限制了它们同时利用精细的物体细节和空间结构化场景信息的能力。PV特征擅长捕捉物体细节,但缺乏全局空间信息;BEV特征则提供了全局视角,但可能丢失部分物体细节。因此,如何有效地融合这两种视图的优势是一个关键问题。

核心思路:DualViewDistill的核心思路是利用预训练的基础模型(DINOv2)提取的强大特征来引导BEV地图的构建,从而将PV特征的细节信息融入到BEV表示中。通过这种方式,模型可以同时获得细粒度的物体信息和全局的空间结构信息,从而提高3D目标检测和跟踪的性能。

技术框架:DualViewDistill框架包含以下主要模块:1) PV特征提取:使用卷积神经网络提取相机图像的PV特征。2) 基础模型特征提取:使用DINOv2提取图像的描述性特征。3) BEV地图生成:通过一个新颖的蒸馏过程,将DINOv2特征提炼到BEV表示中,生成由基础模型引导的BEV地图。4) 特征融合:使用可变形聚合将PV特征与BEV地图进行融合,得到混合表示。5) 3D目标检测和跟踪:基于融合后的特征进行3D目标检测和跟踪。

关键创新:该论文的关键创新在于提出了利用基础模型(DINOv2)引导的BEV地图,并通过蒸馏过程将DINOv2特征融入BEV表示中。与传统的BEV地图生成方法相比,该方法能够更好地保留物体细节和语义信息,从而提高检测和跟踪性能。此外,使用可变形聚合进行PV和BEV特征融合也是一个创新点,能够更灵活地适应不同视角的特征。

关键设计:在BEV地图生成过程中,使用了一种新颖的蒸馏损失函数,以确保BEV地图能够有效地捕捉DINOv2特征。可变形聚合模块使用了可学习的偏移量,以便更好地对齐PV和BEV特征。具体的网络结构和参数设置在论文中有详细描述,例如DINOv2特征的维度、蒸馏损失函数的权重、可变形卷积的参数等。

🖼️ 关键图片

📊 实验亮点

DualViewDistill在nuScenes和Argoverse 2基准测试上取得了最先进的性能。具体而言,在nuScenes数据集上,该方法在3D目标检测和跟踪方面均超越了现有方法。在Argoverse 2数据集上,该方法也取得了显著的性能提升,证明了其在不同场景下的泛化能力。实验结果表明,利用基础模型引导的BEV地图能够有效地提升3D目标检测和跟踪的性能。

🎯 应用场景

该研究成果可广泛应用于自动驾驶、机器人导航、智能交通等领域。通过提升3D目标检测和跟踪的准确性和鲁棒性,可以提高自动驾驶系统的安全性,增强机器人对周围环境的感知能力,并为智能交通管理提供更可靠的数据支持。未来,该方法有望扩展到其他感知任务,如场景理解、行为预测等。

📄 摘要(原文)

Camera-based 3D object detection and tracking are essential for perception in autonomous driving. Current state-of-the-art approaches often rely exclusively on either perspective-view (PV) or bird's-eye-view (BEV) features, limiting their ability to leverage both fine-grained object details and spatially structured scene representations. In this work, we propose DualViewDistill, a hybrid detection and tracking framework that incorporates both PV and BEV camera image features to leverage their complementary strengths. Our approach introduces BEV maps guided by foundation models, leveraging descriptive DINOv2 features that are distilled into BEV representations through a novel distillation process. By integrating PV features with BEV maps enriched with semantic and geometric features from DINOv2, our model leverages this hybrid representation via deformable aggregation to enhance 3D object detection and tracking. Extensive experiments on the nuScenes and Argoverse 2 benchmarks demonstrate that DualViewDistill achieves state-of-the-art performance. The results showcase the potential of foundation model BEV maps to enable more reliable perception for autonomous driving. We make the code and pre-trained models available at https://dualviewdistill.cs.uni-freiburg.de .