Bimanual 3D Hand Motion and Articulation Forecasting in Everyday Images

作者: Aditya Prakash, David Forsyth, Saurabh Gupta

分类: cs.CV, cs.AI, cs.LG

发布日期: 2025-10-07

备注: Project page: https://ap229997.github.io/projects/forehand4d

💡 一句话要点

提出基于扩散模型的双手3D运动与姿态预测方法,提升日常图像中的预测精度。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 双手运动预测 3D手部姿态估计 扩散模型 伪标签学习 多模态预测

📋 核心要点

- 现有方法缺乏在多样化日常场景中3D手部运动标注数据,限制了模型训练和泛化能力。

- 利用扩散模型将2D关键点序列提升为4D运动,并采用扩散损失来处理手部运动的多模态特性。

- 实验表明,该方法在多个数据集上优于现有基线,尤其在零样本泛化到日常图像时表现突出。

📝 摘要(中文)

本文研究了在日常场景的单张图像中预测双手3D运动和姿态的问题。为了解决在多样化场景中缺乏3D手部标注的问题,我们设计了一个标注流程,该流程包含一个扩散模型,用于将2D手部关键点序列提升为4D手部运动。对于预测模型,我们采用扩散损失来解决手部运动分布中的多模态问题。在6个数据集上的大量实验表明,使用带有推断标签的多样化数据进行训练的优势(提升14%),以及我们的提升(提高42%)和预测(提高16.4%)模型的有效性,优于最佳基线,尤其是在零样本泛化到日常图像方面。

🔬 方法详解

问题定义:论文旨在解决从单张日常图像中预测双手3D运动和姿态的问题。现有方法面临的痛点是缺乏足够多的、带有3D手部标注的训练数据,尤其是在真实、多样的日常场景中。这导致模型难以学习到准确的手部运动模式,泛化能力受限。

核心思路:论文的核心思路是利用扩散模型生成伪标签数据,从而扩充训练集,并采用扩散损失来建模手部运动分布的多模态特性。通过这种方式,模型可以更好地学习到真实世界中手部运动的复杂性和多样性。

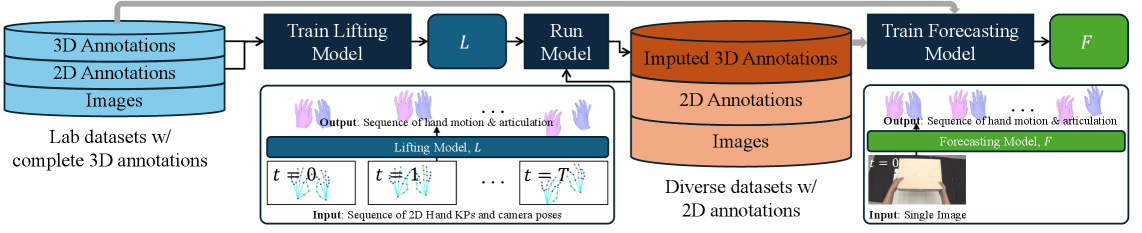

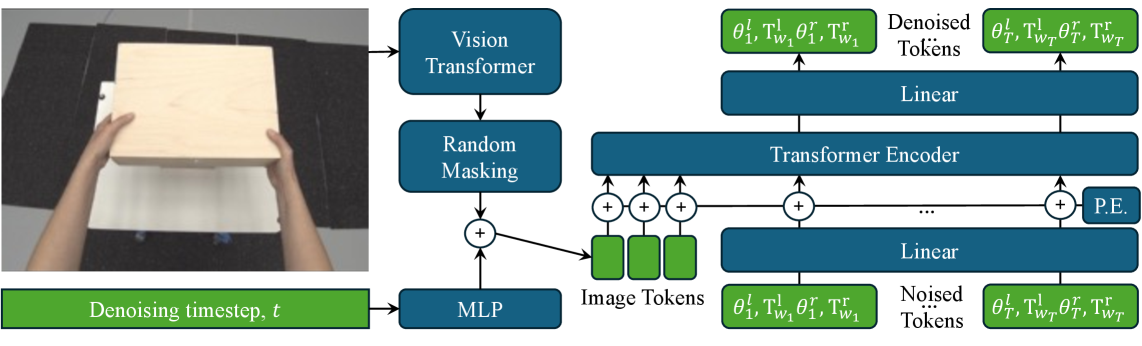

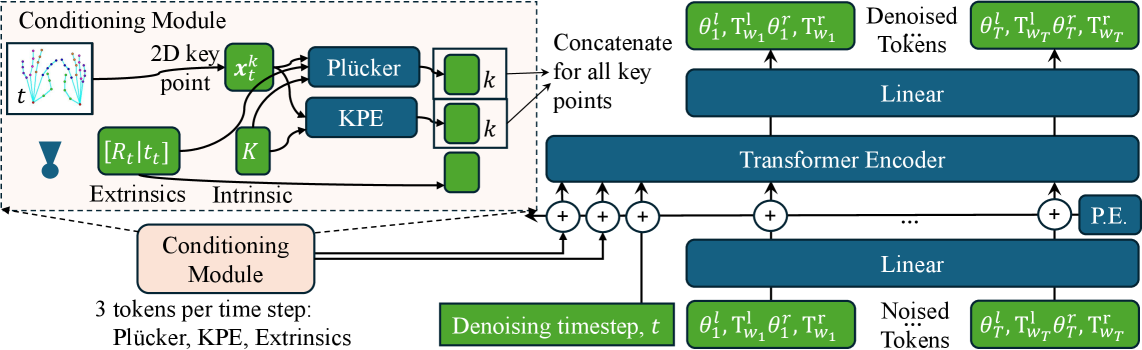

技术框架:整体框架包含两个主要阶段:1) 数据标注阶段:使用扩散模型将2D手部关键点序列提升为4D手部运动,生成伪标签的3D手部运动数据。2) 运动预测阶段:训练一个预测模型,该模型以单张图像作为输入,预测未来一段时间内的双手3D运动和姿态。该模型使用扩散损失进行训练,以更好地捕捉手部运动分布的多模态特性。

关键创新:论文的关键创新在于:1) 提出了一种基于扩散模型的2D-to-3D手部运动提升方法,用于生成伪标签数据。2) 采用扩散损失来建模手部运动分布的多模态特性,提高了预测的准确性和多样性。与现有方法相比,该方法能够更好地利用未标注的图像数据,并在零样本泛化方面表现更佳。

关键设计:在数据标注阶段,扩散模型被训练用于将2D手部关键点序列映射到4D手部运动。在运动预测阶段,模型使用扩散损失进行训练,该损失函数鼓励模型生成符合真实手部运动分布的预测结果。具体的网络结构和参数设置在论文中进行了详细描述,但此处未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用带有推断标签的多样化数据进行训练,模型性能提升了14%。提出的手部运动提升方法比现有最佳基线提高了42%,运动预测模型提高了16.4%。尤其值得注意的是,该方法在零样本泛化到日常图像方面表现出色,证明了其在真实世界场景中的应用潜力。

🎯 应用场景

该研究成果可应用于人机交互、虚拟现实、增强现实等领域。例如,可以用于开发更自然、更流畅的手势控制系统,或者用于创建更逼真的虚拟人物动画。此外,该技术还可以用于医疗康复领域,例如,用于评估患者的手部运动功能,或者用于辅助患者进行手部康复训练。

📄 摘要(原文)

We tackle the problem of forecasting bimanual 3D hand motion & articulation from a single image in everyday settings. To address the lack of 3D hand annotations in diverse settings, we design an annotation pipeline consisting of a diffusion model to lift 2D hand keypoint sequences to 4D hand motion. For the forecasting model, we adopt a diffusion loss to account for the multimodality in hand motion distribution. Extensive experiments across 6 datasets show the benefits of training on diverse data with imputed labels (14% improvement) and effectiveness of our lifting (42% better) & forecasting (16.4% gain) models, over the best baselines, especially in zero-shot generalization to everyday images.