When Thinking Drifts: Evidential Grounding for Robust Video Reasoning

作者: Mi Luo, Zihui Xue, Alex Dimakis, Kristen Grauman

分类: cs.CV, cs.AI

发布日期: 2025-10-07

备注: Accepted by NeurIPS 2025, Project page: https://vision.cs.utexas.edu/projects/video-ver/

💡 一句话要点

提出Visual Evidence Reward (VER)框架,解决视频推理中思维漂移问题。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视频推理 思维链 视觉证据 强化学习 多模态学习

📋 核心要点

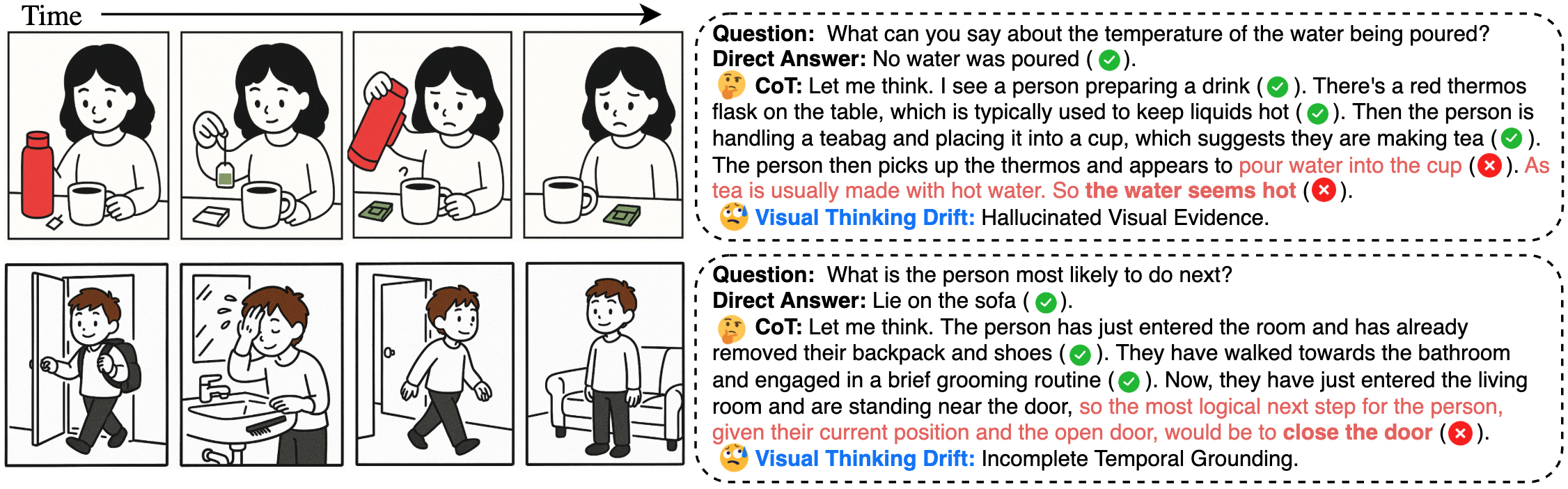

- 现有Chain-of-Thought方法在视频推理中表现不佳,易产生误导性信息,导致“视觉思维漂移”。

- 提出Visual Evidence Reward (VER)框架,通过强化学习奖励基于视觉证据的推理过程。

- 在10个视频理解基准测试中,Video-VER始终取得最佳性能,验证了方法的有效性。

📝 摘要(中文)

视频推理是使机器能够通过多步骤逻辑从动态视觉内容中进行推断的任务,对于高级人工智能至关重要。尽管思维链(CoT)机制增强了基于文本的任务中的推理能力,但其在视频理解中的应用仍未得到充分探索。本文提出了一项系统分析,揭示了CoT通常会降低视频推理的性能,产生冗长但具有误导性的内部独白,并导致幻觉视觉细节和覆盖正确的直觉——我们称之为“视觉思维漂移”的现象。我们通过贝叶斯视角解释了这种漂移,认为CoT轨迹通常偏离实际的视觉证据,而是放大了内部偏差或语言先验,导致模型进行故事讲述而不是进行基于证据的推理。为了抵消这一点,我们引入了Visual Evidence Reward(VER),这是一个新颖的强化学习框架,它明确奖励生成可验证地基于视觉证据的推理轨迹。在10个不同的视频理解基准上的全面评估表明,我们的Video-VER始终如一地实现了最佳性能。我们的工作揭示了以视频为中心的推理的独特挑战,并鼓励开发能够稳健地将其推论建立在视觉证据之上的AI——对于不仅“先思考再回答”,而且“边看边思考”的大型多模态模型。

🔬 方法详解

问题定义:论文旨在解决视频推理任务中,现有Chain-of-Thought (CoT) 方法存在的“视觉思维漂移”问题。CoT在文本推理中表现良好,但在视频推理中,模型容易产生与视觉证据不符的内部独白,导致幻觉视觉细节,并降低推理准确性。现有方法的痛点在于缺乏对视觉证据的有效利用和约束,模型容易受到语言先验的影响。

核心思路:论文的核心思路是通过强化学习,显式地奖励模型生成与视觉证据相符的推理轨迹。通过引入Visual Evidence Reward (VER),引导模型在推理过程中更加关注视觉信息,减少对语言先验的依赖,从而提高视频推理的鲁棒性和准确性。这种方法旨在使模型“边看边思考”,而不是仅仅“先思考再回答”。

技术框架:VER框架主要包含以下几个模块:1) 视频编码器:用于提取视频的视觉特征。2) 推理生成器:基于视频特征生成推理轨迹(Chain-of-Thought)。3) 视觉证据评估器:评估推理轨迹与视觉证据的一致性,并给出奖励信号。4) 强化学习优化器:使用奖励信号优化推理生成器,使其生成更符合视觉证据的推理轨迹。整个流程通过强化学习迭代优化,最终得到一个能够进行可靠视频推理的模型。

关键创新:论文最重要的技术创新点在于提出了Visual Evidence Reward (VER) 机制,将视觉证据显式地纳入到推理过程的优化中。与传统的CoT方法不同,VER不仅关注推理过程的连贯性,更强调推理过程与视觉证据的一致性。这种基于视觉证据的奖励机制能够有效抑制“视觉思维漂移”,提高视频推理的准确性和鲁棒性。

关键设计:VER框架的关键设计包括:1) 视觉证据评估器的设计:如何有效地评估推理轨迹与视觉证据的一致性是一个关键问题。论文可能采用了某种相似度度量或注意力机制来实现这一目标。2) 奖励函数的设计:如何设计奖励函数,使得模型既能生成连贯的推理轨迹,又能保证与视觉证据的一致性,是一个需要仔细考虑的问题。3) 强化学习算法的选择:选择合适的强化学习算法(如Policy Gradient或Actor-Critic)来优化推理生成器,也是影响VER框架性能的关键因素。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Video-VER在10个不同的视频理解基准测试中始终如一地实现了最佳性能,显著优于传统的Chain-of-Thought方法和其他基线模型。具体性能数据(如准确率、召回率等)和提升幅度需要在论文中查找。这些结果有力地证明了VER框架在抑制“视觉思维漂移”和提高视频推理准确性方面的有效性。

🎯 应用场景

该研究成果可应用于智能监控、视频内容分析、人机交互等领域。例如,在智能监控中,可以利用该技术对异常行为进行准确识别和推理;在视频内容分析中,可以帮助机器理解视频中的复杂事件和关系;在人机交互中,可以使机器更好地理解人类的意图,并做出相应的反应。未来,该技术有望推动多模态人工智能的发展,实现更智能、更可靠的视频理解。

📄 摘要(原文)

Video reasoning, the task of enabling machines to infer from dynamic visual content through multi-step logic, is crucial for advanced AI. While the Chain-of-Thought (CoT) mechanism has enhanced reasoning in text-based tasks, its application to video understanding remains underexplored. This paper presents a systematic analysis revealing that CoT often degrades performance in video reasoning, generating verbose but misleading internal monologues, and leading to hallucinated visual details and overridden correct intuitions - a phenomenon we term "visual thinking drift". We explain this drift through a Bayesian lens, positing that CoT traces often diverge from actual visual evidence, instead amplifying internal biases or language priors, causing models to storytell rather than engage in grounded reasoning. To counteract this, we introduce Visual Evidence Reward (VER), a novel reinforcement learning framework that explicitly rewards the generation of reasoning traces that are verifiably grounded in visual evidence. Comprehensive evaluation across 10 diverse video understanding benchmarks demonstrates that our Video-VER consistently achieves top performance. Our work sheds light on the distinct challenges of video-centric reasoning and encourages the development of AI that robustly grounds its inferences in visual evidence - for large multimodal models that not only "think before answering", but also "see while thinking".