Flow4Agent: Long-form Video Understanding via Motion Prior from Optical Flow

作者: Ruyang Liu, Shangkun Sun, Haoran Tang, Ge Li, Wei Gao

分类: cs.CV

发布日期: 2025-10-07

备注: Accepted to ICCV' 2025

💡 一句话要点

Flow4Agent:利用光流运动先验进行长视频理解,提升MLLM性能。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 长视频理解 光流 运动先验 多模态大语言模型 视频冗余消除

📋 核心要点

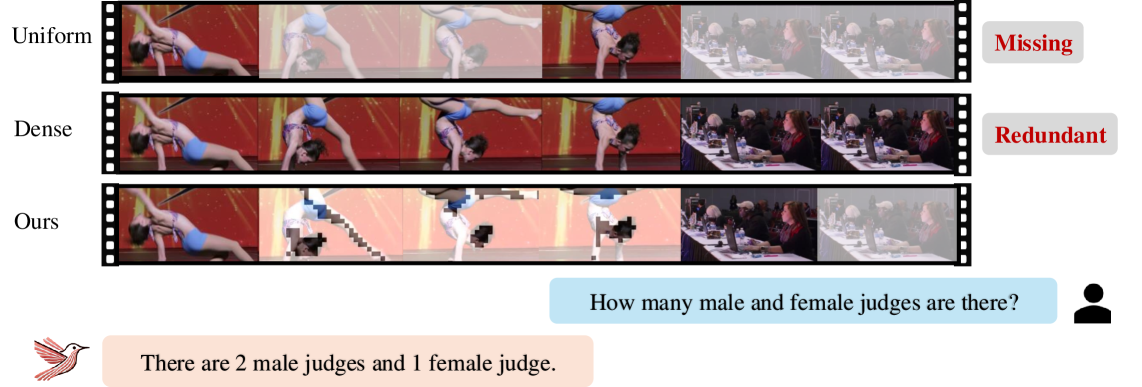

- 长视频理解面临时空冗余和MLLM上下文长度限制的双重挑战,现有方法依赖语义先验,忽略了运动信息。

- Flow4Agent利用光流提供的运动先验,通过时间粒度优化和运动令牌剪枝,有效减少视频冗余,提升MLLM性能。

- 实验结果表明,Flow4Agent在多个长视频理解基准测试中显著优于现有方法,尤其在小时级视频上表现突出。

📝 摘要(中文)

长视频理解因时空内容冗余而极具挑战,多模态大型语言模型(MLLM)的有限上下文长度进一步加剧了这一问题。现有方法通常依赖CLIP模型提取语义相关的关键视频信息。本文提出Flow4Agent,一种创新框架,率先将光流中的运动先验融入LLM,以促进长视频理解。Flow4Agent通过两个核心模块缓解长视频中的冗余:时间粒度优化(TGO)自适应地细化帧级层次结构,首先利用粗略的光流先验对相似的视觉内容进行分组,然后应用语义先验来过滤掉高度不相关的场景信息;运动令牌剪枝(MTP)进一步细化帧内视觉表示,使用细粒度的光流信息剪除高冗余的视频令牌。大量实验表明,Flow4Agent在各种视频MLLM基准测试中优于现有方法,尤其是在小时级视频理解任务中,在Video-MME上达到64.7%,在MLVU上达到71.4%,在LongVideoBench上达到60.4%。

🔬 方法详解

问题定义:长视频理解任务面临着巨大的时空冗余,这使得现有的多模态大型语言模型(MLLM)难以有效地处理。现有方法通常依赖于语义先验,例如CLIP模型,来提取关键帧或关键区域,但忽略了视频中的运动信息,导致对视频动态变化的理解不足。此外,这些方法在处理小时级别的长视频时,性能会显著下降。

核心思路:Flow4Agent的核心思路是利用光流提供的运动先验信息,来指导视频冗余信息的去除,从而提高MLLM对长视频的理解能力。通过运动信息,可以更准确地识别视频中的关键动作和场景变化,从而更好地保留重要的视频内容。这种方法能够有效地减少需要处理的视频帧和令牌数量,从而缓解MLLM的上下文长度限制。

技术框架:Flow4Agent框架包含两个主要模块:时间粒度优化(TGO)和运动令牌剪枝(MTP)。TGO首先利用粗略的光流信息将相似的视频内容进行分组,形成帧级层次结构,然后使用语义先验过滤掉不相关的场景信息。MTP则利用细粒度的光流信息,在帧内剪除高冗余的视频令牌。整个流程首先通过TGO进行粗粒度的时间维度压缩,再通过MTP进行细粒度的空间维度压缩,最终将精简后的视频信息输入到MLLM中进行理解。

关键创新:Flow4Agent的关键创新在于将光流的运动先验引入到长视频理解任务中。与现有方法仅依赖语义先验不同,Flow4Agent同时考虑了视频的运动信息和语义信息,从而能够更全面地理解视频内容。此外,TGO和MTP两个模块的设计,能够有效地减少视频冗余,提高MLLM的处理效率和性能。

关键设计:在TGO模块中,使用了光流的幅度作为相似性度量,将幅度相近的帧进行分组。在MTP模块中,使用了光流的梯度作为令牌重要性的度量,梯度较小的令牌被认为是冗余的,并被剪除。具体的光流计算方法和阈值选择可能需要根据不同的视频数据集进行调整。损失函数方面,Flow4Agent可以使用标准的交叉熵损失函数来训练MLLM,同时可以加入一些正则化项来约束光流的计算。

🖼️ 关键图片

📊 实验亮点

Flow4Agent在多个长视频理解基准测试中取得了显著的性能提升。在Video-MME上,Flow4Agent达到了64.7%的准确率;在MLVU上,达到了71.4%的准确率;在LongVideoBench上,达到了60.4%的准确率。这些结果表明,Flow4Agent在长视频理解方面优于现有的方法,尤其是在处理小时级别的视频时,性能提升更为明显。相较于基线方法,Flow4Agent在这些基准测试中取得了显著的性能提升。

🎯 应用场景

Flow4Agent在视频监控、自动驾驶、智能安防、视频内容分析等领域具有广泛的应用前景。通过提高长视频理解的准确性和效率,可以实现更智能的视频分析和决策。例如,在视频监控中,可以自动检测异常行为;在自动驾驶中,可以更准确地识别交通状况;在视频内容分析中,可以自动生成视频摘要和标签。未来,Flow4Agent可以与其他技术相结合,例如目标检测、行为识别等,实现更复杂的视频理解任务。

📄 摘要(原文)

Long-form video understanding has always been a challenging problem due to the significant redundancy in both temporal and spatial contents. This challenge is further exacerbated by the limited context length of Multimodal Large Language Models (MLLMs). To address this issue, many previous works have attempted to extract key video information, where the "key" is typically semantic-aware and heavily dependent on the CLIP model as prior. In this paper, we propose Flow4Agent, a novel framework that pioneeringly incorporates motion priors from optical flow to facilitate LLM-based long video understanding. Flow4Agent mitigates the redundancy in long videos at both temporal and spatial levels through two core modules: Temporal Granularity Optimization (TGO) adaptively refines framelevel hierarchies, which first leverages coarse flow priors to group similar visual contents and then applies semantic priors to filter out highly irrelevant scene information. Motion Token Pruning (MTP) further refines the intra-frame visual representations, pruning high-redundancy video tokens using fine-grained optical flow information. Extensive experiments demonstrate that our Flow4Agent outperforms existing methods across a wide range of video MLLM benchmarks, especially for hour-level video understanding tasks, achieving 64.7% on Video-MME, 71.4% on MLVU and 60.4% on LongVideoBench.