Improving Chain-of-Thought Efficiency for Autoregressive Image Generation

作者: Zeqi Gu, Markos Georgopoulos, Xiaoliang Dai, Marjan Ghazvininejad, Chu Wang, Felix Juefei-Xu, Kunpeng Li, Yujun Shi, Zecheng He, Zijian He, Jiawei Zhou, Abe Davis, Jialiang Wang

分类: cs.CV, cs.AI, cs.CL

发布日期: 2025-10-07

💡 一句话要点

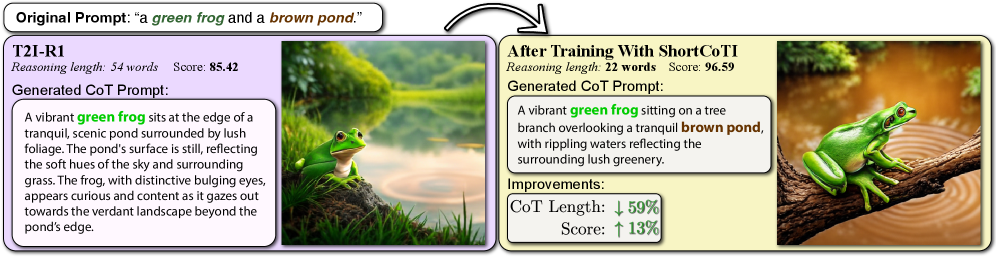

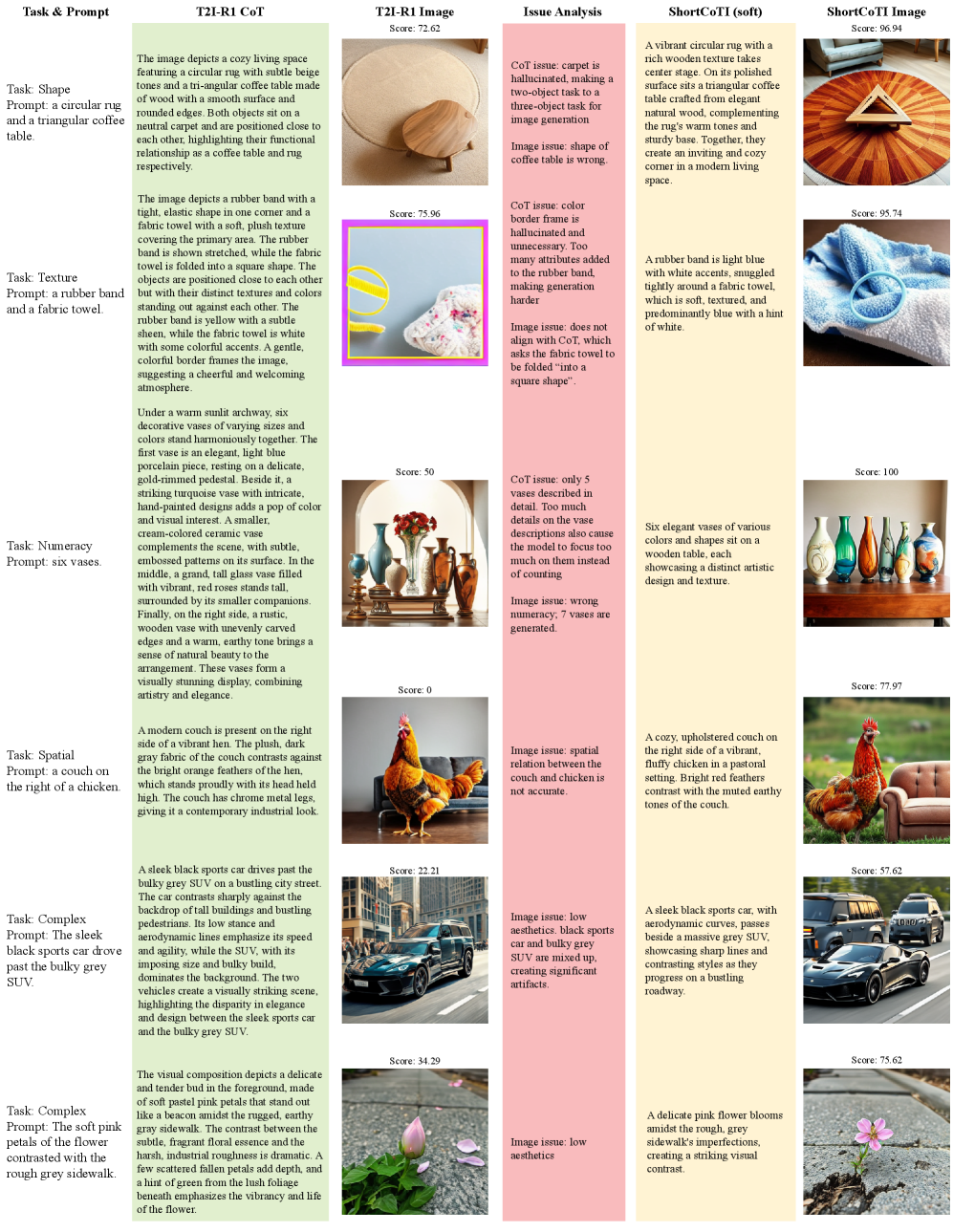

提出ShortCoTI框架,提升自回归图像生成中思维链的效率,减少冗余计算。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 自回归图像生成 思维链 强化学习 效率优化 提示工程

📋 核心要点

- 现有自回归图像生成模型采用思维链推理,但存在“视觉过度思考”问题,导致计算成本增加和细节矛盾。

- ShortCoTI框架通过强化学习,鼓励生成更简洁的思维链提示,并根据任务难度自适应调整奖励。

- 实验表明,ShortCoTI在保持或提升图像质量的同时,显著缩短了推理长度,提高了计算效率。

📝 摘要(中文)

本文针对自回归多模态大语言模型在图像生成中采用思维链(CoT)推理时存在的冗余问题,即“视觉过度思考”,提出了一种轻量级的优化框架ShortCoTI。该框架旨在生成更简洁的CoT序列,从而提高图像生成的效率。ShortCoTI通过引入自适应奖励函数,鼓励生成更简洁的提示,并根据任务难度进行调整。将此奖励纳入强化学习范式中,可将提示推理长度缩短54%,同时在多个基准测试(T2I-CompBench、GenEval)上保持或略微提高质量指标。定性分析表明,该方法消除了冗长的解释和重复的改进,生成既简洁又语义丰富的推理提示。因此,ShortCoTI提高了计算效率,而不会影响生成图像的保真度或视觉吸引力。

🔬 方法详解

问题定义:论文旨在解决自回归图像生成模型中,使用思维链(Chain-of-Thought, CoT)方法时产生的“视觉过度思考”问题。现有方法为了增强对齐和细节,会先将用户输入扩展为详细的提示,然后再进行图像合成。然而,这种策略会引入不必要的冗余,增加计算成本,甚至引入与原始提示相矛盾的细节。

核心思路:论文的核心思路是通过强化学习,鼓励模型生成更简洁的CoT序列,同时保持生成图像的质量。通过引入一个奖励函数,对更简洁的提示进行奖励,从而引导模型学习生成更高效的推理过程。奖励函数的设计考虑了任务的难度,对不同难度的任务采用不同的奖励尺度。

技术框架:ShortCoTI的整体框架基于强化学习。首先,使用一个预训练的自回归模型作为基础模型。然后,通过强化学习训练一个策略网络,该网络负责生成CoT序列。在训练过程中,模型根据生成的CoT序列生成图像,并根据图像质量和CoT序列的长度计算奖励。策略网络的目标是最大化累积奖励。

关键创新:该论文的关键创新在于提出了一个自适应的奖励函数,该函数根据任务的难度对CoT序列的长度进行惩罚。这种自适应的奖励机制可以有效地平衡CoT序列的长度和生成图像的质量。此外,该论文还提出了一种轻量级的优化框架,可以很容易地集成到现有的自回归图像生成模型中。

关键设计:奖励函数的设计是ShortCoTI的关键。奖励函数由两部分组成:图像质量奖励和长度惩罚。图像质量奖励可以使用任何现有的图像质量评估指标,例如CLIP score或FID score。长度惩罚是一个与CoT序列长度相关的函数,其系数根据任务难度自适应调整。具体来说,对于更简单的任务,长度惩罚的系数会更大,从而鼓励模型生成更简洁的CoT序列。强化学习算法可以使用常见的策略梯度算法,例如REINFORCE或PPO。

🖼️ 关键图片

📊 实验亮点

实验结果表明,ShortCoTI框架在T2I-CompBench和GenEval等多个基准测试上,能够将提示推理长度缩短54%,同时保持或略微提高图像质量指标。定性分析显示,ShortCoTI能够消除冗长的解释和重复的改进,生成更简洁且语义丰富的推理提示。

🎯 应用场景

ShortCoTI框架可应用于各种需要高效图像生成的场景,例如移动设备上的图像编辑、低功耗设备上的图像生成、以及需要快速迭代设计的创意工具。通过减少计算冗余,该方法能够降低生成成本,提高用户体验,并促进更广泛的图像生成应用。

📄 摘要(原文)

Autoregressive multimodal large language models have recently gained popularity for image generation, driven by advances in foundation models. To enhance alignment and detail, newer approaches employ chain-of-thought (CoT) reasoning, expanding user inputs into elaborated prompts prior to image synthesis. However, this strategy can introduce unnecessary redundancy -- a phenomenon we call visual overthinking -- which increases computational costs and can introduce details that contradict the original prompt. In this work, we explore how to generate more concise CoT sequences for more efficient image generation. We introduce ShortCoTI, a lightweight optimization framework that encourages more concise CoT while preserving output image quality. ShortCoTI rewards more concise prompts with an adaptive function that scales according to an estimated difficulty for each task. Incorporating this reward into a reinforcement learning paradigm reduces prompt reasoning length by 54% while maintaining or slightly improving quality metrics across multiple benchmarks (T2I-CompBench, GenEval). Qualitative analysis shows that our method eliminates verbose explanations and repetitive refinements, producing reasoning prompts that are both concise and semantically rich. As a result, ShortCoTI improves computational efficiency without compromising the fidelity or visual appeal of generated images.