Human Action Recognition from Point Clouds over Time

作者: James Dickens

分类: cs.CV

发布日期: 2025-10-07 (更新: 2025-10-09)

💡 一句话要点

提出一种基于点云序列和稀疏卷积网络的3D人体动作识别方法

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 人体动作识别 点云处理 稀疏卷积网络 3D视觉 深度学习

📋 核心要点

- 现有动作识别方法主要集中于骨骼和视频数据,忽略了日益普及的深度传感器和激光雷达提供的丰富3D点云数据。

- 该方法提出了一种新的3D动作识别框架,通过分割、跟踪和身体部位分割处理点云数据,并结合点云特征和稀疏卷积网络。

- 实验结果表明,该方法在NTU RGB-D 120数据集上表现出色,尤其是在跨个体测试中优于现有方法,准确率达到89.3%。

📝 摘要(中文)

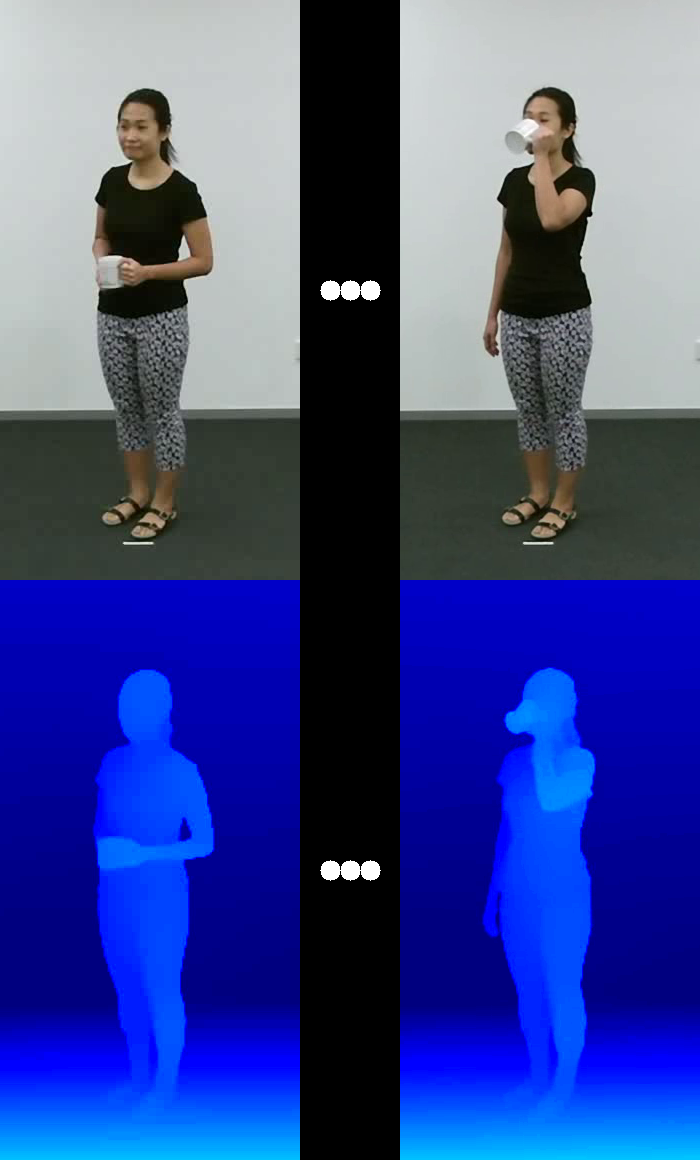

本文提出了一种新颖的3D人体动作识别方法,利用日益普及的深度传感器和激光雷达数据。该方法首先从场景背景中分割人体点云,然后进行个体跟踪和身体部位分割。该方法支持来自深度传感器和单目深度估计的点云数据。提出的动作识别框架的核心是一个新的3D动作识别骨干网络,它结合了基于点的技术和应用于体素化点云序列的稀疏卷积网络。实验中,该方法融合了表面法线、颜色、红外强度和身体部位解析标签等辅助点特征,以提高识别精度。在NTU RGB-D 120数据集上的评估表明,该方法与现有的骨骼动作识别算法具有竞争力。此外,在集成设置中结合基于传感器和估计的深度输入,当考虑不同的人进行训练和测试时,该方法达到了89.3%的准确率,优于以往的点云动作识别方法。

🔬 方法详解

问题定义:现有的人体动作识别方法主要依赖于骨骼数据或视频数据,而忽略了深度传感器和激光雷达等设备提供的丰富3D点云信息。如何有效地利用这些点云数据进行人体动作识别是一个挑战。现有点云动作识别方法可能存在特征提取不足、计算复杂度高或对噪声敏感等问题。

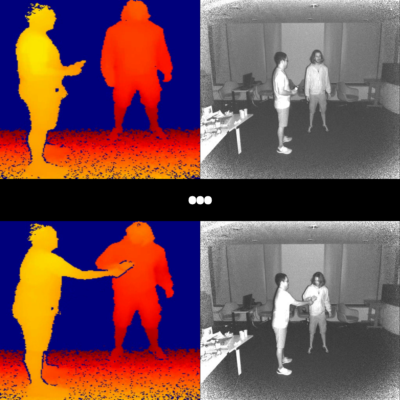

核心思路:该论文的核心思路是将点云数据转换为体素表示,然后利用稀疏卷积网络提取时空特征。这种方法既能保留点云的几何信息,又能有效地降低计算复杂度。此外,论文还通过融合多种辅助特征(如表面法线、颜色等)来增强特征表达能力。

技术框架:该方法主要包含以下几个阶段:1) 点云分割:从场景背景中分割出人体点云。2) 个体跟踪:在时间序列上跟踪个体。3) 身体部位分割:将人体点云分割成不同的身体部位。4) 特征提取:提取点云的几何特征和辅助特征(如表面法线、颜色等)。5) 动作识别:将提取的特征输入到基于稀疏卷积网络的分类器中进行动作识别。

关键创新:该论文的关键创新在于提出了一个结合点云处理技术和稀疏卷积网络的3D动作识别骨干网络。与传统的基于体素的卷积网络相比,稀疏卷积网络能够有效地处理稀疏点云数据,降低计算复杂度。此外,论文还通过融合多种辅助特征来增强特征表达能力。

关键设计:论文中使用了体素化方法将点云数据转换为体素表示。稀疏卷积网络的具体结构未知,但其关键在于利用稀疏性来减少计算量。辅助特征的融合方式未知,但可能采用了特征拼接或注意力机制等方法。损失函数可能使用了交叉熵损失函数或其他分类损失函数。

🖼️ 关键图片

📊 实验亮点

该方法在NTU RGB-D 120数据集上进行了评估,结果表明其性能与现有的骨骼动作识别算法具有竞争力。更重要的是,在跨个体测试中,该方法达到了89.3%的准确率,优于以往的点云动作识别方法,证明了其泛化能力和有效性。

🎯 应用场景

该研究成果可应用于智能监控、人机交互、康复训练、虚拟现实等领域。例如,在智能监控中,可以利用该方法自动识别异常行为;在人机交互中,可以实现基于手势或身体动作的控制;在康复训练中,可以辅助评估患者的运动能力;在虚拟现实中,可以实现更自然的人体动作捕捉。

📄 摘要(原文)

Recent research into human action recognition (HAR) has focused predominantly on skeletal action recognition and video-based methods. With the increasing availability of consumer-grade depth sensors and Lidar instruments, there is a growing opportunity to leverage dense 3D data for action recognition, to develop a third way. This paper presents a novel approach for recognizing actions from 3D videos by introducing a pipeline that segments human point clouds from the background of a scene, tracks individuals over time, and performs body part segmentation. The method supports point clouds from both depth sensors and monocular depth estimation. At the core of the proposed HAR framework is a novel backbone for 3D action recognition, which combines point-based techniques with sparse convolutional networks applied to voxel-mapped point cloud sequences. Experiments incorporate auxiliary point features including surface normals, color, infrared intensity, and body part parsing labels, to enhance recognition accuracy. Evaluation on the NTU RGB- D 120 dataset demonstrates that the method is competitive with existing skeletal action recognition algorithms. Moreover, combining both sensor-based and estimated depth inputs in an ensemble setup, this approach achieves 89.3% accuracy when different human subjects are considered for training and testing, outperforming previous point cloud action recognition methods.