General and Efficient Visual Goal-Conditioned Reinforcement Learning using Object-Agnostic Masks

作者: Fahim Shahriar, Cheryl Wang, Alireza Azimi, Gautham Vasan, Hany Hamed Elanwar, A. Rupam Mahmood, Colin Bellinger

分类: cs.CV, cs.LG

发布日期: 2025-10-06

💡 一句话要点

提出基于目标无关掩码的视觉目标条件强化学习方法,提升泛化性和效率

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 目标条件强化学习 视觉目标表示 目标无关掩码 机器人操作 模拟到真实迁移

📋 核心要点

- 现有目标条件强化学习方法在目标表示上存在不足,如泛化性差、收敛慢以及依赖特定传感器。

- 本文提出基于目标无关掩码的目标表示方法,为智能体提供视觉线索,提升学习效率和泛化能力。

- 实验表明,该方法在模拟和真实机器人上均表现出色,无需位置信息即可实现高精度拾取任务。

📝 摘要(中文)

本文提出了一种基于掩码的目标表示系统,用于通用且高效的视觉目标条件强化学习(GCRL)。该系统为智能体提供目标无关的视觉线索,从而实现高效学习和卓越的泛化能力。与现有的目标表示方法(如目标状态图像、3D坐标和one-hot向量)相比,本文方法克服了泛化能力差、收敛速度慢以及需要特殊相机等问题。掩码可以被处理以生成密集的奖励,而无需容易出错的距离计算。在模拟环境中使用真实掩码进行学习,在训练和未见过的测试对象上达到了99.9%的到达精度。该方法无需目标位置信息即可高精度地执行拾取任务。此外,本文还展示了使用两个不同的物理机器人从头开始学习以及从模拟到真实的迁移应用,利用预训练的开放词汇目标检测模型生成掩码。

🔬 方法详解

问题定义:现有的目标条件强化学习方法,例如使用目标状态图像、3D坐标或one-hot向量作为目标表示,存在泛化能力差、收敛速度慢以及需要特殊相机等问题。这些方法难以适应未见过的物体,且对环境变化敏感,限制了其在实际机器人任务中的应用。此外,基于距离计算的奖励函数容易出错,影响学习效率。

核心思路:本文的核心思路是使用目标无关的掩码作为目标表示。掩码提供了目标物体的形状和位置信息,但避免了对特定物体的依赖,从而提高了泛化能力。通过处理掩码,可以生成密集的奖励信号,引导智能体更快地学习。这种表示方法不依赖于特定的传感器或坐标系,更易于在不同环境和机器人平台上应用。

技术框架:该方法主要包含以下几个模块:1) 目标掩码生成模块:在模拟环境中直接使用真实掩码,在真实环境中利用预训练的开放词汇目标检测模型生成掩码。2) 策略学习模块:使用强化学习算法(例如PPO)训练智能体,使其能够根据当前状态和目标掩码采取行动。3) 奖励函数设计:基于当前状态和目标掩码之间的重叠程度设计奖励函数,鼓励智能体逐步接近目标。整体流程是,智能体根据当前状态和目标掩码采取行动,环境返回新的状态和奖励,智能体根据奖励更新策略。

关键创新:最重要的技术创新点在于使用目标无关的掩码作为目标表示。与现有方法相比,这种表示方法具有更好的泛化能力和鲁棒性,能够适应未见过的物体和环境变化。此外,该方法还提出了一种基于掩码重叠程度的奖励函数,能够提供更密集的奖励信号,加速学习过程。

关键设计:在模拟环境中,直接使用ground truth掩码。在真实环境中,使用预训练的开放词汇目标检测模型(例如CLIPSeg)生成掩码。奖励函数的设计至关重要,通常基于当前状态的掩码与目标掩码之间的IoU(Intersection over Union)或其他相似性度量。策略学习通常采用Actor-Critic架构,例如PPO算法。具体的网络结构和超参数需要根据具体的任务进行调整。

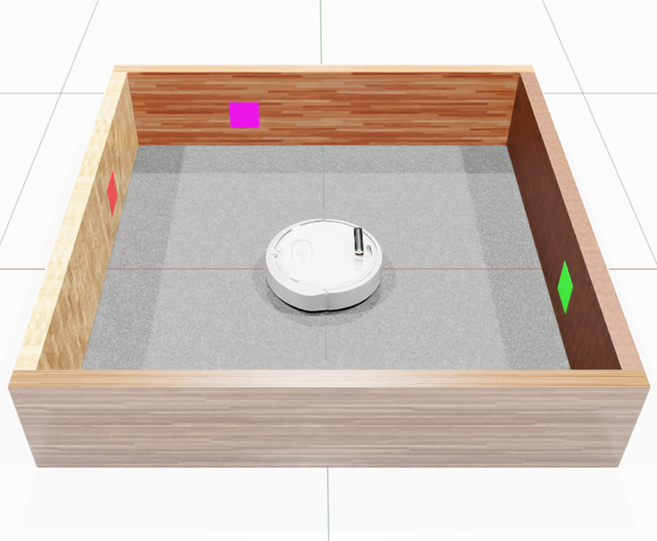

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在模拟环境中达到了99.9%的到达精度,并且在未见过的测试对象上表现出色,验证了其泛化能力。在真实机器人实验中,该方法也能够成功地完成拾取任务,证明了其在实际应用中的可行性。与传统的基于坐标的目标表示方法相比,该方法具有更高的鲁棒性和适应性。

🎯 应用场景

该研究成果可广泛应用于机器人操作任务,例如物体抓取、放置、组装等。在工业自动化、物流、医疗等领域具有重要的应用价值。通过结合视觉信息和强化学习,可以使机器人更加智能、灵活,能够适应复杂多变的环境,完成各种任务。未来,该方法有望扩展到更复杂的任务和环境,例如多物体操作、动态环境等。

📄 摘要(原文)

Goal-conditioned reinforcement learning (GCRL) allows agents to learn diverse objectives using a unified policy. The success of GCRL, however, is contingent on the choice of goal representation. In this work, we propose a mask-based goal representation system that provides object-agnostic visual cues to the agent, enabling efficient learning and superior generalization. In contrast, existing goal representation methods, such as target state images, 3D coordinates, and one-hot vectors, face issues of poor generalization to unseen objects, slow convergence, and the need for special cameras. Masks can be processed to generate dense rewards without requiring error-prone distance calculations. Learning with ground truth masks in simulation, we achieved 99.9% reaching accuracy on training and unseen test objects. Our proposed method can be utilized to perform pick-up tasks with high accuracy, without using any positional information of the target. Moreover, we demonstrate learning from scratch and sim-to-real transfer applications using two different physical robots, utilizing pretrained open vocabulary object detection models for mask generation.